- Главная

- Разное

- Дизайн

- Бизнес и предпринимательство

- Аналитика

- Образование

- Развлечения

- Красота и здоровье

- Финансы

- Государство

- Путешествия

- Спорт

- Недвижимость

- Армия

- Графика

- Культурология

- Еда и кулинария

- Лингвистика

- Английский язык

- Астрономия

- Алгебра

- Биология

- География

- Детские презентации

- Информатика

- История

- Литература

- Маркетинг

- Математика

- Медицина

- Менеджмент

- Музыка

- МХК

- Немецкий язык

- ОБЖ

- Обществознание

- Окружающий мир

- Педагогика

- Русский язык

- Технология

- Физика

- Философия

- Химия

- Шаблоны, картинки для презентаций

- Экология

- Экономика

- Юриспруденция

Обучение с учителем. Линейная регрессия презентация

Содержание

- 1. Обучение с учителем. Линейная регрессия

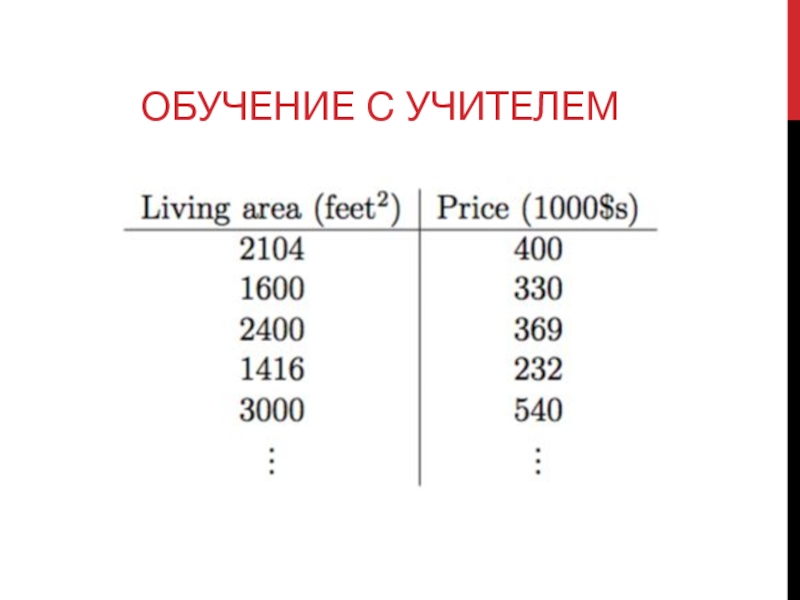

- 2. ОБУЧЕНИЕ С УЧИТЕЛЕМ

- 4. НЕМНОЖКО ФОРМАЛИЗМА X – input features Y

- 5. ЦЕЛЬ ОБУЧЕНИЯ С УЧИТЕЛЕМ Prediction function h

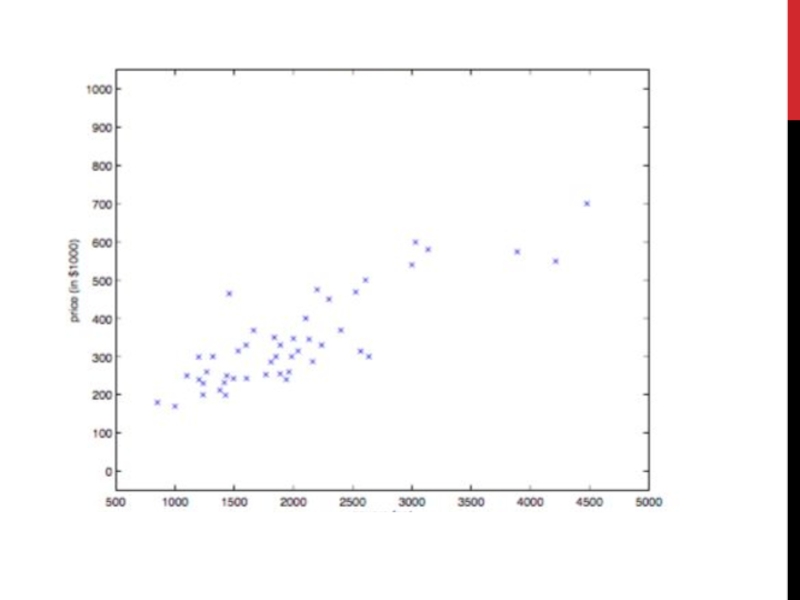

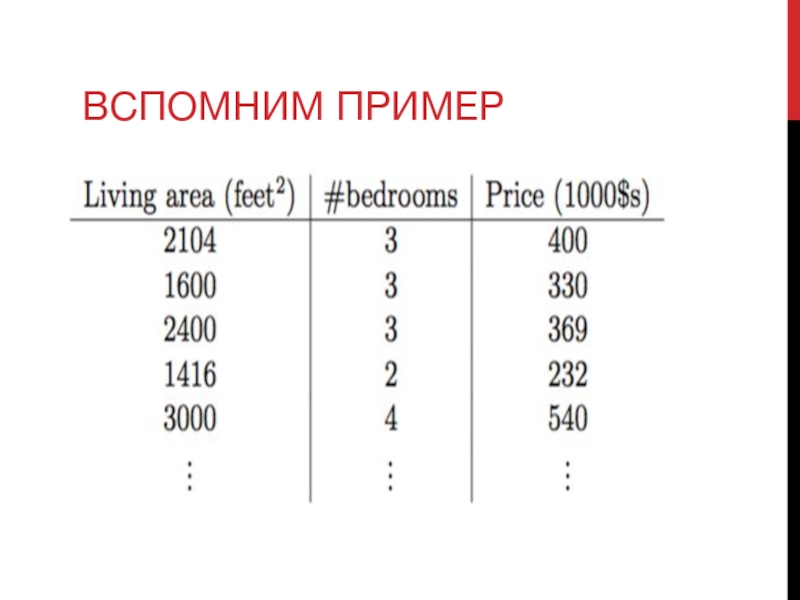

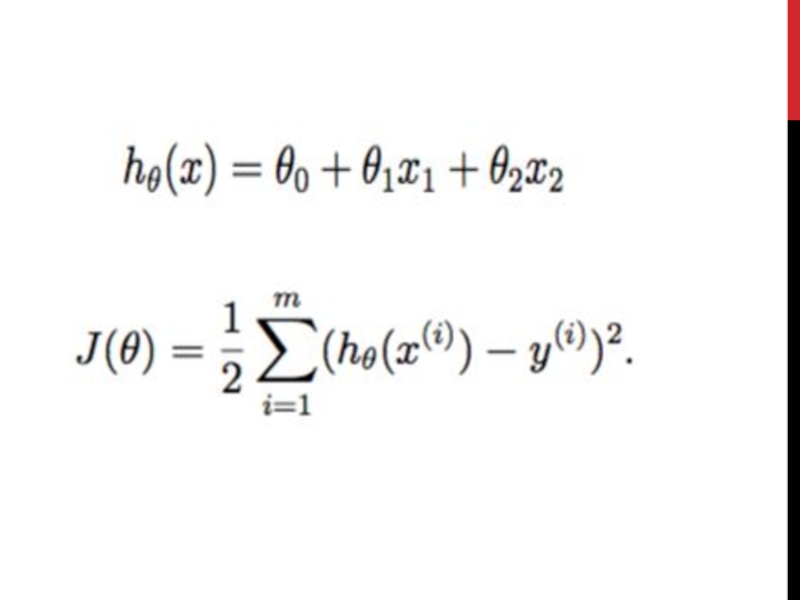

- 6. ВСПОМНИМ ПРИМЕР

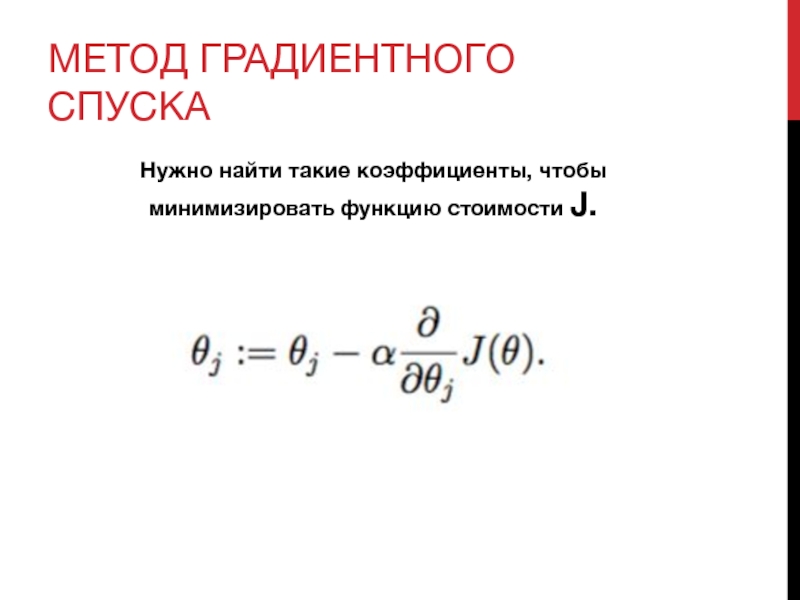

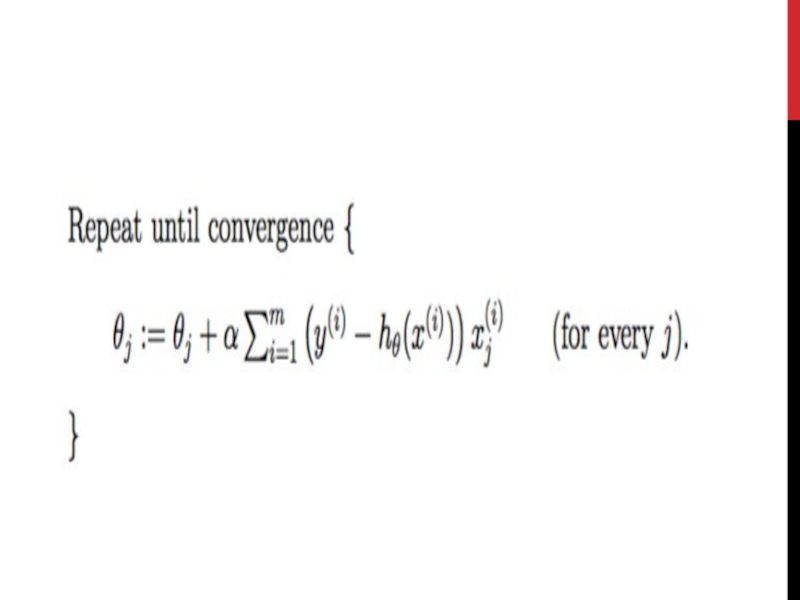

- 8. МЕТОД ГРАДИЕНТНОГО СПУСКА Нужно найти такие коэффициенты, чтобы минимизировать функцию стоимости J.

- 10. ПСЕВДООБРАТНАЯ МАТРИЦА МУРА - ПЕНРОУЗА Пусть

- 11. СИСТЕМЫ ЛИНЕЙНЫХ УРАВНЕНИЙ И СВЯЗЬ С ЛИНЕЙНОЙ

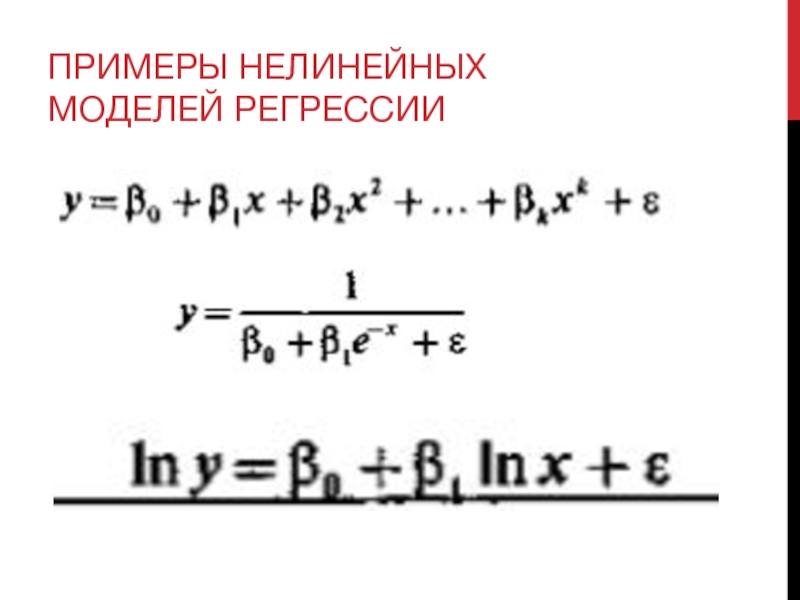

- 12. ПРИМЕРЫ НЕЛИНЕЙНЫХ МОДЕЛЕЙ РЕГРЕССИИ

- 13. ПЕРЕОБУЧЕНИЕ И РЕГУЛЯРИЗАЦИЯ Переобучение - нежелательное явление,

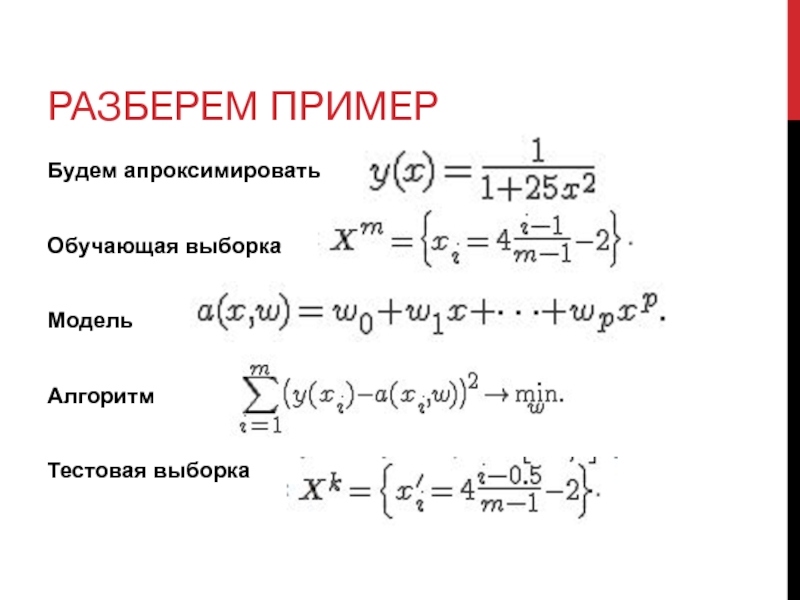

- 14. РАЗБЕРЕМ ПРИМЕР Будем апроксимировать Обучающая

- 15. P = 2 : НЕДООБУЧЕНИЕ

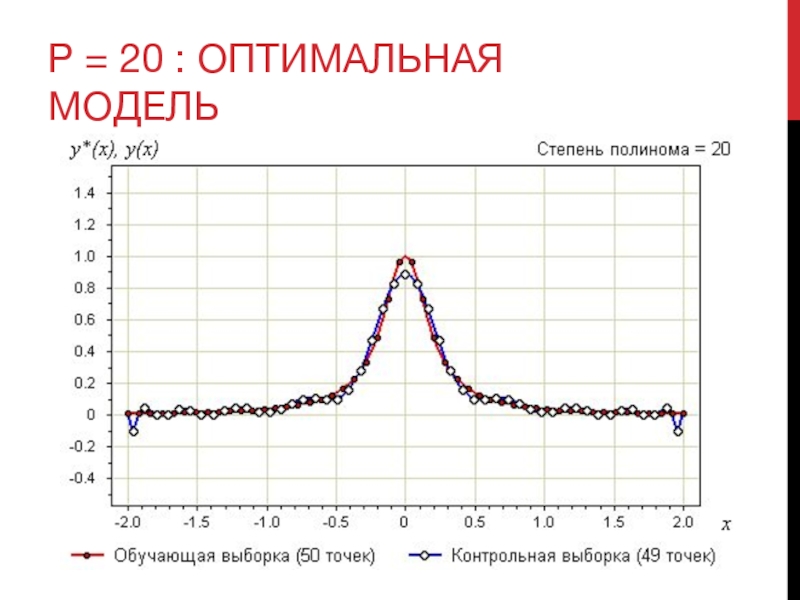

- 16. P = 20 : ОПТИМАЛЬНАЯ МОДЕЛЬ

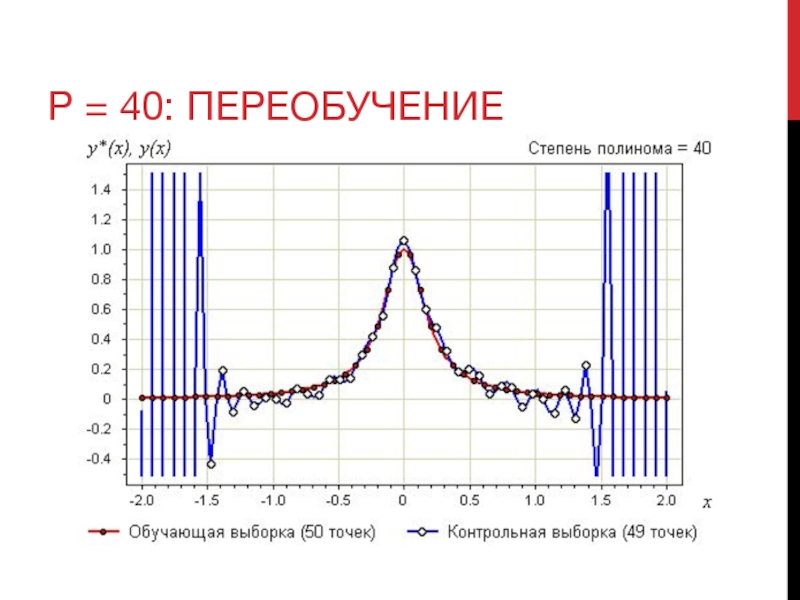

- 17. P = 40: ПЕРЕОБУЧЕНИЕ

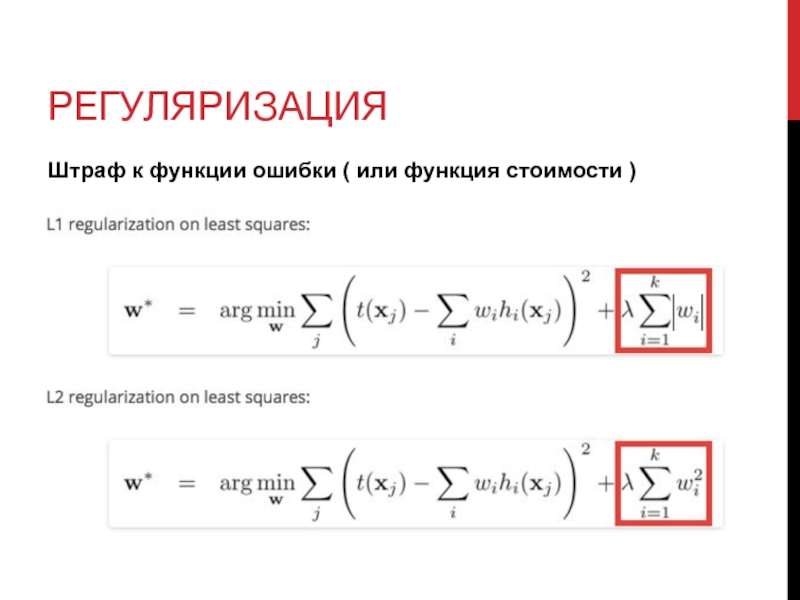

- 18. РЕГУЛЯРИЗАЦИЯ Штраф к функции ошибки ( или функция стоимости )

- 19. СРАВНЕНИЕ

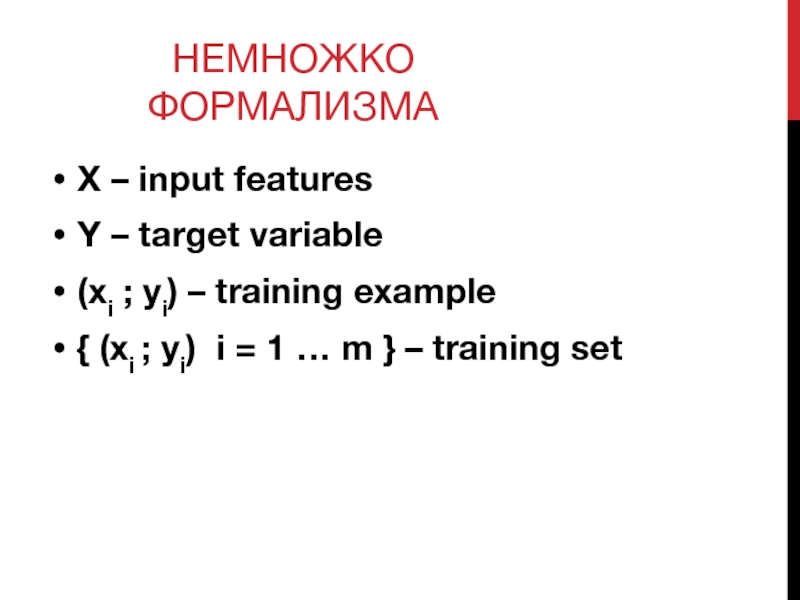

Слайд 4НЕМНОЖКО ФОРМАЛИЗМА

X – input features

Y – target variable

(xi ; yi) –

training example

{ (xi ; yi) i = 1 … m } – training set

{ (xi ; yi) i = 1 … m } – training set

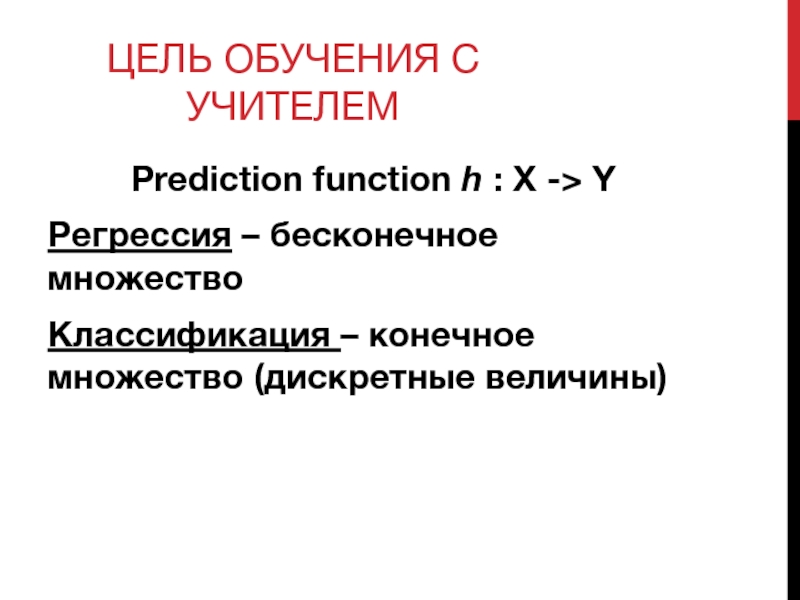

Слайд 5ЦЕЛЬ ОБУЧЕНИЯ С УЧИТЕЛЕМ

Prediction function h : X -> Y

Регрессия

– бесконечное множество

Классификация – конечное множество (дискретные величины)

Классификация – конечное множество (дискретные величины)

Слайд 8МЕТОД ГРАДИЕНТНОГО СПУСКА

Нужно найти такие коэффициенты, чтобы минимизировать функцию стоимости J.

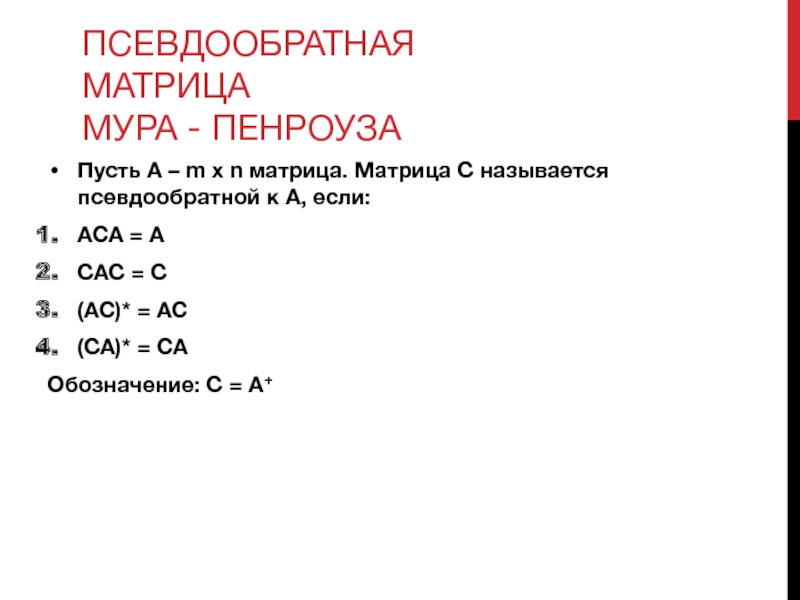

Слайд 10ПСЕВДООБРАТНАЯ МАТРИЦА

МУРА - ПЕНРОУЗА

Пусть A – m x n матрица.

Матрица C называется псевдообратной к A, если:

ACA = A

CAC = C

(AC)* = AC

(CA)* = CA

Обозначение: C = A+

ACA = A

CAC = C

(AC)* = AC

(CA)* = CA

Обозначение: C = A+

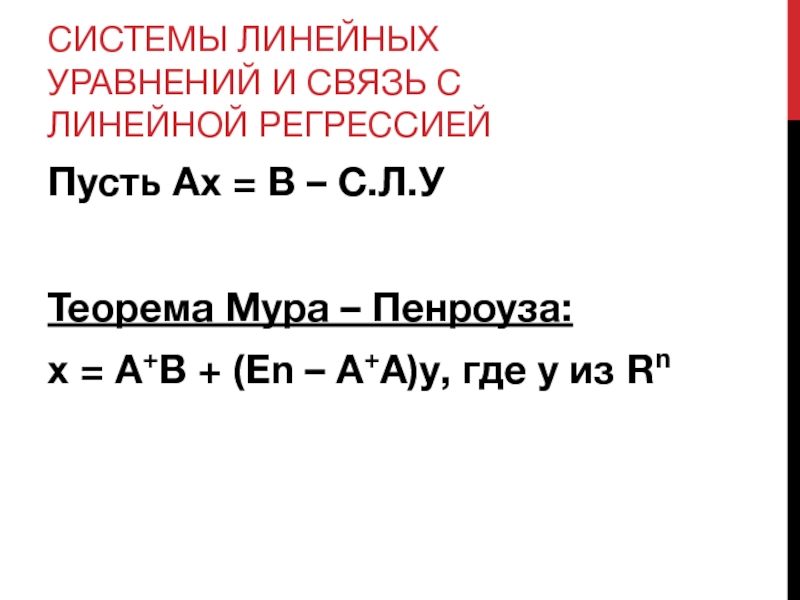

Слайд 11СИСТЕМЫ ЛИНЕЙНЫХ УРАВНЕНИЙ И СВЯЗЬ С ЛИНЕЙНОЙ РЕГРЕССИЕЙ

Пусть Ax = B

– С.Л.У

Теорема Мура – Пенроуза:

x = A+B + (En – A+A)y, где y из Rn

Теорема Мура – Пенроуза:

x = A+B + (En – A+A)y, где y из Rn

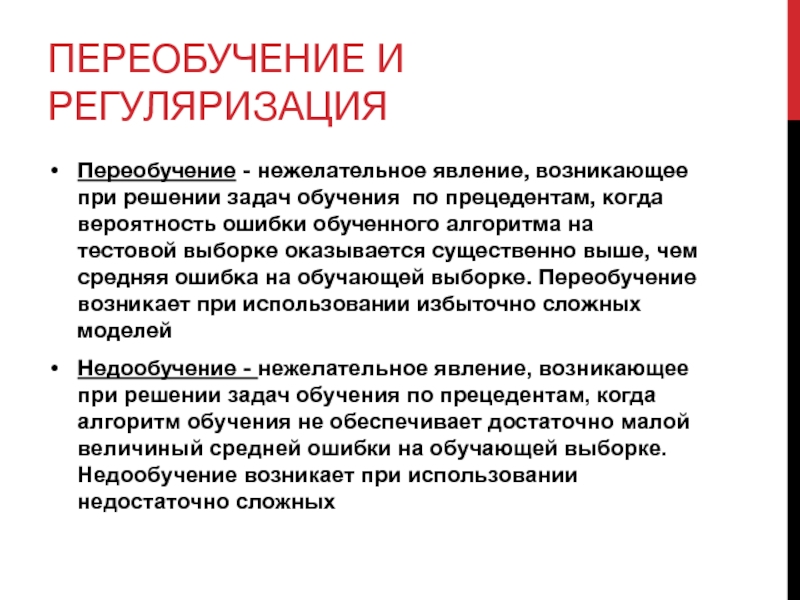

Слайд 13ПЕРЕОБУЧЕНИЕ И РЕГУЛЯРИЗАЦИЯ

Переобучение - нежелательное явление, возникающее при решении задач обучения

по прецедентам, когда вероятность ошибки обученного алгоритма на тестовой выборке оказывается существенно выше, чем средняя ошибка на обучающей выборке. Переобучение возникает при использовании избыточно сложных моделей

Недообучение - нежелательное явление, возникающее при решении задач обучения по прецедентам, когда алгоритм обучения не обеспечивает достаточно малой величиный средней ошибки на обучающей выборке. Недообучение возникает при использовании недостаточно сложных

Недообучение - нежелательное явление, возникающее при решении задач обучения по прецедентам, когда алгоритм обучения не обеспечивает достаточно малой величиный средней ошибки на обучающей выборке. Недообучение возникает при использовании недостаточно сложных