- Главная

- Разное

- Дизайн

- Бизнес и предпринимательство

- Аналитика

- Образование

- Развлечения

- Красота и здоровье

- Финансы

- Государство

- Путешествия

- Спорт

- Недвижимость

- Армия

- Графика

- Культурология

- Еда и кулинария

- Лингвистика

- Английский язык

- Астрономия

- Алгебра

- Биология

- География

- Детские презентации

- Информатика

- История

- Литература

- Маркетинг

- Математика

- Медицина

- Менеджмент

- Музыка

- МХК

- Немецкий язык

- ОБЖ

- Обществознание

- Окружающий мир

- Педагогика

- Русский язык

- Технология

- Физика

- Философия

- Химия

- Шаблоны, картинки для презентаций

- Экология

- Экономика

- Юриспруденция

Шалаев Ю.Н. каф. Информатики и проектирования систем. Институт кибернетикиТеория случайных функций презентация

Содержание

- 1. Шалаев Ю.Н. каф. Информатики и проектирования систем. Институт кибернетикиТеория случайных функций

- 2. Если параметр t – время, то случайную

- 3. Законы распределения случайных функций Случайную функцию рассматривают

- 4. F2(x1, x2; t1,t2)=P{X(t1)

- 5. Для непрерывных случайных функций X(t) плотности

- 6. Для плотностей распределения случайной функции X(t)

- 7. Характеристики случайных функций Математическое ожидание случайной функции

- 8. Свойства математического ожидания Математическое ожидание неслучайной (детерминированной)

- 9. Дисперсия случайной функции Дисперсией случайной функции X(t)

- 10. Корреляционная функция случайной функции X(t)

- 11. Корреляционная функция находится как

- 12. Свойства корреляционной функции Дисперсия случайной функции находится

- 13. Линейные преобразования случайных функций Прибавление неслучайного слагаемого

- 14. Умножение на неслучайный множитель Рассмотрим

- 15. Дифференцирование случайной функции Пусть X(t) – случайная

- 16. Интегрирование случайной функции Пусть X(t) – случайная

- 17. Сложение случайных функций Рассмотрим сумму случайных

- 18. Взаимная корреляционная функция:

- 19. Свойства взаимной корреляционной функции Для действительных случайных

- 20. Сложение случайной функции со случайной величиной Пусть

- 21. Нормированная взаимная корреляционная функция связи Это безразмерная характеристика связи между случайными функциями:

- 22. Оценка характеристик случайной функции Пусть имеется n

- 24. Каждое сечение tk есть n значений

- 25. Для корреляционной функции:

- 26. Стационарные случайные функции Различают стационарность случайной функции

- 27. Так, одномерная плотность распределения вероятностей f1(x;t)

- 28. Стационарная функция называется стационарной в широком

- 29. Стационарная функция в широком смысле может

- 30. Свойства Kx(τ) Если X(t) вещественная и стационарная,

- 31. Эргодические свойства стационарных случайных функций Так как

- 32. Оценка характеристик стационарной случайной функции Если X(t)

- 33. Для корреляционной функции:

- 34. На практике интегралы заменяют конечными суммами.

- 35. Обозначим середины полученных участков t1,

- 37. Марковский случайный процесс Случайный процесс

- 38. Пусть A={a1, a2,…,

- 39. Случайный процесс, протекающий в физической системе

- 40. Вероятности перехода Р11, Р22,

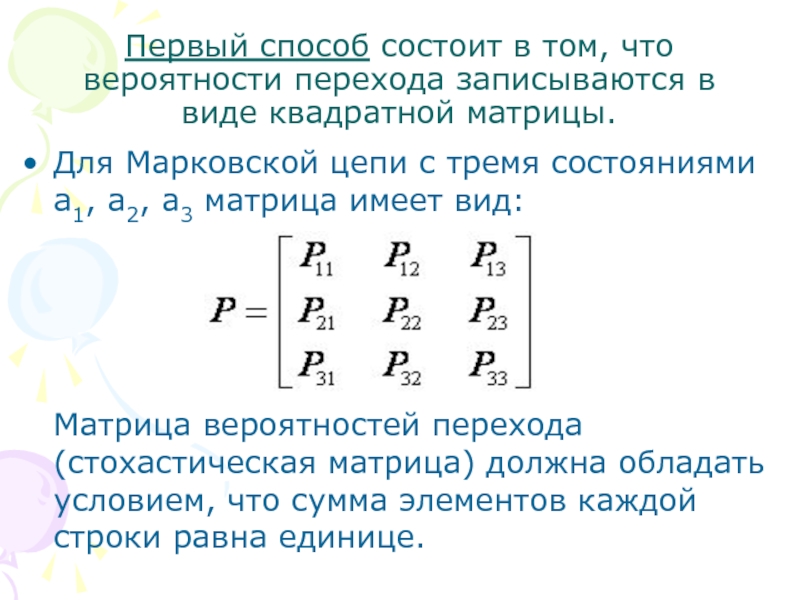

- 41. Первый способ состоит в том, что вероятности

- 42. Второй способ представления вероятностей перехода состоит

- 43. При изучении Марковских цепей иногда

- 44. Марковская цепь называется регулярной, если

- 45. Марковская цепь называется эргодической, если

- 46. Моделирование случайных величин Случайные величины моделируют

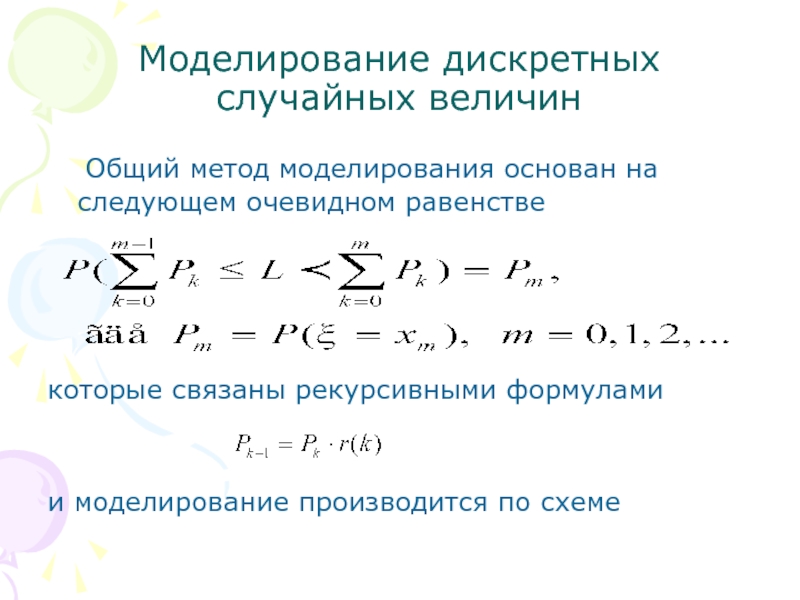

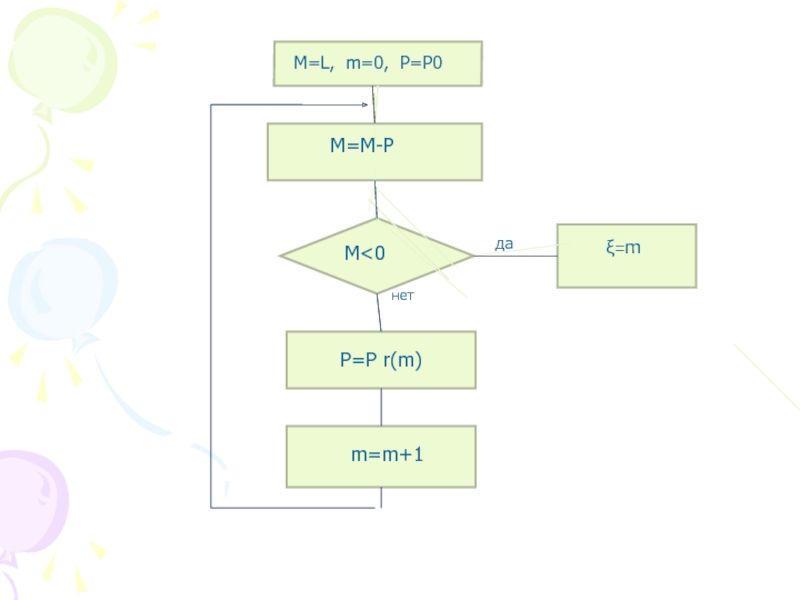

- 47. Моделирование дискретных случайных величин Общий

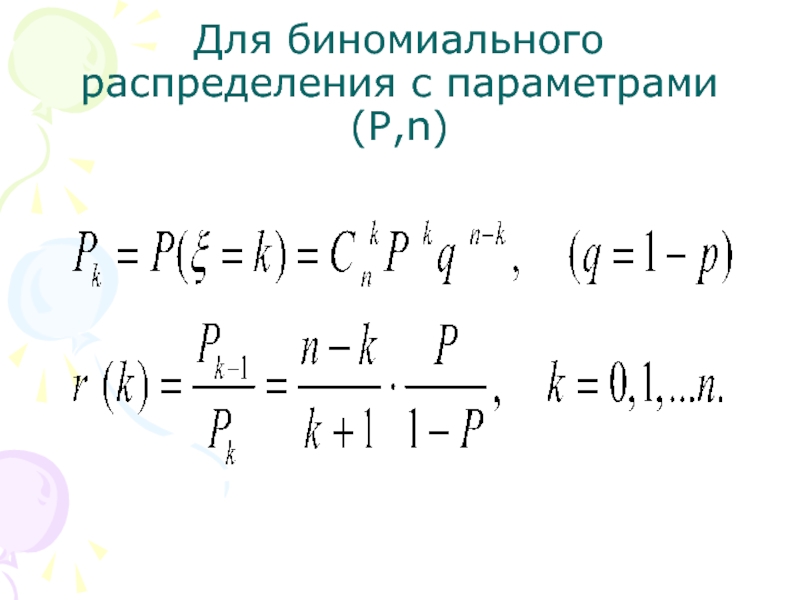

- 49. Для биномиального распределения с параметрами (P,n)

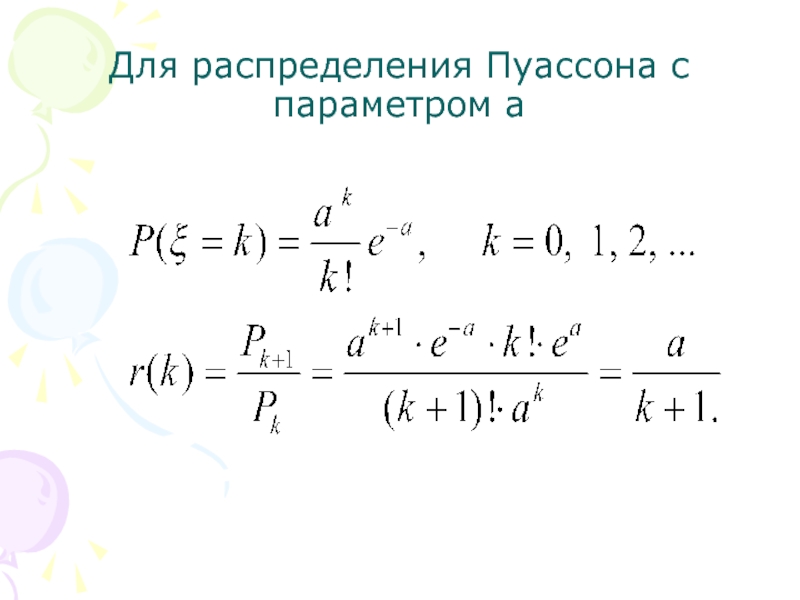

- 50. Для распределения Пуассона с параметром a

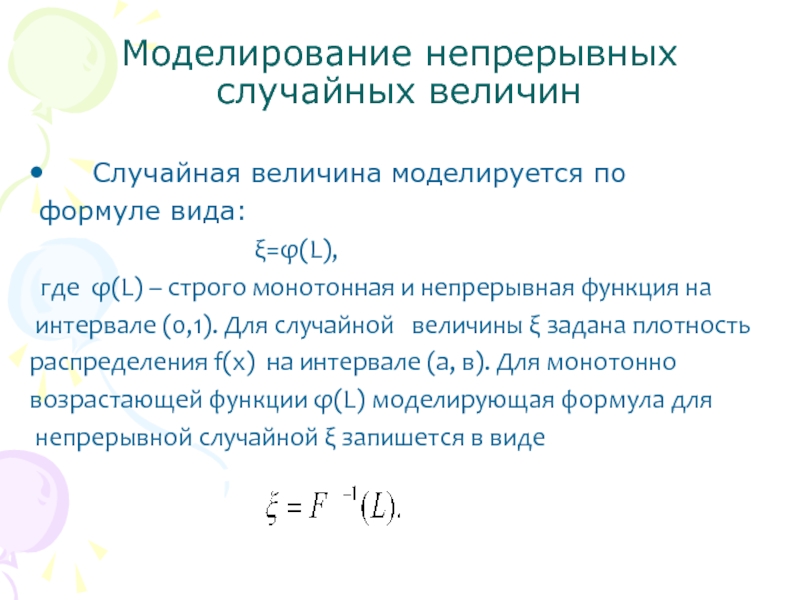

- 51. Моделирование непрерывных случайных величин Случайная

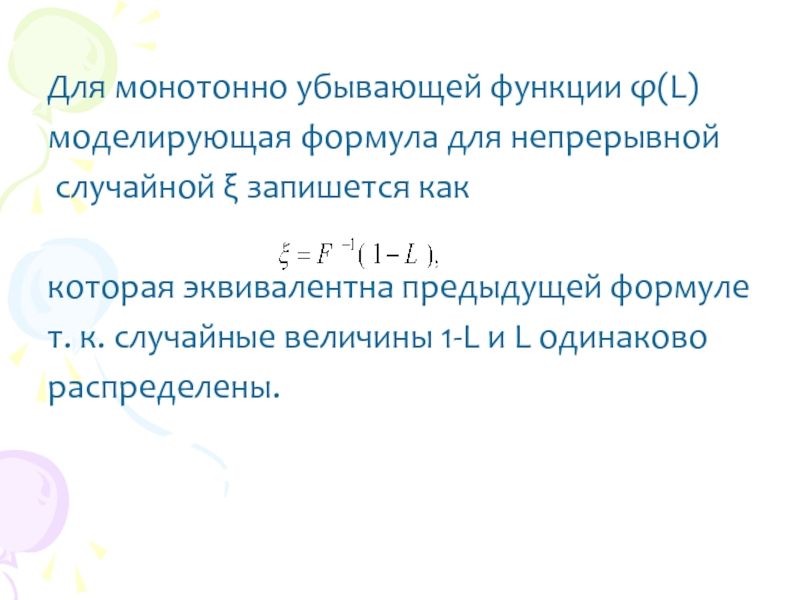

- 52. Для монотонно убывающей функции φ(L) моделирующая

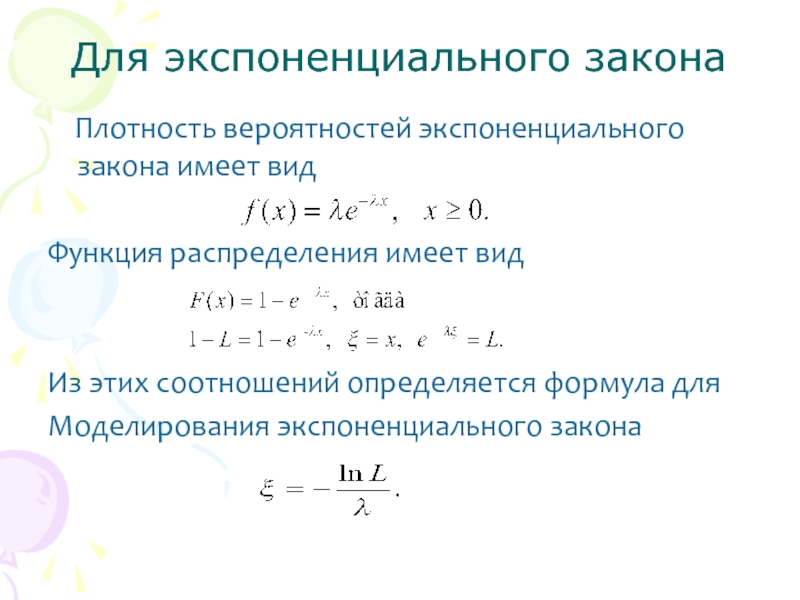

- 53. Для экспоненциального закона Плотность вероятностей

Слайд 1Шалаев Ю.Н. каф. Информатики и проектирования систем.

Институт кибернетики

Теория случайных функций

Случайной

Слайд 2Если параметр t – время, то случайную функцию называют случайным процессом.

Если зафиксировать элементарное событие ω=ω0, то X(t, ω0) будет неслучайной функцией аргумента t.

Конкретный вид случайной функции при фиксированном ω в данном опыте называется реализацией случайной функции X(ωI,t). Если зафиксировать параметр случайной функции при

t=tk, то она будет зависеть только от элементарного события и, следовательно, станет случайной величиной X(tк, ω). При дальнейшем изложении аргумент ω для краткости опускается.

Слайд 3Законы распределения случайных функций

Случайную функцию рассматривают как многомерную случайную величину. То

Слайд 4

F2(x1, x2; t1,t2)=P{X(t1)

Слайд 5

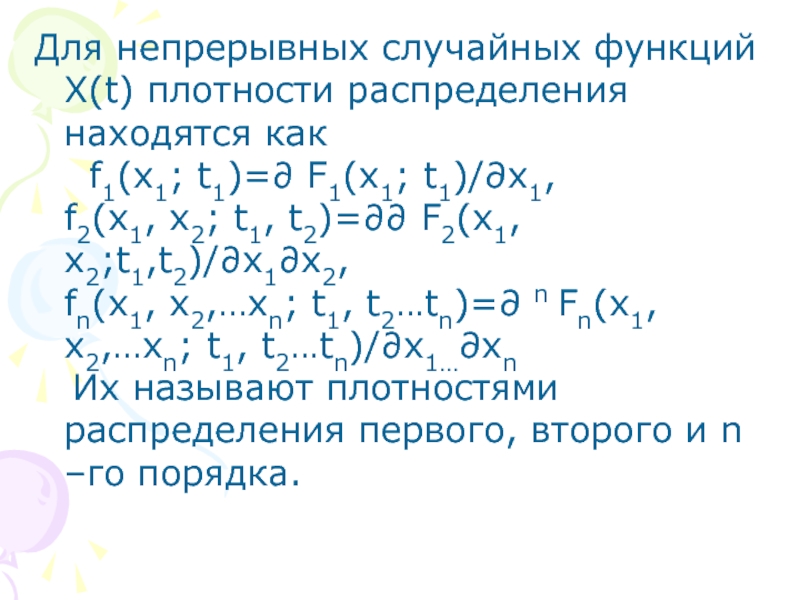

Для непрерывных случайных функций X(t) плотности распределения находятся как

f1(x1; t1)=∂

Слайд 6

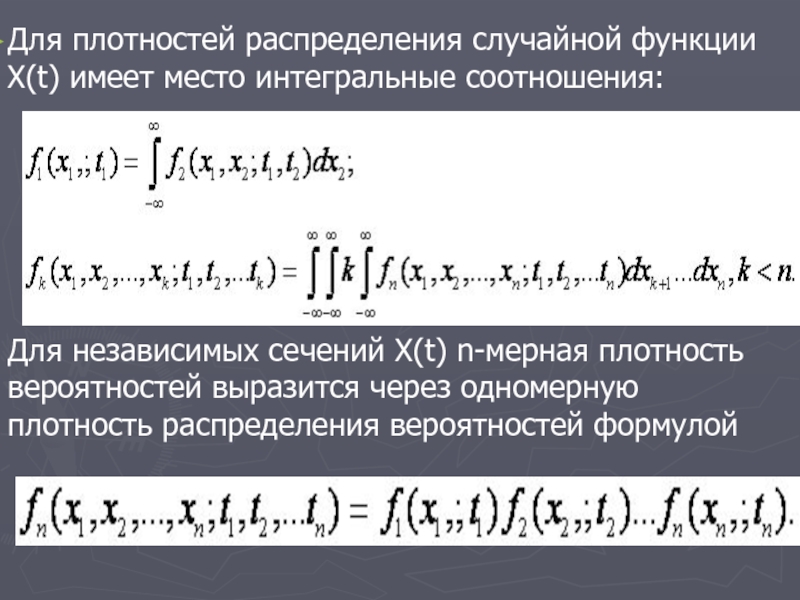

Для плотностей распределения случайной функции X(t) имеет место интегральные соотношения:

Для независимых

Слайд 7Характеристики случайных функций

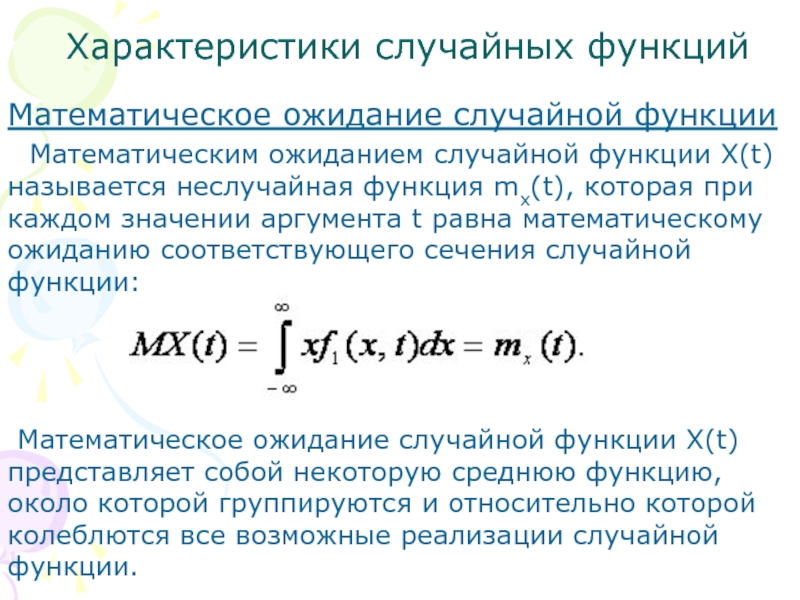

Математическое ожидание случайной функции

Математическим ожиданием случайной функции X(t)

Слайд 8Свойства математического ожидания

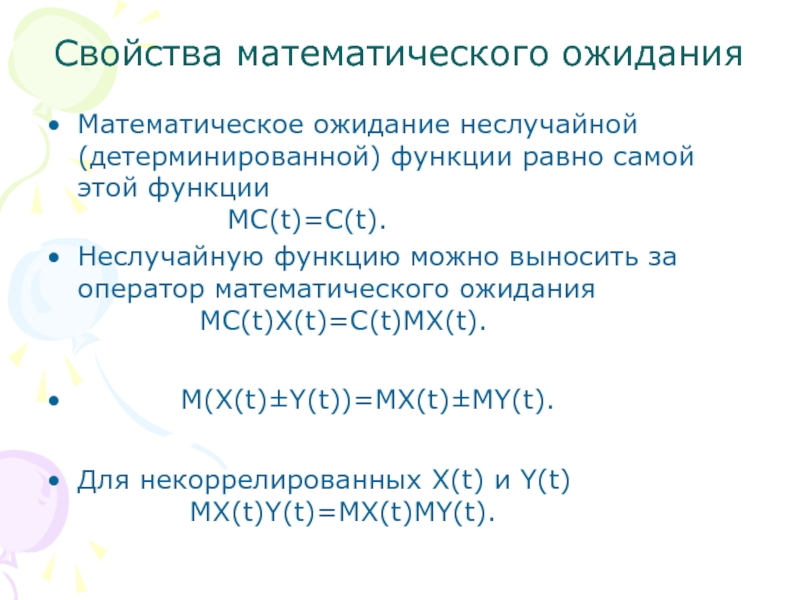

Математическое ожидание неслучайной (детерминированной) функции равно самой этой функции

Неслучайную функцию можно выносить за оператор математического ожидания MC(t)X(t)=C(t)MX(t).

M(X(t)±Y(t))=MX(t)±MY(t).

Для некоррелированных X(t) и Y(t) MX(t)Y(t)=MX(t)MY(t).

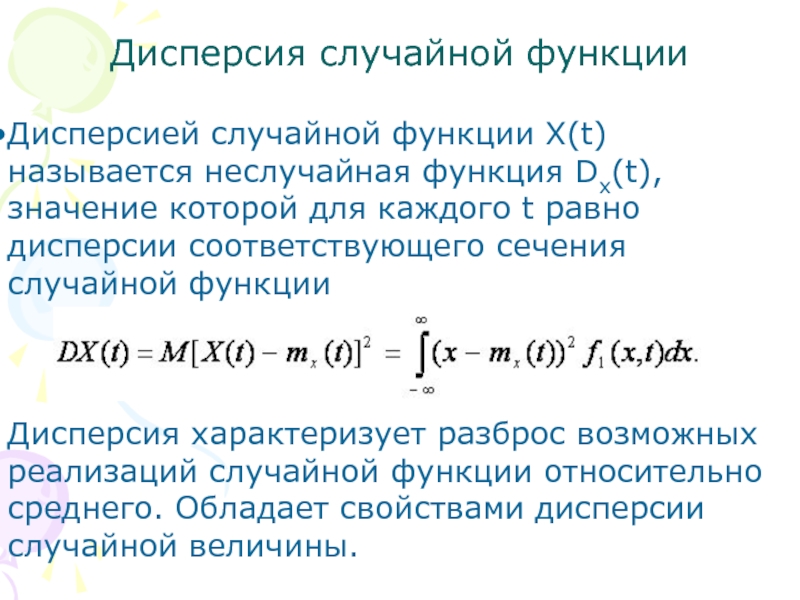

Слайд 9Дисперсия случайной функции

Дисперсией случайной функции X(t) называется неслучайная функция Dx(t), значение

Слайд 10Корреляционная функция случайной функции X(t)

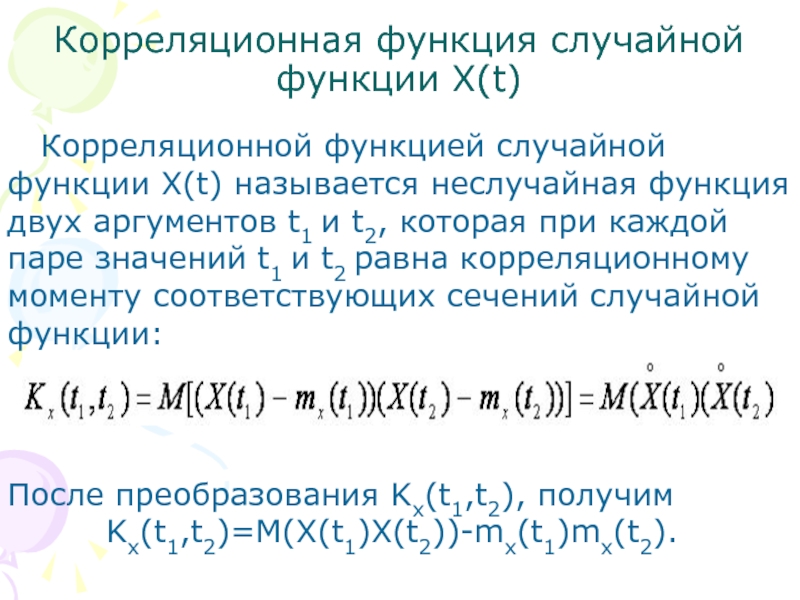

Корреляционной функцией случайной функции X(t)

После преобразования Kx(t1,t2), получим Kx(t1,t2)=M(X(t1)X(t2))-mx(t1)mx(t2).

Слайд 11

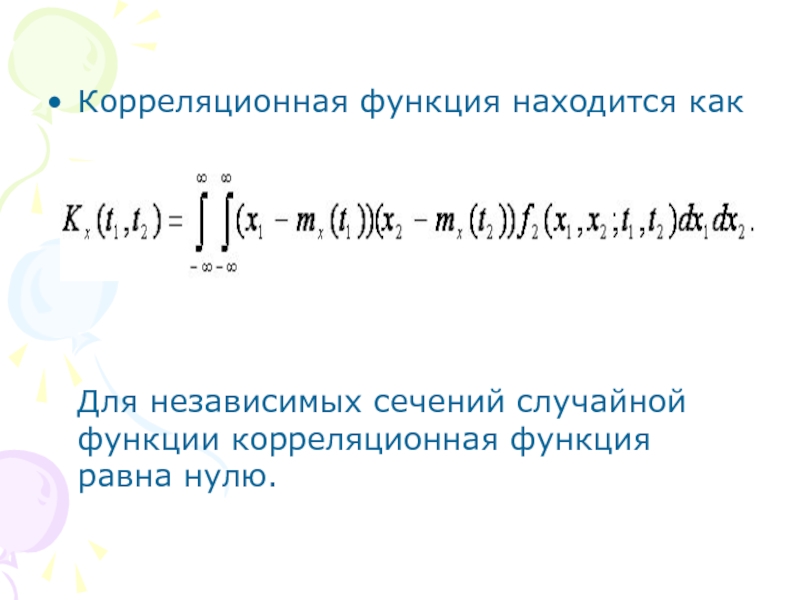

Корреляционная функция находится как

Для независимых сечений случайной функции корреляционная функция равна

Слайд 12Свойства корреляционной функции

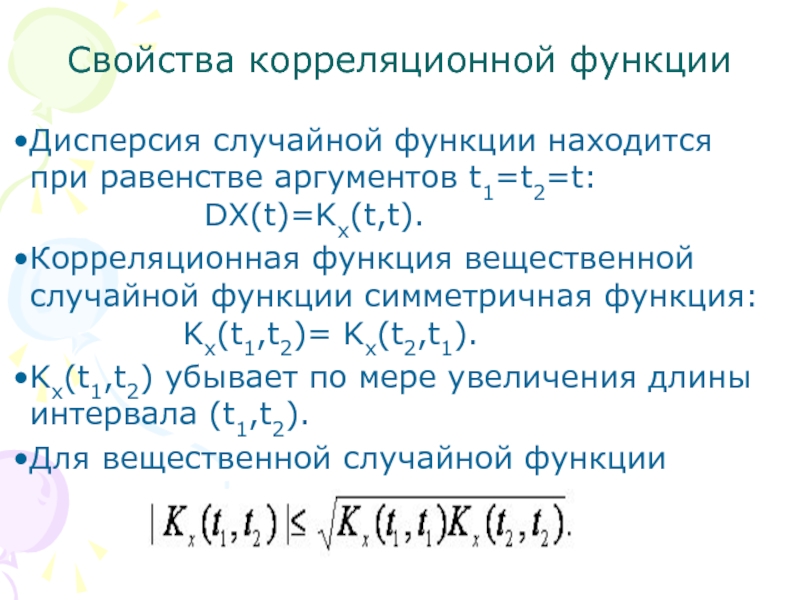

Дисперсия случайной функции находится при равенстве аргументов t1=t2=t:

Корреляционная функция вещественной случайной функции симметричная функция: Kx(t1,t2)= Kx(t2,t1).

Kx(t1,t2) убывает по мере увеличения длины интервала (t1,t2).

Для вещественной случайной функции

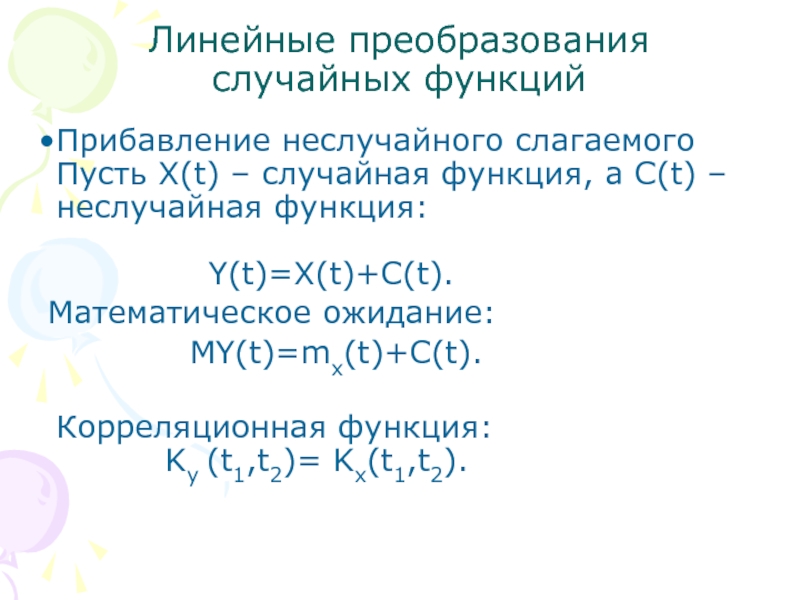

Слайд 13Линейные преобразования случайных функций

Прибавление неслучайного слагаемого

Пусть X(t) – случайная функция, а

Математическое ожидание:

MY(t)=mx(t)+C(t).

Корреляционная функция: Ky (t1,t2)= Kx(t1,t2).

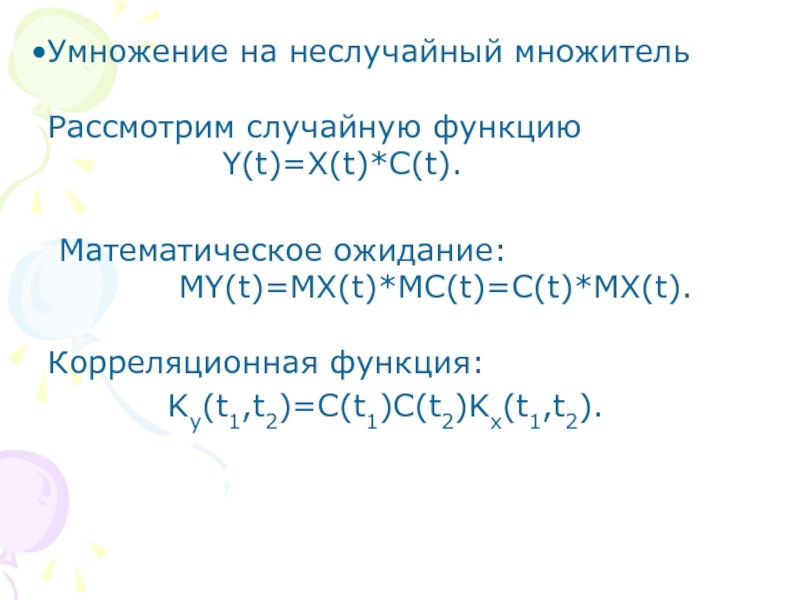

Слайд 14

Умножение на неслучайный множитель

Рассмотрим случайную функцию

Математическое ожидание: MY(t)=MX(t)*MC(t)=C(t)*MX(t). Корреляционная функция:

Ky(t1,t2)=C(t1)C(t2)Kx(t1,t2).

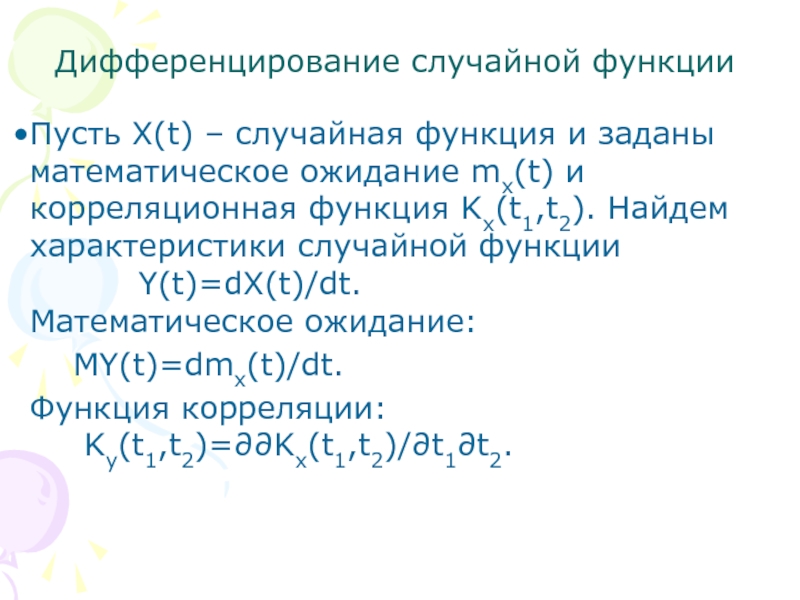

Слайд 15Дифференцирование случайной функции

Пусть X(t) – случайная функция и заданы математическое ожидание

MY(t)=dmx(t)/dt.

Функция корреляции: Ky(t1,t2)=∂∂Kx(t1,t2)/∂t1∂t2.

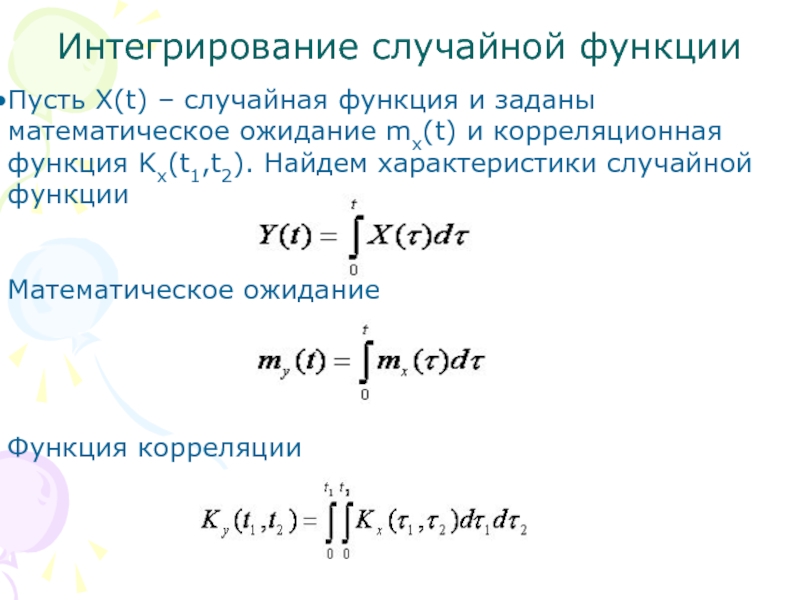

Слайд 16Интегрирование случайной функции

Пусть X(t) – случайная функция и заданы математическое ожидание

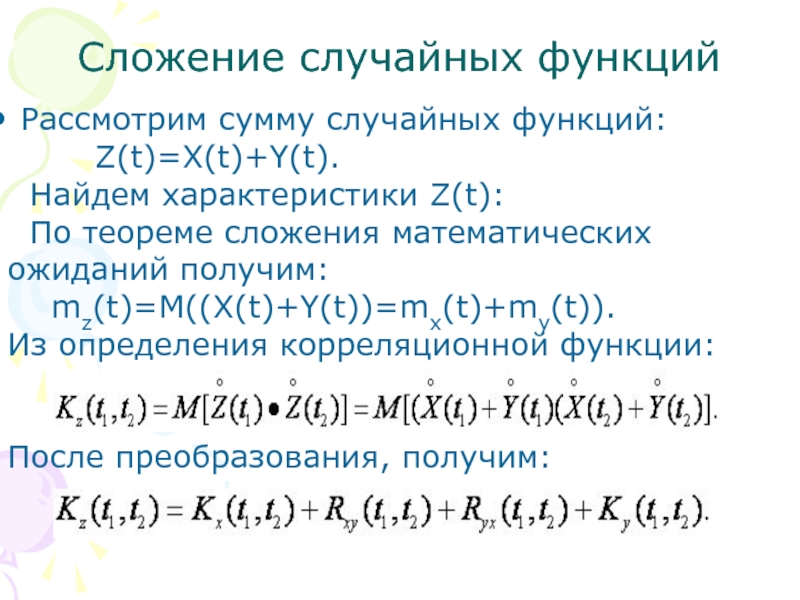

Слайд 17Сложение случайных функций

Рассмотрим сумму случайных функций:

Z(t)=X(t)+Y(t).

Слайд 18

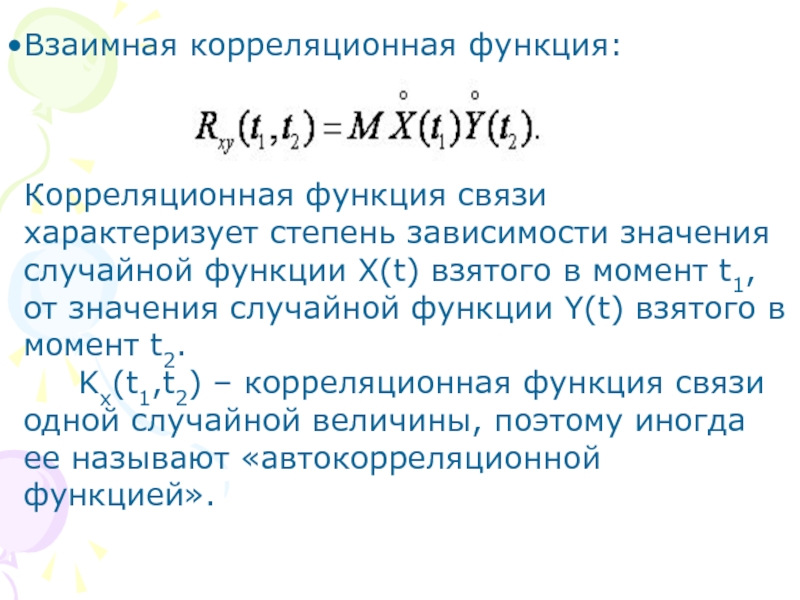

Взаимная корреляционная функция:

Корреляционная функция связи характеризует степень зависимости значения случайной функции

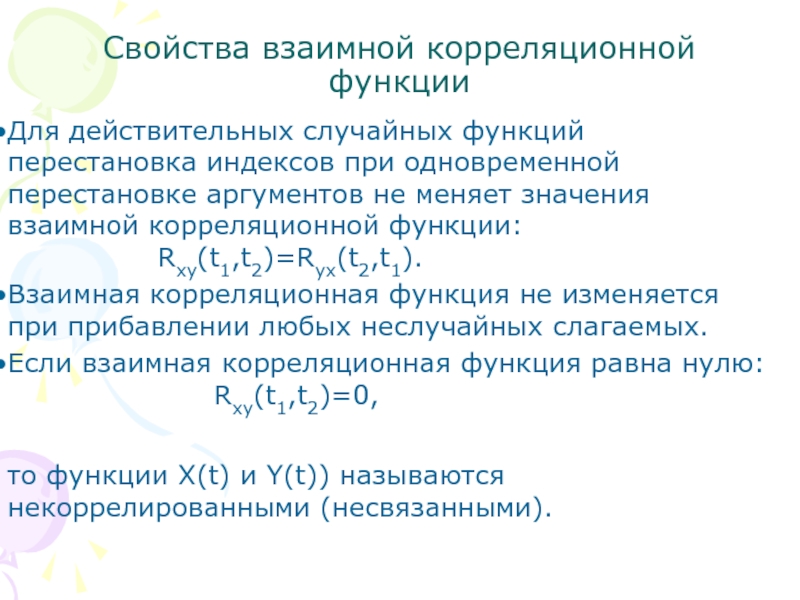

Слайд 19Свойства взаимной корреляционной функции

Для действительных случайных функций перестановка индексов при одновременной

Взаимная корреляционная функция не изменяется при прибавлении любых неслучайных слагаемых.

Если взаимная корреляционная функция равна нулю: Rxy(t1,t2)=0,

то функции X(t) и Y(t)) называются некоррелированными (несвязанными).

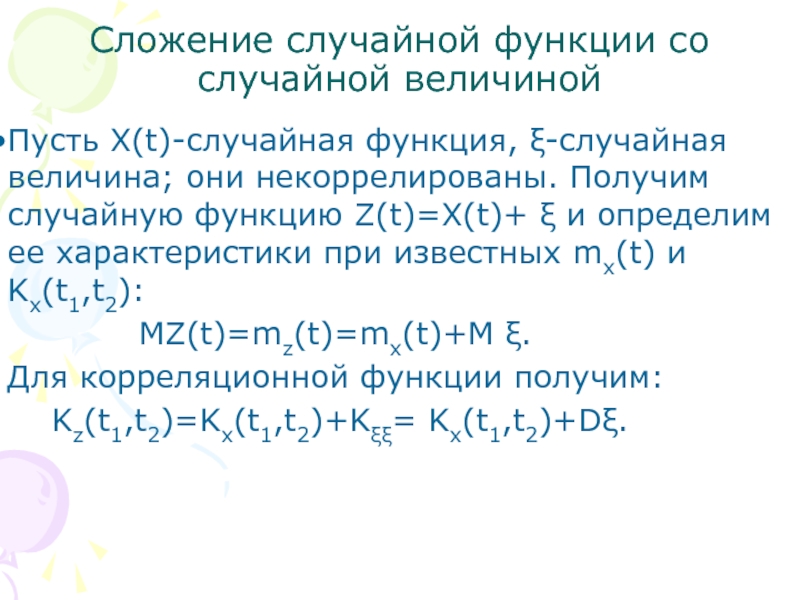

Слайд 20Сложение случайной функции со случайной величиной

Пусть X(t)-случайная функция, ξ-случайная величина; они

MZ(t)=mz(t)=mx(t)+M ξ.

Для корреляционной функции получим:

Kz(t1,t2)=Kx(t1,t2)+Kξξ= Kx(t1,t2)+Dξ.

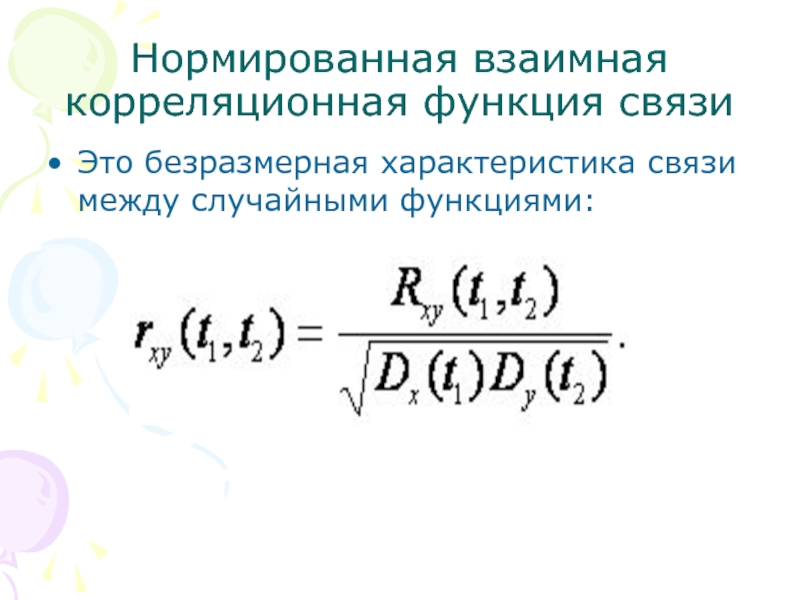

Слайд 21Нормированная взаимная корреляционная функция связи

Это безразмерная характеристика связи между случайными функциями:

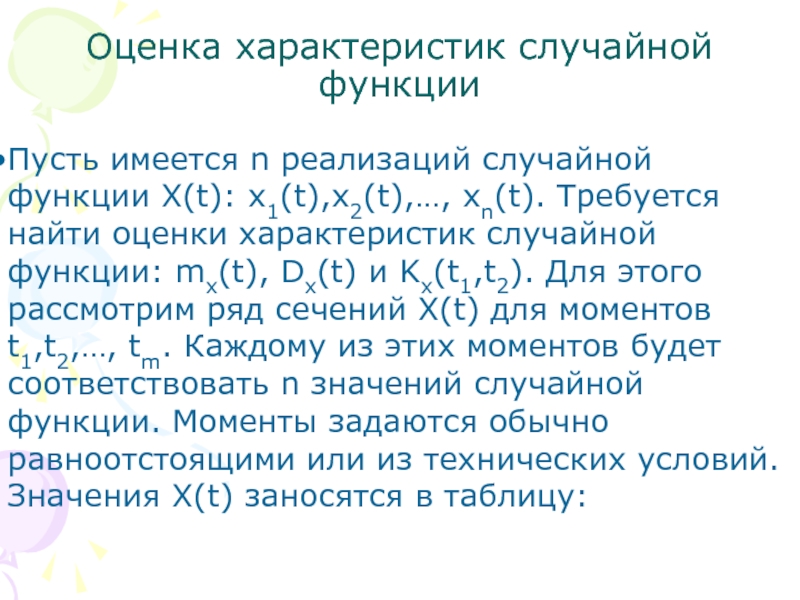

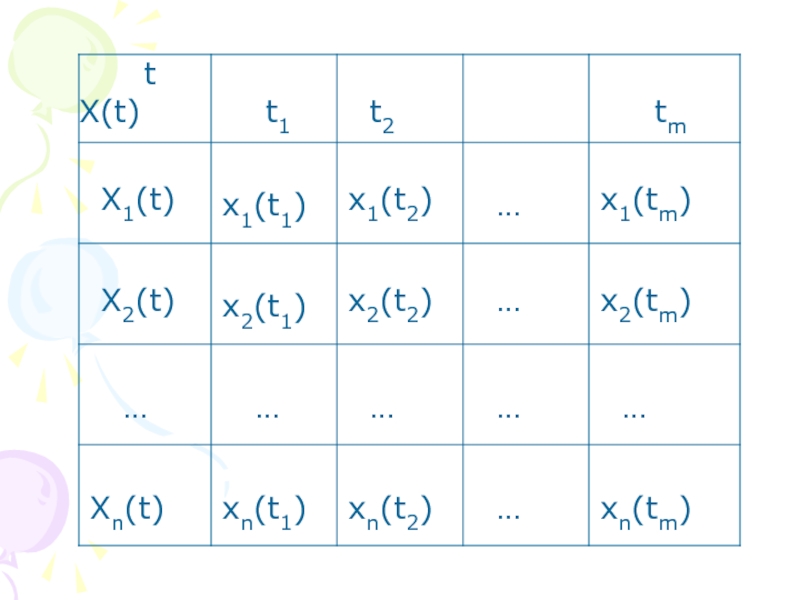

Слайд 22Оценка характеристик случайной функции

Пусть имеется n реализаций случайной функции X(t): x1(t),x2(t),…,

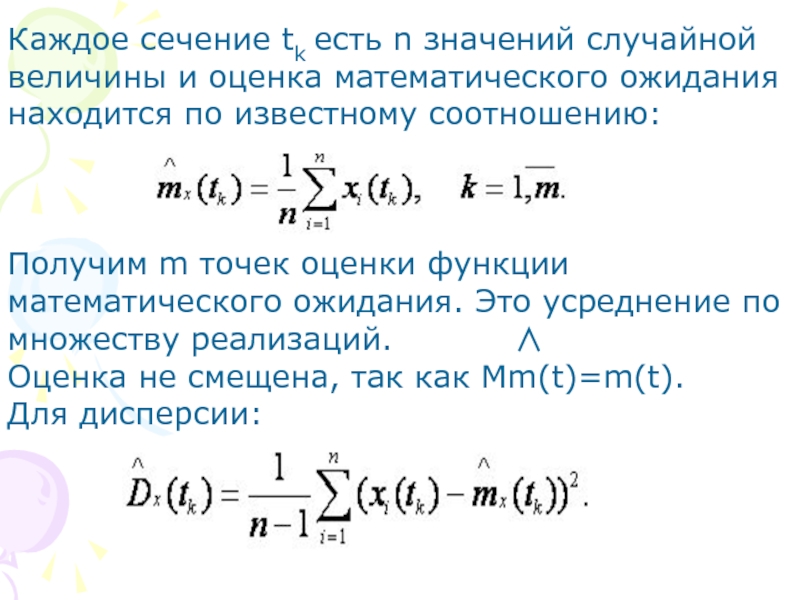

Слайд 24

Каждое сечение tk есть n значений случайной величины и оценка математического

Слайд 25

Для корреляционной функции:

По полученным значениям можно построить функцию математического ожидания и

Эти функции можно аппроксимировать аналитическими выражениями.

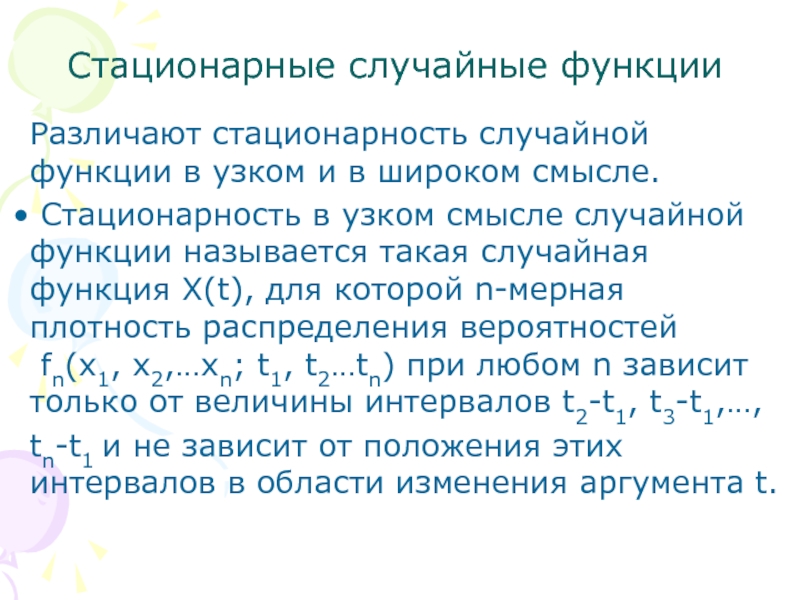

Слайд 26Стационарные случайные функции

Различают стационарность случайной функции в узком и в широком

Стационарность в узком смысле случайной функции называется такая случайная функция X(t), для которой n-мерная плотность распределения вероятностей fn(x1, x2,…xn; t1, t2…tn) при любом n зависит только от величины интервалов t2-t1, t3-t1,…,

tn-t1 и не зависит от положения этих интервалов в области изменения аргумента t.

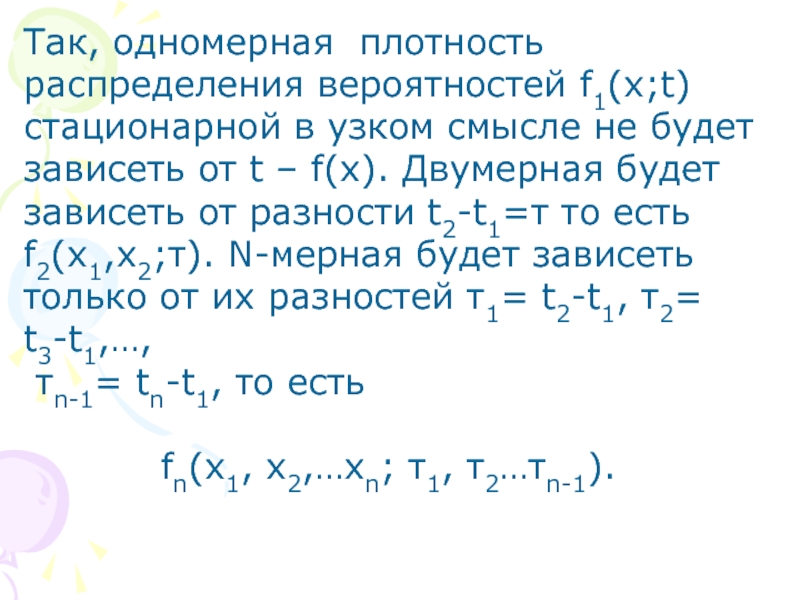

Слайд 27

Так, одномерная плотность распределения вероятностей f1(x;t) стационарной в узком смысле не

Слайд 28

Стационарная функция называется стационарной в широком смысле, если ее математическое ожидание

mx(t)=const; Kx(t1,t2)=Kx(τ).

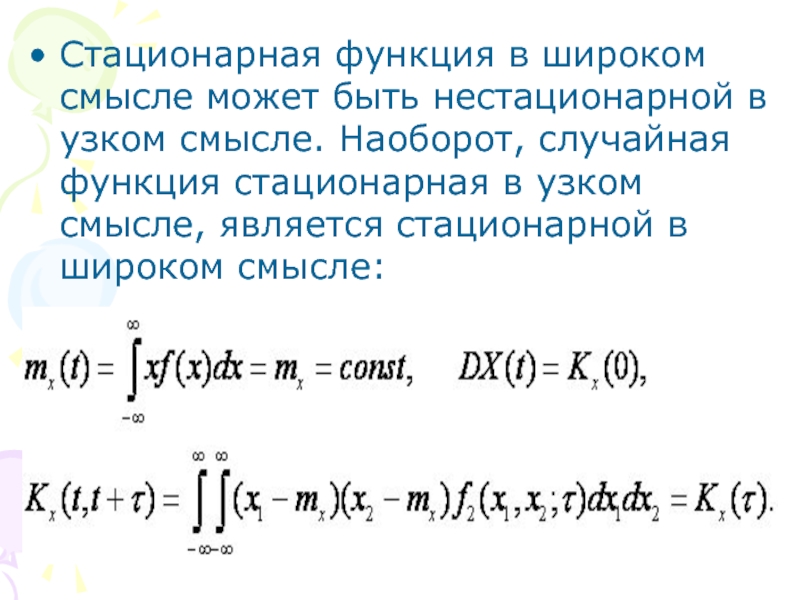

Слайд 29

Стационарная функция в широком смысле может быть нестационарной в узком смысле.

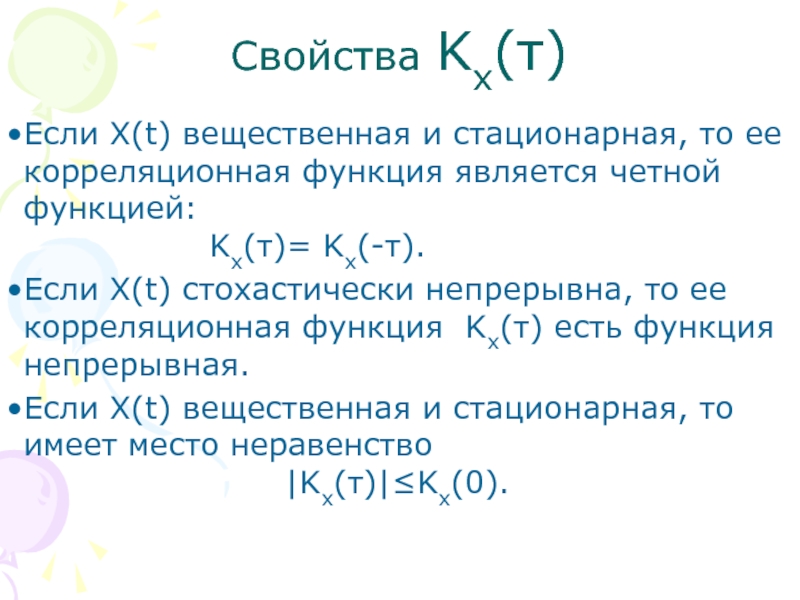

Слайд 30Свойства Kx(τ)

Если X(t) вещественная и стационарная, то ее корреляционная функция является

Если X(t) стохастически непрерывна, то ее корреляционная функция Kx(τ) есть функция непрерывная.

Если X(t) вещественная и стационарная, то имеет место неравенство |Kx(τ)|≤Kx(0).

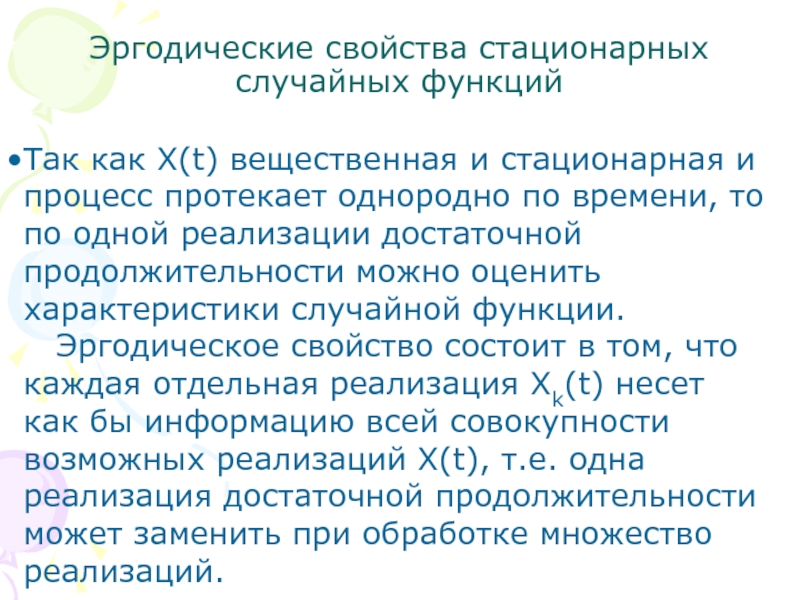

Слайд 31Эргодические свойства стационарных случайных функций

Так как X(t) вещественная и стационарная и

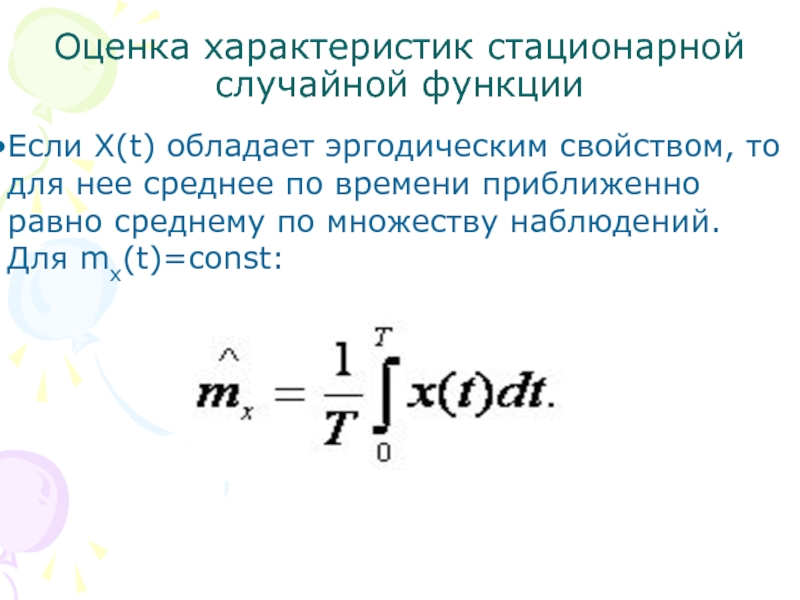

Слайд 32Оценка характеристик стационарной случайной функции

Если X(t) обладает эргодическим свойством, то для

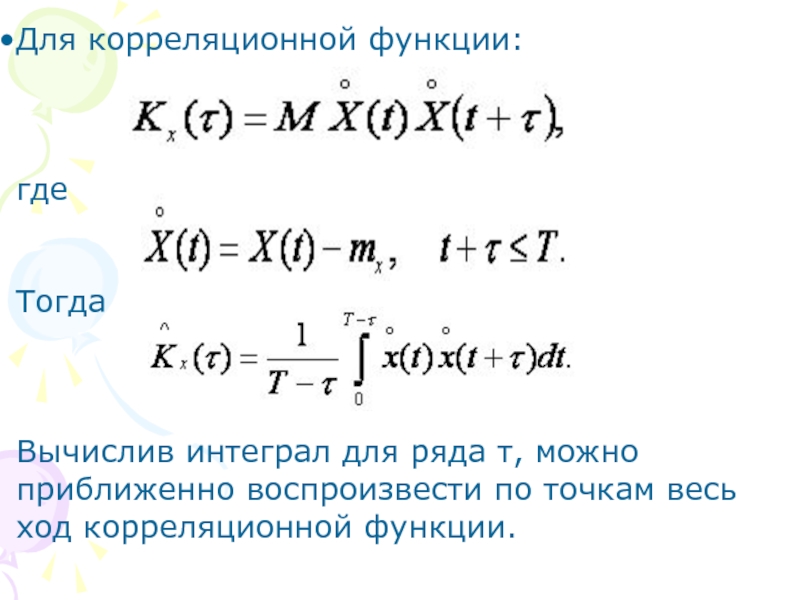

Слайд 33

Для корреляционной функции:

где

Тогда

Вычислив интеграл для ряда τ, можно приближенно воспроизвести по

Слайд 34

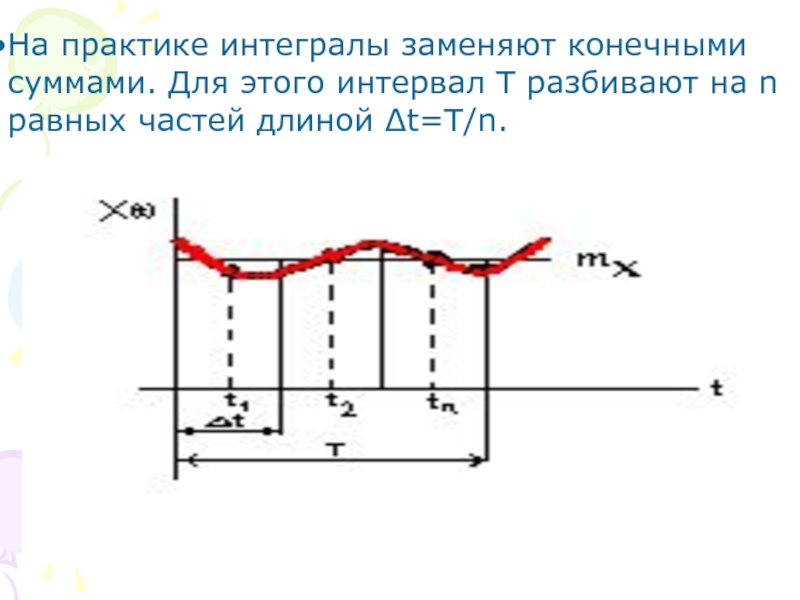

На практике интегралы заменяют конечными суммами. Для этого интервал Т разбивают

Слайд 35

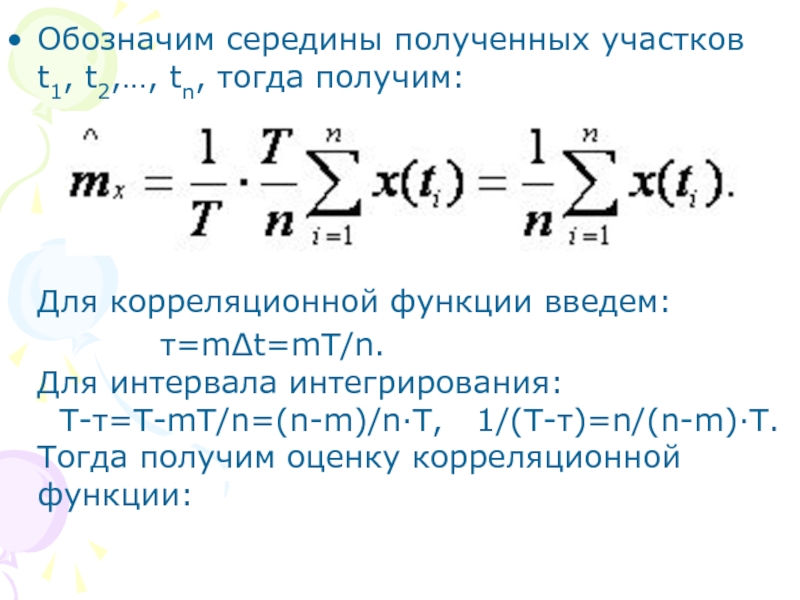

Обозначим середины полученных участков

t1, t2,…, tn, тогда получим:

Для корреляционной функции

τ=mΔt=mT/n. Для интервала интегрирования: T-τ=T-mT/n=(n-m)/n·T, 1/(T-τ)=n/(n-m)·T. Тогда получим оценку корреляционной функции:

Слайд 36

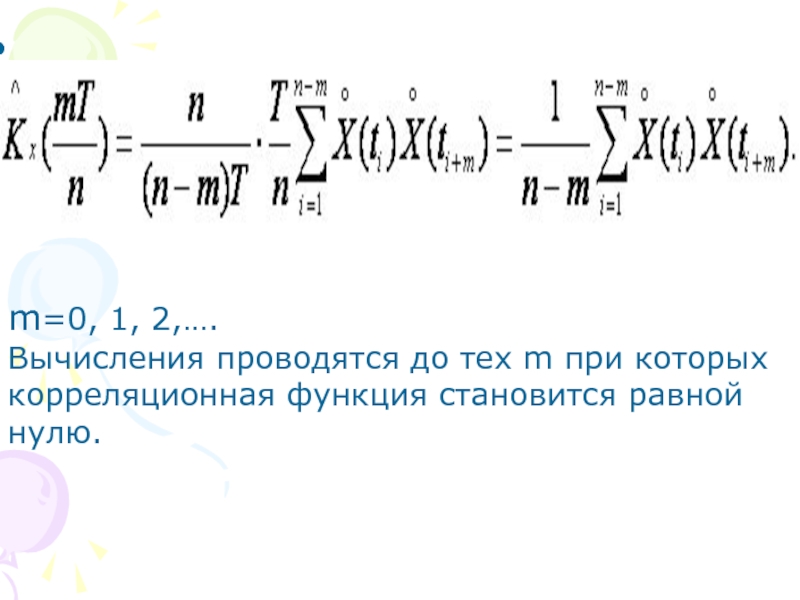

m=0, 1, 2,….

Вычисления проводятся до тех m при которых корреляционная функция

Слайд 37Марковский случайный процесс

Случайный процесс называется Марковским, если все вероятностные характеристики

Слайд 38

Пусть A={a1, a2,…, an} – пространство исходов эксперимента или

Слайд 39

Случайный процесс, протекающий в физической системе называется цепью Маркова, если переходы

Слайд 40

Вероятности перехода Р11, Р22, Р33 означают, что система остается в

Вероятности перехода из одного состояния в другое можно представить двумя способами.

Слайд 41Первый способ состоит в том, что вероятности перехода записываются в виде

Для Марковской цепи с тремя состояниями

а1, а2, а3 матрица имеет вид:

Матрица вероятностей перехода (стохастическая матрица) должна обладать условием, что сумма элементов каждой строки равна единице.

Слайд 42

Второй способ представления вероятностей перехода состоит в построении диаграммы перехода, когда

Слайд 43 При изучении Марковских цепей иногда возникает задача: найти вероятности

Слайд 44 Марковская цепь называется регулярной, если какая – либо степень

Слайд 45 Марковская цепь называется эргодической, если из каждого ее состояния

Слайд 46Моделирование случайных величин

Случайные величины моделируют

с помощью преобразований одного

Или

Значений случайной величины L,

равномерно распределенной в

интервале (0,1).

Слайд 47Моделирование дискретных случайных величин

Общий метод моделирования основан на следующем

которые связаны рекурсивными формулами

и моделирование производится по схеме

Слайд 51Моделирование непрерывных случайных величин

Случайная величина моделируется по

формуле вида:

где φ(L) – строго монотонная и непрерывная функция на

интервале (0,1). Для случайной величины ξ задана плотность

распределения f(x) на интервале (а, в). Для монотонно

возрастающей функции φ(L) моделирующая формула для

непрерывной случайной ξ запишется в виде

Слайд 52Для монотонно убывающей функции φ(L)

моделирующая формула для непрерывной

случайной ξ

которая эквивалентна предыдущей формуле

т. к. случайные величины 1-L и L одинаково

распределены.

Слайд 53Для экспоненциального закона

Плотность вероятностей экспоненциального закона имеет вид

Функция распределения

Из этих соотношений определяется формула для

Моделирования экспоненциального закона