- Главная

- Разное

- Дизайн

- Бизнес и предпринимательство

- Аналитика

- Образование

- Развлечения

- Красота и здоровье

- Финансы

- Государство

- Путешествия

- Спорт

- Недвижимость

- Армия

- Графика

- Культурология

- Еда и кулинария

- Лингвистика

- Английский язык

- Астрономия

- Алгебра

- Биология

- География

- Детские презентации

- Информатика

- История

- Литература

- Маркетинг

- Математика

- Медицина

- Менеджмент

- Музыка

- МХК

- Немецкий язык

- ОБЖ

- Обществознание

- Окружающий мир

- Педагогика

- Русский язык

- Технология

- Физика

- Философия

- Химия

- Шаблоны, картинки для презентаций

- Экология

- Экономика

- Юриспруденция

OpenMP презентация

Содержание

- 1. OpenMP

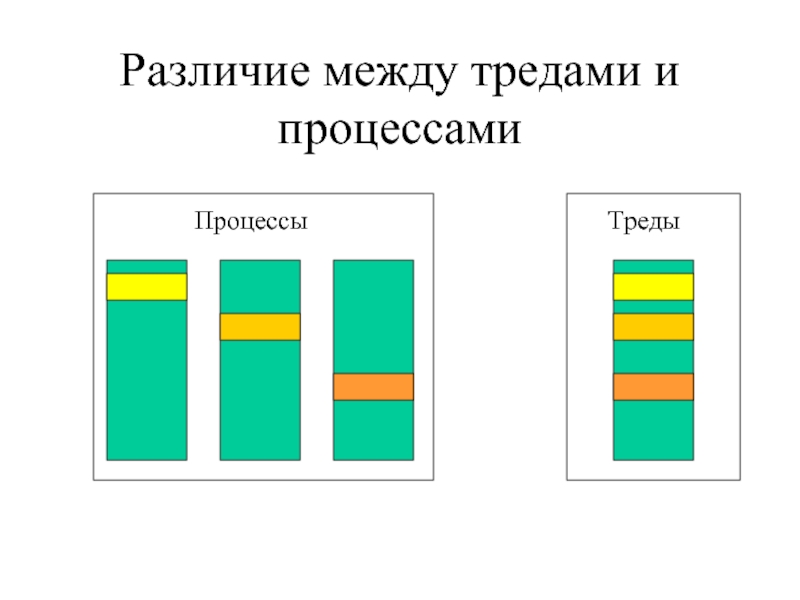

- 2. Различие между тредами и процессами

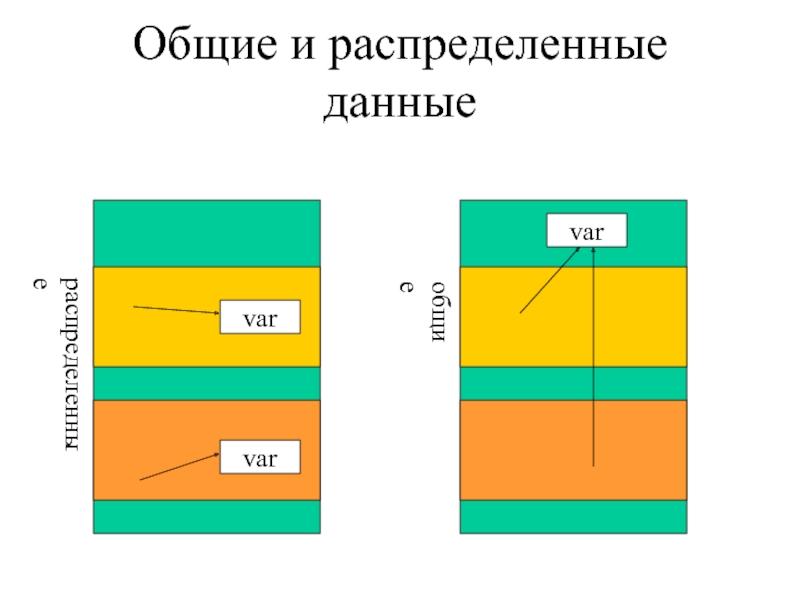

- 3. Общие и распределенные данные var var var распределенные общие

- 4. Архитектура OpenMP Приложение OpenMP компилятор

- 5. Модель выполнения OpenMP приложения

- 6. Работа с вычислительным пространством Мастер-тред имеет

- 7. Общий синтаксис директив OpenMP #pragma omp directive_name

- 8. Директива parallel Данная директива – единственный

- 9. #include main () {

- 10. Опции для данных Данные, видимые в области,

- 11. Опция firstprivate Опция firstprivate обладает той

- 12. Опция default Опция default задает опцию

- 13. опция reduction Опция reduction определяет что

- 14. Глобальные общие данные Проблема: опция private «работает»

- 15. Директива threadprivate #omp threadprivate (список глобальных переменных)

- 16. Опция copyin Опция copyin директивы

- 17. Управление распределением вычислений Для распределения вычислений

- 18. Директива for #pragma omp for [clause ...]

- 19. Директива предшествует циклу for канонического типа:

- 20. incr_expr ::= var ++ ++ var

- 21. Опция shedule директивы for Опция shedule допускает

- 22. Особенности опции schedule директивы for

- 23. #include #define CHUNK 10 #define

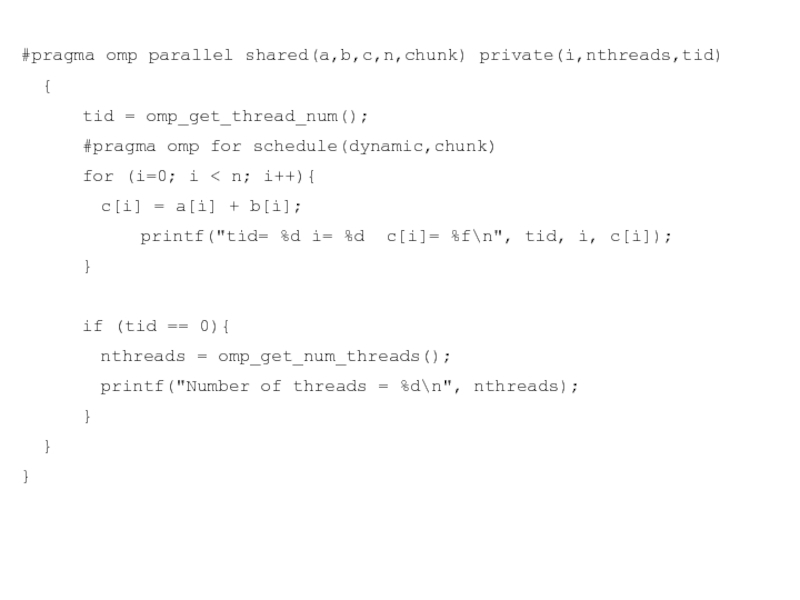

- 24. #pragma omp parallel shared(a,b,c,n,chunk) private(i,nthreads,tid) {

- 25. Директива sections #pragma omp sections [clause ...]

- 26. #include #define N 50

- 27. #pragma omp sections nowait

- 28. if (tid == 0)

- 29. Директива single #pragma omp single [clause ...]

- 30. Директивы синхронизации master critical barrier atomic flush ordered

- 31. Неконстинстентность данных

- 32. #pragma omp master определяет секцию кода, выполняемого

- 33. #pragma omp atomic ::==

- 34. #paragma omp flush [var-list] ::==

- 35. Решение уравнения Пуассона методом верхней релаксации d2u/dx2

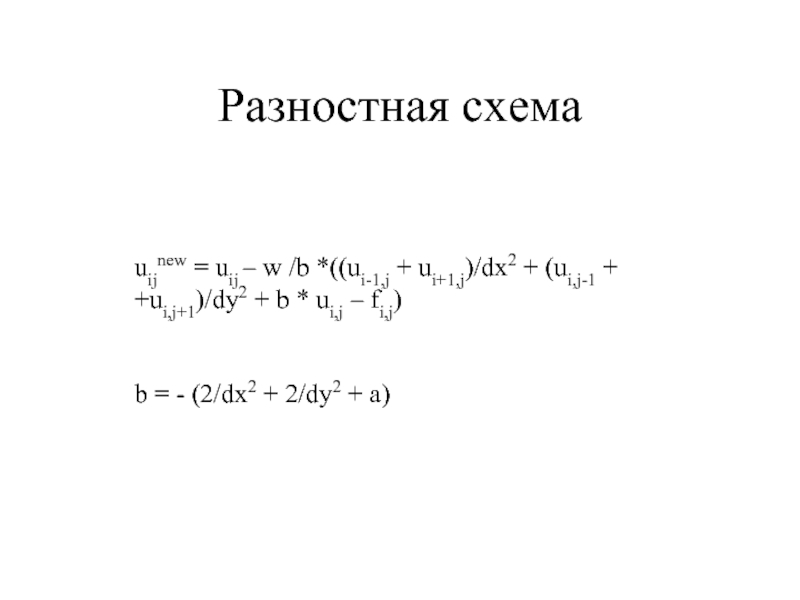

- 36. Разностная схема uijnew = uij – w

- 37. jacobi.f.txt

Слайд 4Архитектура OpenMP

Приложение

OpenMP

компилятор

OpenMP библиотека

Треды ОС

Пользователь

Переменные

среды

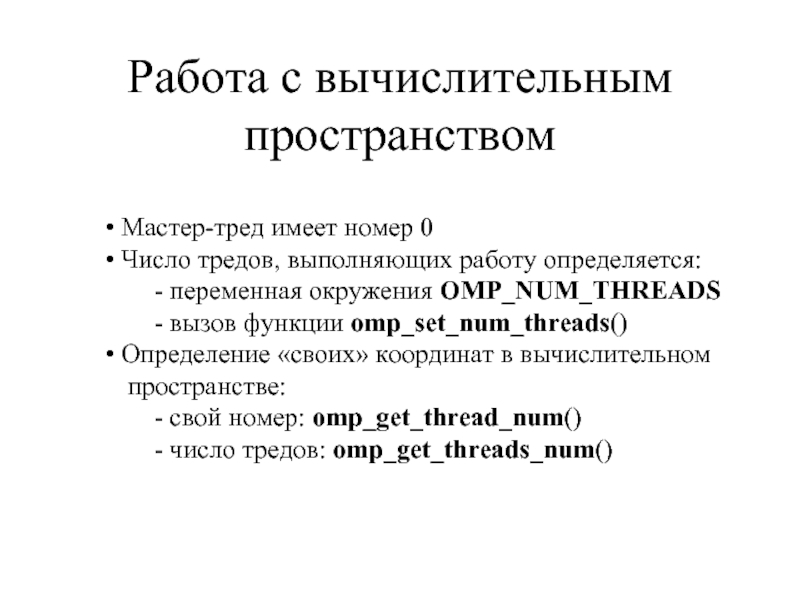

Слайд 6Работа с вычислительным пространством

Мастер-тред имеет номер 0

Число тредов, выполняющих

- переменная окружения OMP_NUM_THREADS

- вызов функции omp_set_num_threads()

Определение «своих» координат в вычислительном

пространстве:

- свой номер: omp_get_thread_num()

- число тредов: omp_get_threads_num()

Слайд 7Общий синтаксис директив OpenMP

#pragma omp directive_name [clause[clause ...]] newline

Действия, соответствующие директиве

непосредственно к структурному блоку, расположенному за

директивой. Структурным блоком может быть любой оператор,

имеющий единственный вход и единственный выход.

Если директива расположена на файловом уровне видимости, то

она применяется ко всему файлу.

Слайд 8Директива parallel

Данная директива – единственный способ инициировать

параллельное выполнение программы.

#pragma omp parallel

clause: if (scalar_expression)

private (list)

shared (list)

default (shared | none)

firstprivate (list)

reduction (operator: list)

copyin (list)

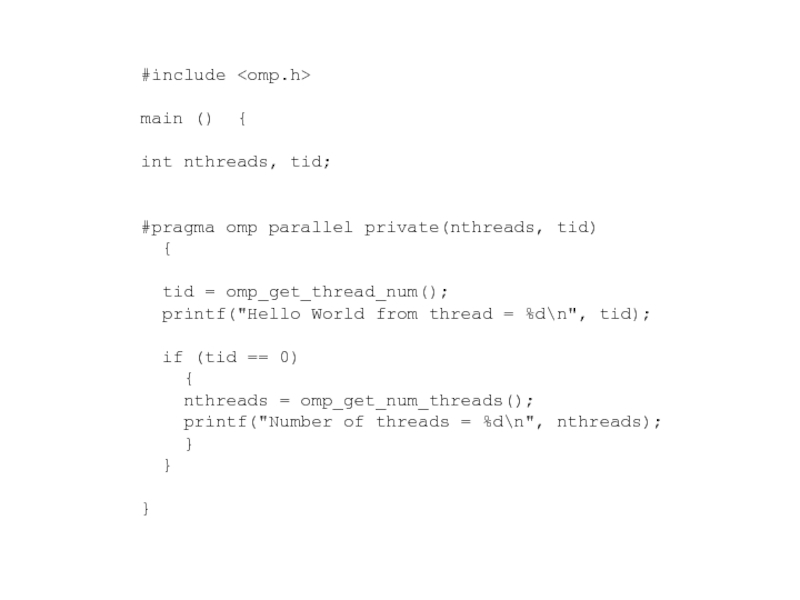

Слайд 9#include

main () {

int nthreads, tid;

#pragma omp parallel private(nthreads, tid)

{

printf("Hello World from thread = %d\n", tid);

if (tid == 0)

{

nthreads = omp_get_num_threads();

printf("Number of threads = %d\n", nthreads);

}

}

}

Слайд 10Опции для данных

Данные, видимые в области, объемлющей блок параллельного

исполнения, являются общими

объявленные внутри блока п.и. считаются распределенными

(private).

Опция private задает список распределенных переменных.

Только shared-переменные в объемлющей параллельном блоке могут быть аргументами опции private

Опция private

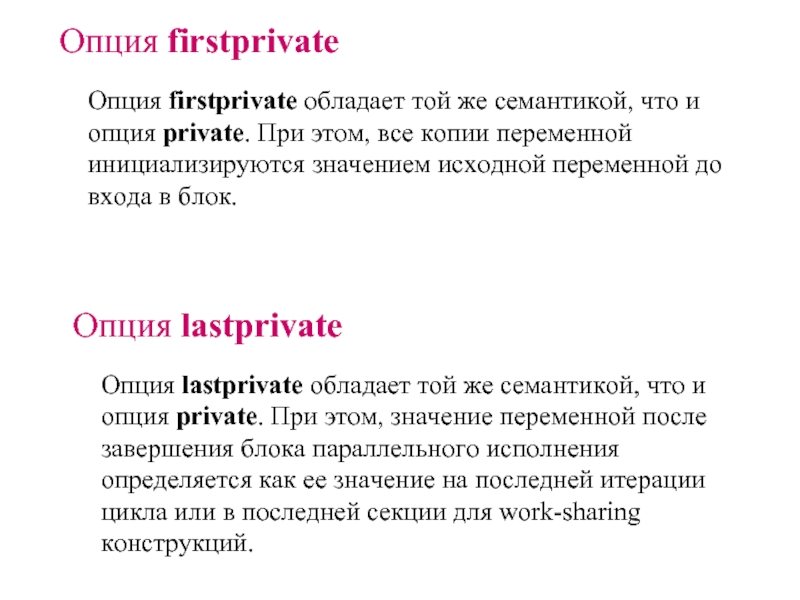

Слайд 11Опция firstprivate

Опция firstprivate обладает той же семантикой, что и

опция private.

Опция lastprivate

Опция lastprivate обладает той же семантикой, что и

опция private. При этом, значение переменной после завершения блока параллельного исполнения определяется как ее значение на последней итерации цикла или в последней секции для work-sharing конструкций.

Слайд 12Опция default

Опция default задает опцию по-умолчанию для

переменных. Пример:

#pragma omp parallel default(private)

Опция

Опция shared задает список общих переменных.

#pragma omp parallel default(private) shared(x)

Слайд 13опция reduction

Опция reduction определяет что на выходе из параллельного блока переменная

#pragma omp for reduction(+ : x)

Допустимы следующие операции: +, *, -, &, |, ^, &&, ||

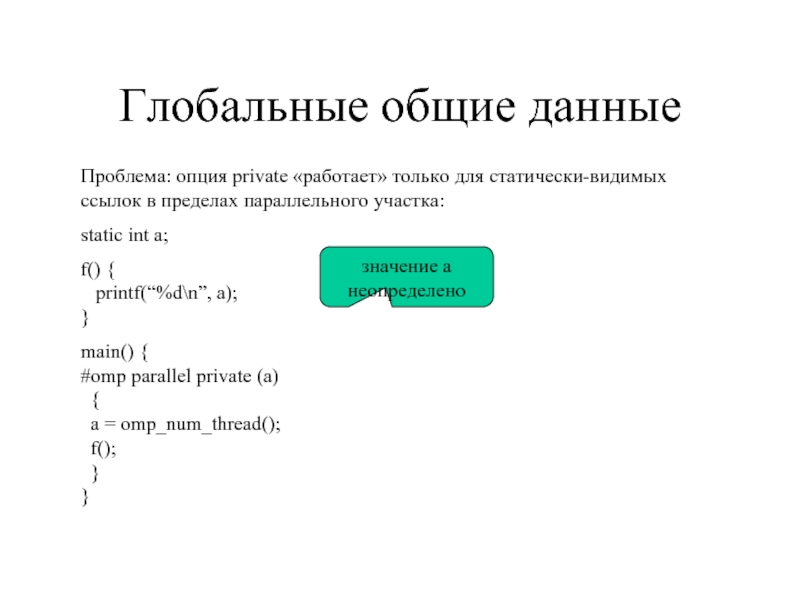

Слайд 14Глобальные общие данные

Проблема: опция private «работает» только для статически-видимых ссылок в

static int a;

f() { printf(“%d\n”, a); }

main() { #omp parallel private (a) { a = omp_num_thread(); f(); } }

значение a неопределено

Слайд 15Директива threadprivate

#omp threadprivate (список глобальных переменных)

переменные становятся общими для всех тредов:

static

f() { printf(“%d\n”, a); }

main() { #omp threadprivate(a)

#omp parallel { a = omp_num_thread(); f(); } }

Слайд 16Опция copyin

Опция copyin директивы parallel определяет порядок инициализации threadprivate-переменных: эти

Слайд 17Управление распределением

вычислений

Для распределения вычислений применяются

конструкции:

for

sections

single

Слайд 18Директива for

#pragma omp for [clause ...]

clause:

ordered

private (list)

firstprivate (list)

lastprivate (list)

reduction (operator: list)

nowait

Слайд 19

Директива предшествует циклу for канонического типа:

for(init-expr, var logical_op b, incr_expr)

init_expr

logical_op >, <, >=, <=

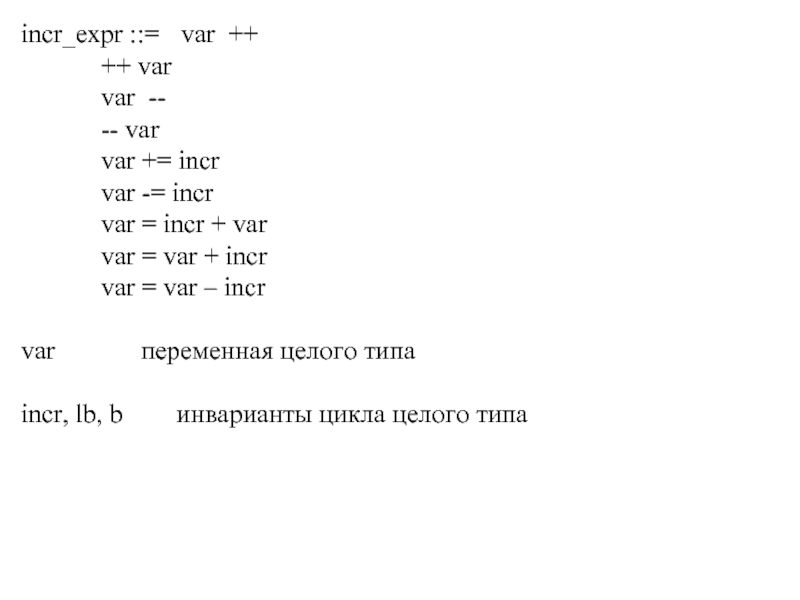

Слайд 20incr_expr ::= var ++

++ var

var --

-- var

var += incr

var -=

var = incr + var

var = var + incr

var = var – incr

var переменная целого типа

incr, lb, b инварианты цикла целого типа

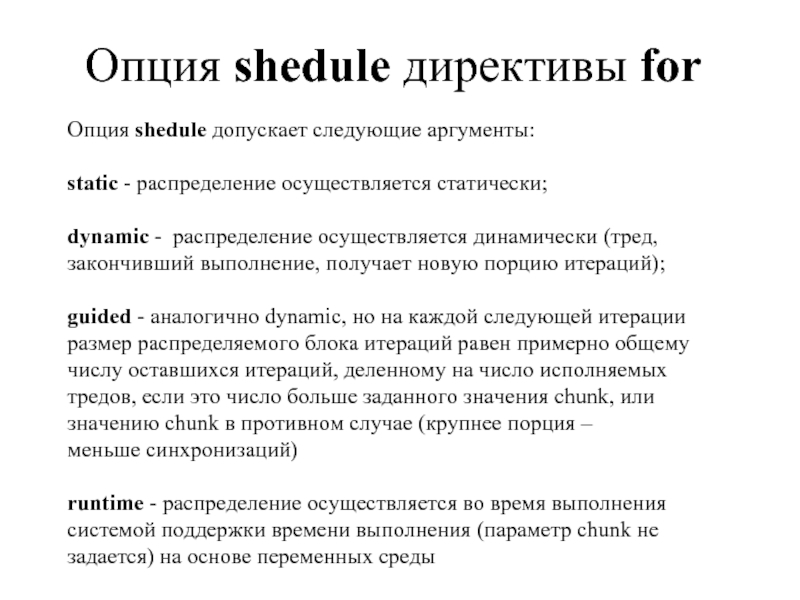

Слайд 21Опция shedule директивы for

Опция shedule допускает следующие аргументы:

static - распределение осуществляется

dynamic - распределение осуществляется динамически (тред,

закончивший выполнение, получает новую порцию итераций);

guided - аналогично dynamic, но на каждой следующей итерации

размер распределяемого блока итераций равен примерно общему

числу оставшихся итераций, деленному на число исполняемых

тредов, если это число больше заданного значения chunk, или

значению chunk в противном случае (крупнее порция – меньше синхронизаций)

runtime - распределение осуществляется во время выполнения

системой поддержки времени выполнения (параметр chunk не

задается) на основе переменных среды

Слайд 22Особенности опции schedule директивы for

аргумент chunk можноиспользовать только вместе с

по умолчанию chunk считается равным 1

распараллеливание с помощью опции runtime осуществляется используя значение переменной OMP_SCHEDULE Пример. setenv OMP_SCHEDULE “guided,4”

Слайд 23#include

#define CHUNK 10

#define N 100

main ()

int nthreads, tid, i, n, chunk;

float a[N], b[N], c[N];

for (i=0; i < N; i++)

a[i] = b[i] = i * 1.0;

n = N;

chunk = CHUNK;

Слайд 24#pragma omp parallel shared(a,b,c,n,chunk) private(i,nthreads,tid)

{

tid = omp_get_thread_num();

#pragma omp

for (i=0; i < n; i++){

c[i] = a[i] + b[i];

printf("tid= %d i= %d c[i]= %f\n", tid, i, c[i]);

}

if (tid == 0){

nthreads = omp_get_num_threads();

printf("Number of threads = %d\n", nthreads);

}

}

}

Слайд 25Директива sections

#pragma omp sections [clause ...]

structured_block

clause:

firstprivate (list)

lastprivate (list)

reduction (operator: list)

nowait

{

#pragma omp section

structured_block

#pragma omp section

structured_block

}

Слайд 26#include

#define N 50

main ()

{

int i, n, nthreads, tid;

float

for (i=0; i < N; i++)

a[i] = b[i] = i * 1.0;

n = N;

#pragma omp parallel shared(a,b,c,n) private(i,tid,nthreads)

{

tid = omp_get_thread_num();

printf("Thread %d starting...\n",tid);

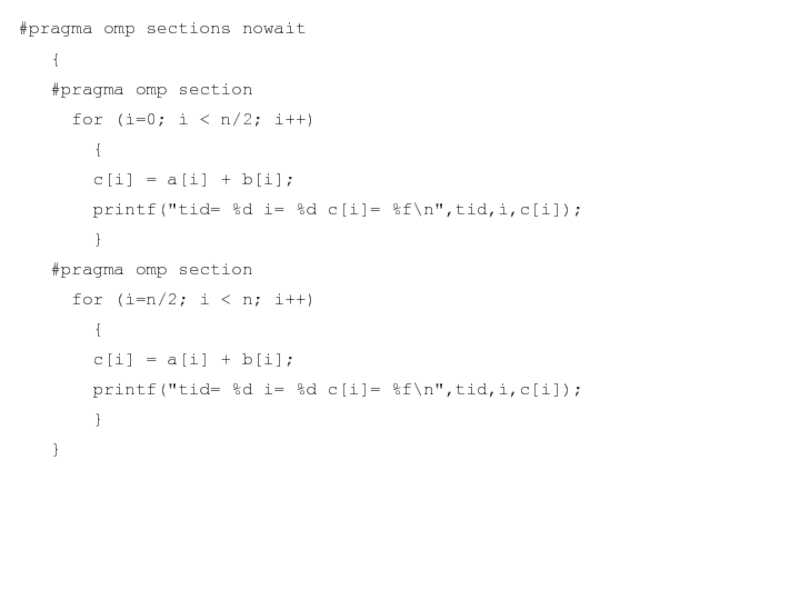

Слайд 27 #pragma omp sections nowait

{

#pragma omp section

{

c[i] = a[i] + b[i];

printf("tid= %d i= %d c[i]= %f\n",tid,i,c[i]);

}

#pragma omp section

for (i=n/2; i < n; i++)

{

c[i] = a[i] + b[i];

printf("tid= %d i= %d c[i]= %f\n",tid,i,c[i]);

}

}

Слайд 28

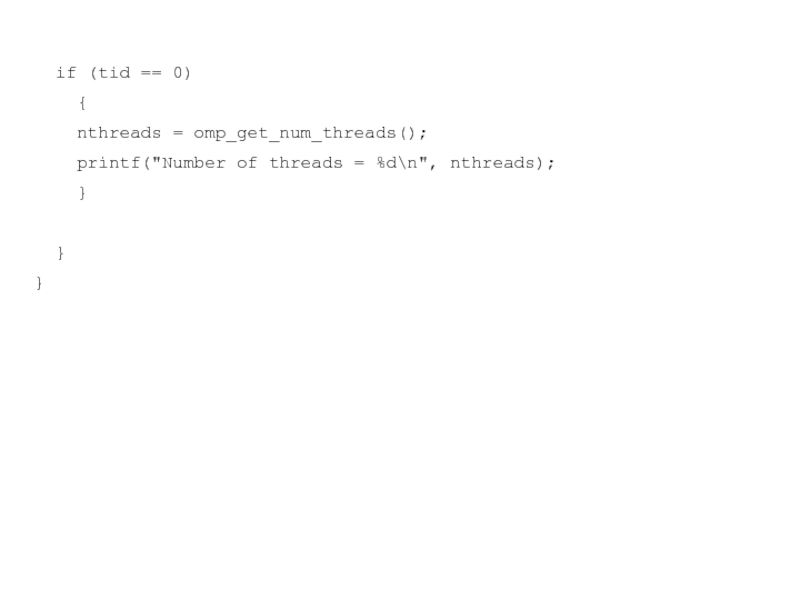

if (tid == 0)

{

nthreads = omp_get_num_threads();

}

}

}

Слайд 29Директива single

#pragma omp single [clause ...]

structured_block

Директива single определяет что последующий

блок

Слайд 32#pragma omp master

определяет секцию кода, выполняемого только master-тредом

#pragma omp critical [(name)]

определяет

#pragma omp barrier

определяет секцию кода, выполняемого только одним тредом в данный момент времени

Слайд 34#paragma omp flush [var-list]

::==

x binop = expr

x ++

++ x

x

-- x

Следующие содержат неявный flush: barrier, вход и выход из critical, ordered, выход из parallel, for, sections, single

Слайд 35Решение уравнения Пуассона

методом верхней релаксации

d2u/dx2 + d2u/dy2 – a * u

1

1

-1

-1

(1-x2)(1-y2)

Слайд 36Разностная схема

uijnew = uij – w /b *((ui-1,j + ui+1,j)/dx2 +

b = - (2/dx2 + 2/dy2 + a)

![Общий синтаксис директив OpenMP#pragma omp directive_name [clause[clause ...]] newlineДействия, соответствующие директиве применяются непосредственно к структурному](/img/tmb/3/210126/a9b04748c780931cd24a12ae14192171-800x.jpg)

![Директива parallelДанная директива – единственный способ инициироватьпараллельное выполнение программы.#pragma omp parallel [clause ...]clause:](/img/tmb/3/210126/300372cbbd4c1c31e84d096da9c52fb6-800x.jpg)

![Директива for#pragma omp for [clause ...] clause: schedule (type [,chunk])](/img/tmb/3/210126/41d774ce2796e4b8802b27d336307244-800x.jpg)

![#include #define CHUNK 10#define N 100main () {int nthreads, tid, i, n, chunk;float a[N],](/img/tmb/3/210126/a4d2e02d80f3fed69c5747c30837e2ed-800x.jpg)

![Директива sections#pragma omp sections [clause ...]structured_blockclause: private (list)](/img/tmb/3/210126/04f9684da28c8d27812d5f8e98b21717-800x.jpg)

![#include #define N 50main (){int i, n, nthreads, tid;float a[N], b[N], c[N];for (i=0; i](/img/tmb/3/210126/24d33472bfb6ac068dc0965049ac6254-800x.jpg)

![Директива single#pragma omp single [clause ...] structured_blockДиректива single определяет что последующийблок будет выполняться только одним тредом](/img/tmb/3/210126/57399a8c984802c51ea3a90737db0471-800x.jpg)

![#pragma omp master определяет секцию кода, выполняемого только master-тредом#pragma omp critical [(name)] определяет секцию кода, выполняемого только](/img/tmb/3/210126/4b963d54434dbd5ed4cf0eea38e7136d-800x.jpg)

![#paragma omp flush [var-list] ::== x binop = expr x ++ ++ x x -- -- xСледующие содержат неявный](/img/tmb/3/210126/65b0c36f9297e51aec3f19019b692cb2-800x.jpg)