- Главная

- Разное

- Дизайн

- Бизнес и предпринимательство

- Аналитика

- Образование

- Развлечения

- Красота и здоровье

- Финансы

- Государство

- Путешествия

- Спорт

- Недвижимость

- Армия

- Графика

- Культурология

- Еда и кулинария

- Лингвистика

- Английский язык

- Астрономия

- Алгебра

- Биология

- География

- Детские презентации

- Информатика

- История

- Литература

- Маркетинг

- Математика

- Медицина

- Менеджмент

- Музыка

- МХК

- Немецкий язык

- ОБЖ

- Обществознание

- Окружающий мир

- Педагогика

- Русский язык

- Технология

- Физика

- Философия

- Химия

- Шаблоны, картинки для презентаций

- Экология

- Экономика

- Юриспруденция

Оверхайп машинного и глубинного обучения презентация

Содержание

- 1. Оверхайп машинного и глубинного обучения

- 2. ПОЧЕМУ Я Лауреат премии while true года;

- 3. НАШ МАЛЕНЬКИЙ ROADMAP Немного истории; Основы машинного

- 4. ВЕХИ Машина Паскаля 1642г. Артур Самуэль,

- 5. ВЕХИ 1936 AT&T Bell Labs создает

- 6. ОСНОВНЫЕ ТЕРМИНЫ Основные понятия и обозначения: Данные

- 7. МАШИННОЕ ОБУЧЕНИЕ Наука о том как проводить

- 8. СРАЗУ К ПРИМЕРАМ Задача: отличить осмысленный текст

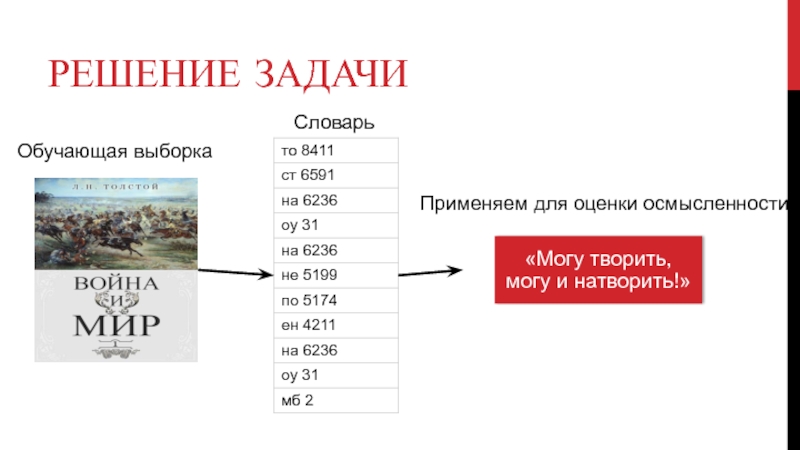

- 9. РЕШЕНИЕ ЗАДАЧИ Обучающая выборка Словарь Применяем для оценки осмысленности

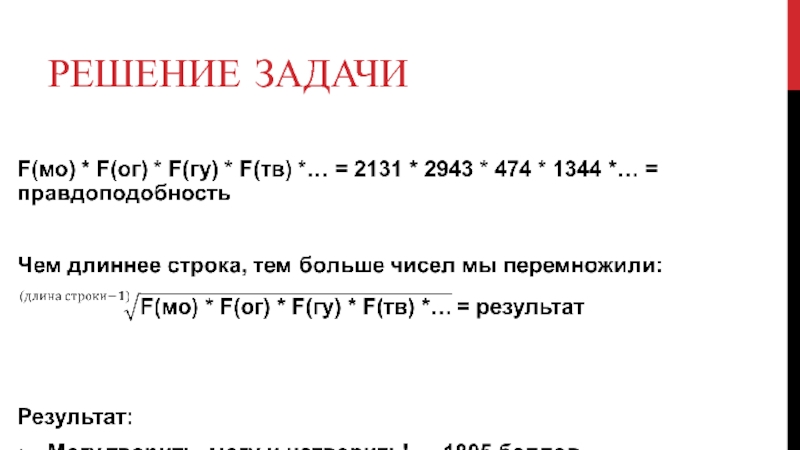

- 10. РЕШЕНИЕ ЗАДАЧИ

- 11. ОБУЧЕНИЕ И МОДЕЛЬ Обучающая выборка: Правильные и

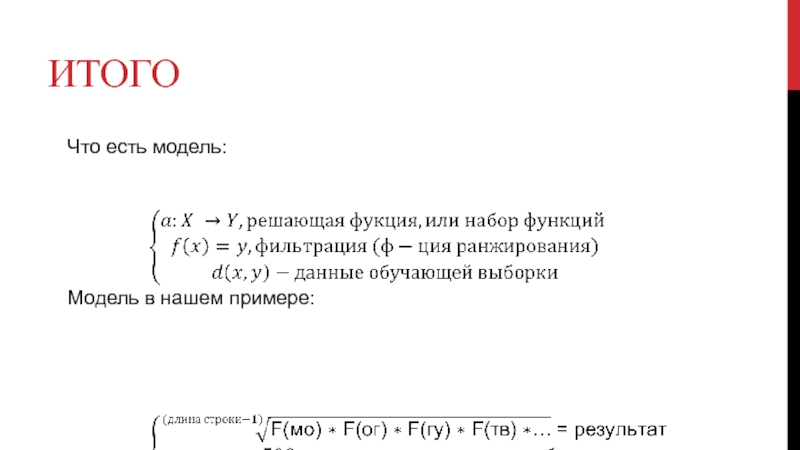

- 12. ИТОГО Что есть модель: Модель в нашем примере:

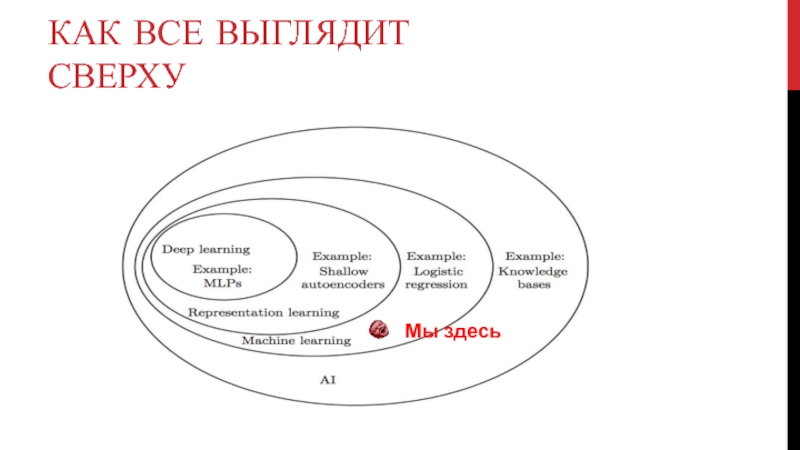

- 13. КАК ВСЕ ВЫГЛЯДИТ СВЕРХУ Мы здесь

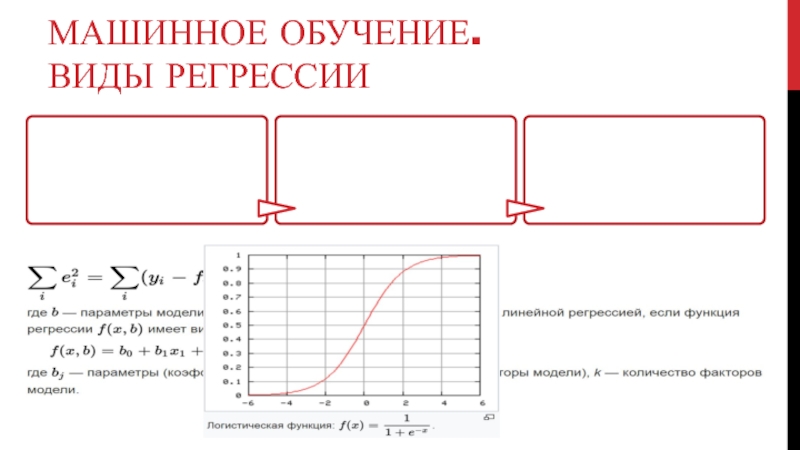

- 14. МАШИННОЕ ОБУЧЕНИЕ. ВИДЫ РЕГРЕССИИ

- 15. КАК РАБОТАЮТ НЕЙРОННЫЕ СЕТИ Нейронные сети обучаются.

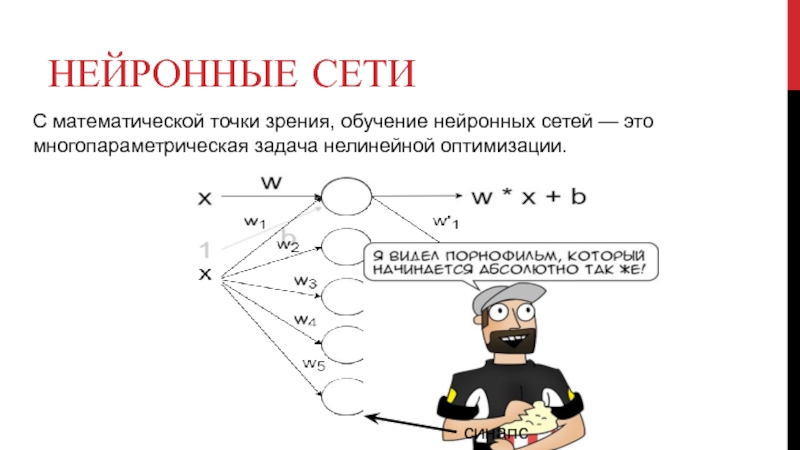

- 16. НЕЙРОННЫЕ СЕТИ С математической точки зрения, обучение

- 17. КАК РАБОТАЕТ НЕЙРОННАЯ СЕТЬ Вход Ф-ция активации

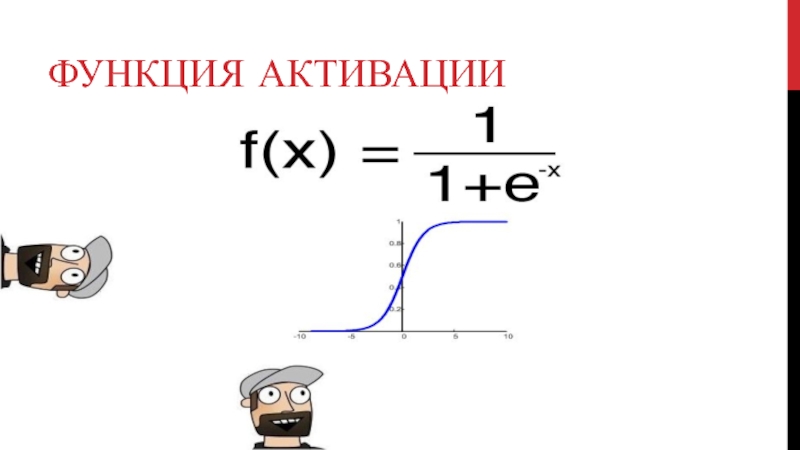

- 18. ФУНКЦИЯ АКТИВАЦИИ

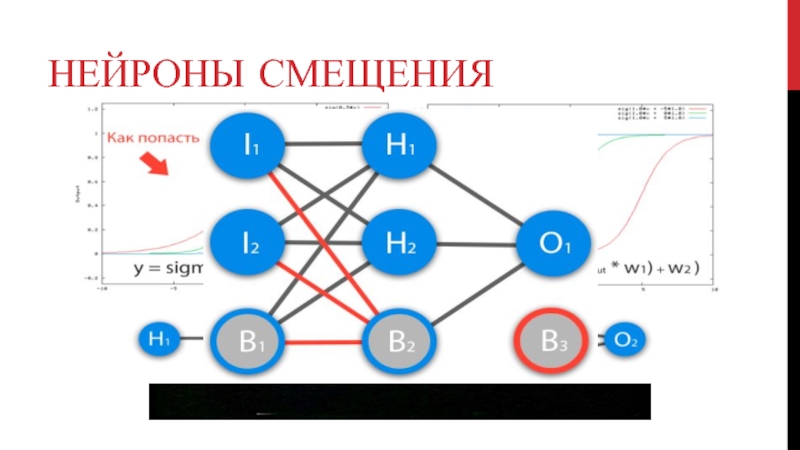

- 19. НЕЙРОНЫ СМЕЩЕНИЯ

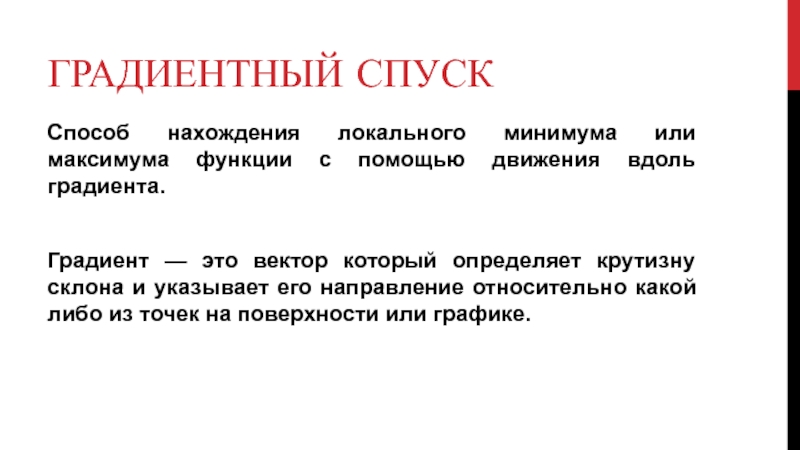

- 20. ГРАДИЕНТНЫЙ СПУСК Способ нахождения локального минимума или

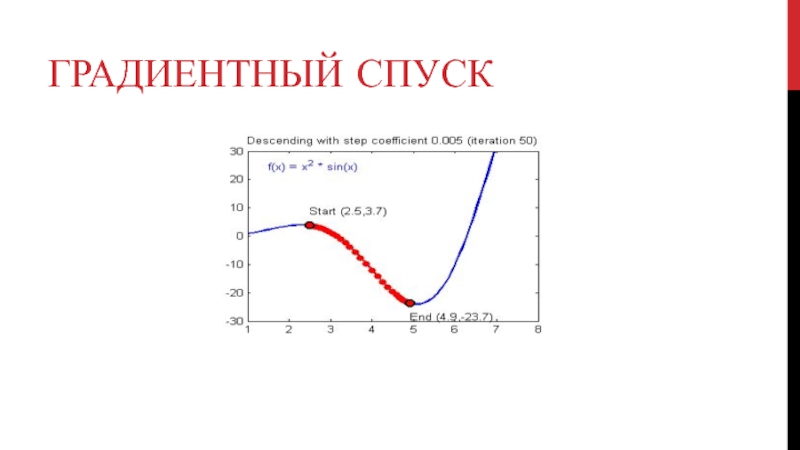

- 21. ГРАДИЕНТНЫЙ СПУСК

- 22. ГРАДИЕНТНЫЙ СПУСК

- 23. МЕТОД ОБРАТНОГО РАСПРОСТРАНЕНИЯ ОШИБКИ

- 24. ИТОГО Считаем выход нейронной сети; Вычисляем ошибку;

- 25. СОБСАНО ЭТО ПРЕЛЮДИЯ Что мы знаем: Машинное

- 26. ГОЛУБИННОЕ ОБУЧЕНИЕ «В 1997 году Deep Blue

- 27. РАСПОЗНОВАНИЕ

- 28. КОТИКИ БЫВАЮТ РАЗНЫЕ

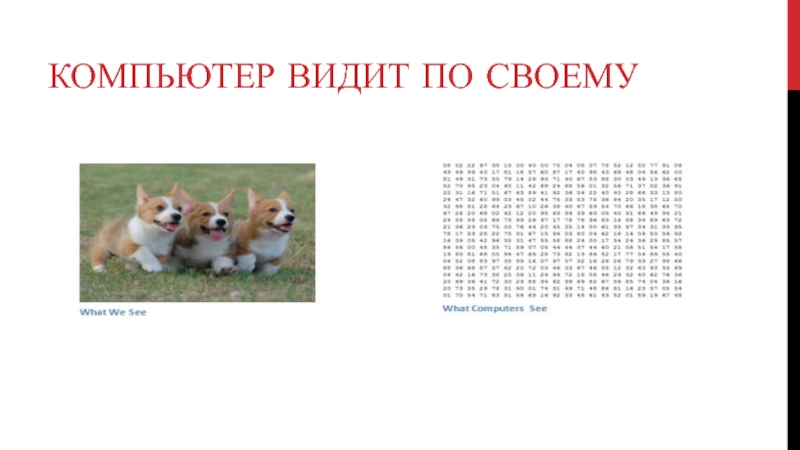

- 29. КОМПЬЮТЕР ВИДИТ ПО СВОЕМУ

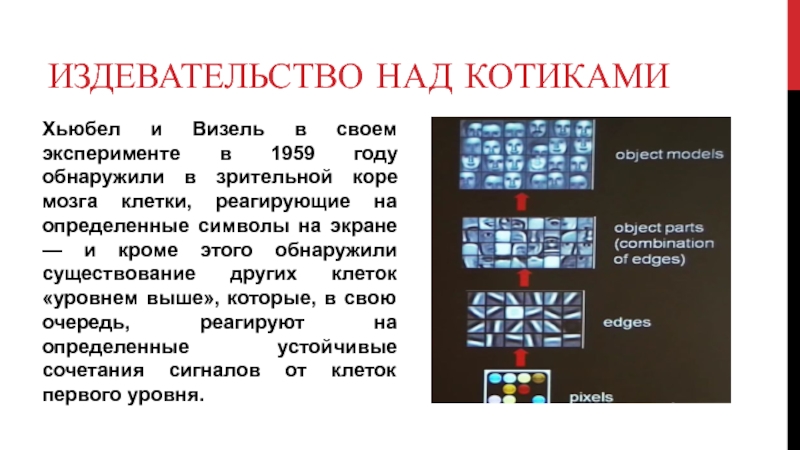

- 30. ИЗДЕВАТЕЛЬСТВО НАД КОТИКАМИ Хьюбел и Визель в

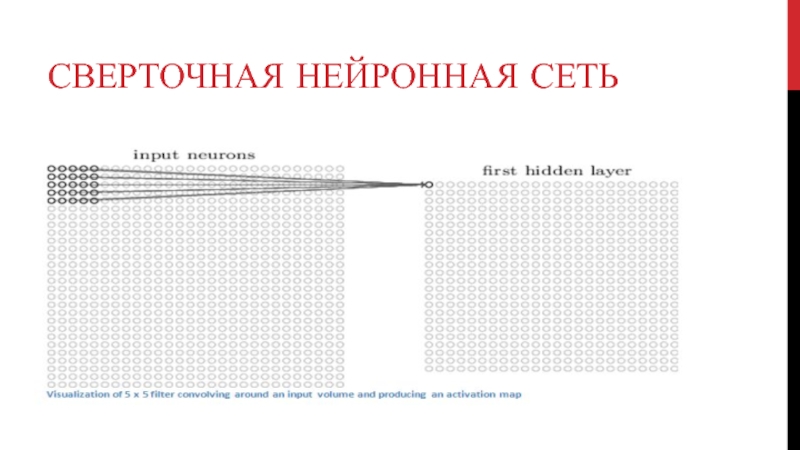

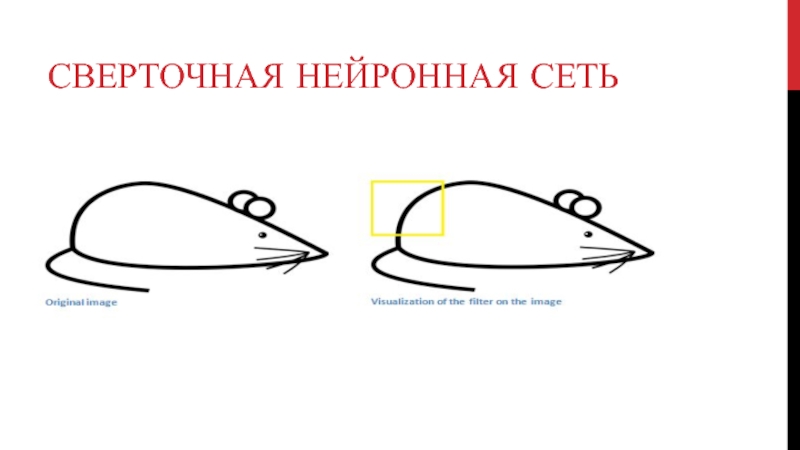

- 31. СВЕРТОЧНАЯ НЕЙРОННАЯ СЕТЬ

- 32. СВЕРТОЧНАЯ НЕЙРОННАЯ СЕТЬ

- 33. СВЕРТОЧНАЯ НЕЙРОННАЯ СЕТЬ

- 34. СВЕРТОЧНАЯ НЕЙРОННАЯ СЕТЬ

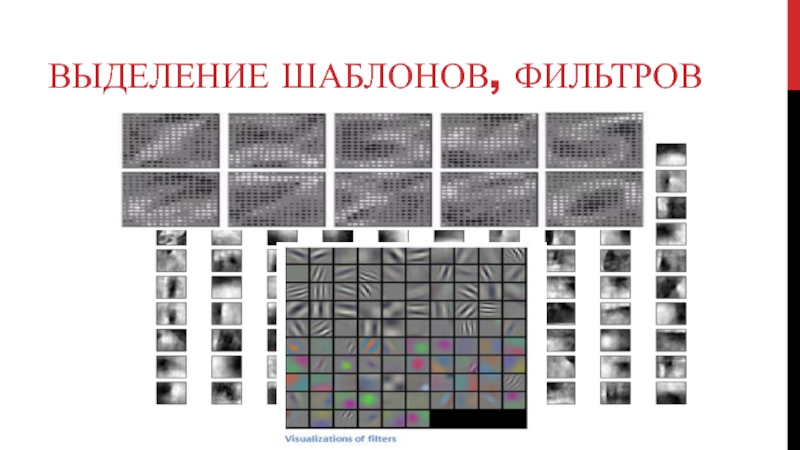

- 35. ВЫДЕЛЕНИЕ ШАБЛОНОВ, ФИЛЬТРОВ

- 36. ИГОГО Машинное обучение – чуть моложе коня

- 37. О ЧЕМ БЫ ЕЩЕ ПОПИЗДЕТЬ? Internet of

- 38. СПАСИБО ЗА ВНИМАНИЕ

Слайд 2ПОЧЕМУ Я

Лауреат премии while true года;

Темный властелин бинарных мамок;

Занесен в книгу

рекордов Гиннеса за самые прямые из кривых рук;

Знатный пиздабол.

Знатный пиздабол.

Слайд 3НАШ МАЛЕНЬКИЙ ROADMAP

Немного истории;

Основы машинного обучения;

Нейросети;

Deep learning;

Вопросы – ответы.

Присаживайтесь поудобнее на

бутылку и… поехали

Слайд 4ВЕХИ

Машина Паскаля 1642г.

Артур Самуэль, создает первую шашечную программу для IBM

701 1952г.

Deuz Ex машина тамплиеров

Не я, но тоже очень умный мужик

Слайд 5ВЕХИ

1936 AT&T Bell Labs создает синтезатор речи;

1958 Фрэнк Розенблатт (Frank Rosenblatt)

придумал Персептрон — первую искусственную нейронную сеть и создал первый нейрокомпьютер «Марк-1»;

1967 Написан метрический алгоритм классификации (Метод k ближайших соседей). Алгоритм позволил компьютерам использовать простые шаблоны распознавания;

1985 Терри Сейновски (Terry Sejnowski) создает NetTalk искусственную нейронную сеть;

1997 Компьютер Deep Blue обыграл чемпиона мира по шахматам Гарри Каспарова;

2006 Джеффри Хинтон (Geoffrey Hinton), ученый в области искусственных нейросетей, ввел в обиход термин «Глубинное обучение» (Deep learning).

1967 Написан метрический алгоритм классификации (Метод k ближайших соседей). Алгоритм позволил компьютерам использовать простые шаблоны распознавания;

1985 Терри Сейновски (Terry Sejnowski) создает NetTalk искусственную нейронную сеть;

1997 Компьютер Deep Blue обыграл чемпиона мира по шахматам Гарри Каспарова;

2006 Джеффри Хинтон (Geoffrey Hinton), ученый в области искусственных нейросетей, ввел в обиход термин «Глубинное обучение» (Deep learning).

Слайд 6ОСНОВНЫЕ ТЕРМИНЫ

Основные понятия и обозначения:

Данные о задачах обучения по прецедентам;

Модели алгоритмов

и методы обучения;

Обучение и переобучение.

Примеры прикладных задач:

Классификация;

Регрессия;

Ранжирование.

Обучение и переобучение.

Примеры прикладных задач:

Классификация;

Регрессия;

Ранжирование.

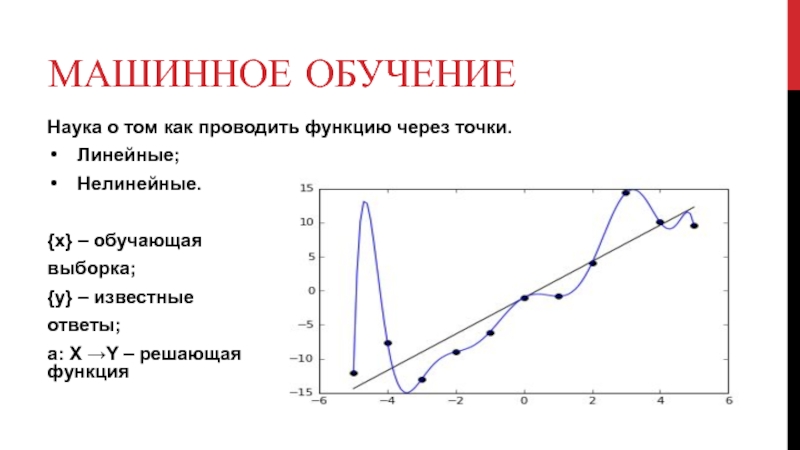

Слайд 7МАШИННОЕ ОБУЧЕНИЕ

Наука о том как проводить функцию через точки.

Линейные;

Нелинейные.

{х} – обучающая

выборка;

{y} – известные

ответы;

a: X →Y – решающая функция

Слайд 8СРАЗУ К ПРИМЕРАМ

Задача: отличить осмысленный текст от белиберды

Текст, который пишут настоящие

люди, выглядит так:

Могу творить, могу и натворить!

У меня два недостатка: плохая память и что-то еще.

Никто не знает столько, сколько не знаю я.

Белиберда выглядит так:

ОРПорыав аоырОрпаыор ОрОРАыдцуцзущгкгеуб ыватьыивдцулвдлоадузцщ

Йцхяь длваополц ыадолцлопиолым бамдлотдламда

Могу творить, могу и натворить!

У меня два недостатка: плохая память и что-то еще.

Никто не знает столько, сколько не знаю я.

Белиберда выглядит так:

ОРПорыав аоырОрпаыор ОрОРАыдцуцзущгкгеуб ыватьыивдцулвдлоадузцщ

Йцхяь длваополц ыадолцлопиолым бамдлотдламда

Слайд 11ОБУЧЕНИЕ И МОДЕЛЬ

Обучающая выборка:

Правильные и неправильные результаты;

Подбор частотность выборки;

Задача обучения сводится

к оптимизации и может быть решена численными методами оптимизации.

Проблема постановки.

Проблема переобучения.

Проблема постановки.

Проблема переобучения.

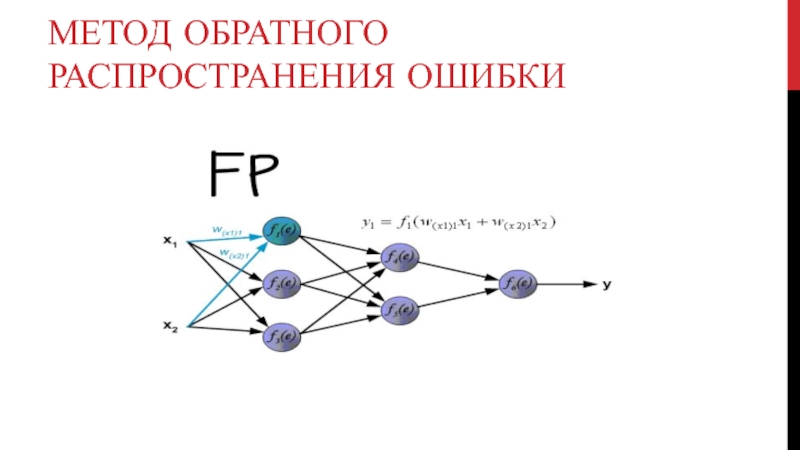

Слайд 15КАК РАБОТАЮТ НЕЙРОННЫЕ СЕТИ

Нейронные сети обучаются.

Самые популярные:

Метод обратного распространения (Backpropagation)

Метод

упругого распространения (Resilient propagation или Rprop)

Генетический Алгоритм (Genetic Algorithm)

Генетический Алгоритм (Genetic Algorithm)

Слайд 16НЕЙРОННЫЕ СЕТИ

С математической точки зрения, обучение нейронных сетей — это многопараметрическая

задача нелинейной оптимизации.

синапс

Слайд 17КАК РАБОТАЕТ НЕЙРОННАЯ СЕТЬ

Вход

Ф-ция активации

Ошибка — это процентная величина, отражающая расхождение

между ожидаемым и полученным ответами.

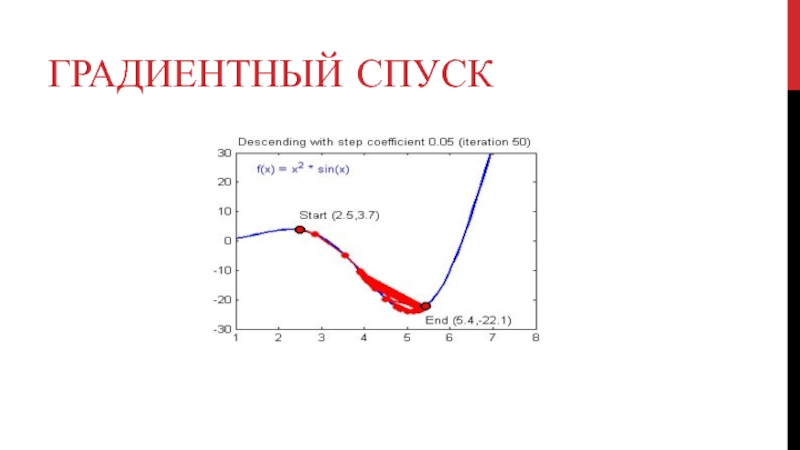

Слайд 20ГРАДИЕНТНЫЙ СПУСК

Способ нахождения локального минимума или максимума функции с помощью движения

вдоль градиента.

Градиент — это вектор который определяет крутизну склона и указывает его направление относительно какой либо из точек на поверхности или графике.

Градиент — это вектор который определяет крутизну склона и указывает его направление относительно какой либо из точек на поверхности или графике.

Слайд 24ИТОГО

Считаем выход нейронной сети;

Вычисляем ошибку;

Считаем обратный ход – улучшаем результат, минимизируем

ошибку;

Что это дает:

Мы можем использовать нейронные сети там, где заранее не знаем решения;

Обучение позволяет сети самой подстраиваться под изменяющиеся входные данные.

Что это дает:

Мы можем использовать нейронные сети там, где заранее не знаем решения;

Обучение позволяет сети самой подстраиваться под изменяющиеся входные данные.

Слайд 25СОБСАНО ЭТО ПРЕЛЮДИЯ

Что мы знаем:

Машинное обучение – наука о том как

проводить функцию через точки;

Нейронные сети – самообучающийся подбор коэффициентов функции.

Нейронные сети – самообучающийся подбор коэффициентов функции.

Слайд 26ГОЛУБИННОЕ ОБУЧЕНИЕ

«В 1997 году Deep Blue обыграл в шахматы Каспарова.

В 2011

Watson обставил чемпионов Jeopardy.

Сможет ли ваш алгоритм в 2017 году отличить Бобика от Пушистика?»

Сможет ли ваш алгоритм в 2017 году отличить Бобика от Пушистика?»

Слайд 30ИЗДЕВАТЕЛЬСТВО НАД КОТИКАМИ

Хьюбел и Визель в своем эксперименте в 1959 году

обнаружили в зрительной коре мозга клетки, реагирующие на определенные символы на экране — и кроме этого обнаружили существование других клеток «уровнем выше», которые, в свою очередь, реагируют на определенные устойчивые сочетания сигналов от клеток первого уровня.

Слайд 36ИГОГО

Машинное обучение – чуть моложе коня Буденного;

Машинное обучение – не применяется

сейчас только твоей мамкой;

Нейронные сети – классная штука, если ты не знаешь как решать задачу;

Глубинное обучение – очень свежий и интуитивный аппарат;

Границ анализа данных нет(почти)!

Нейронные сети – классная штука, если ты не знаешь как решать задачу;

Глубинное обучение – очень свежий и интуитивный аппарат;

Границ анализа данных нет(почти)!