теории передачи и кодирования.

- Главная

- Разное

- Дизайн

- Бизнес и предпринимательство

- Аналитика

- Образование

- Развлечения

- Красота и здоровье

- Финансы

- Государство

- Путешествия

- Спорт

- Недвижимость

- Армия

- Графика

- Культурология

- Еда и кулинария

- Лингвистика

- Английский язык

- Астрономия

- Алгебра

- Биология

- География

- Детские презентации

- Информатика

- История

- Литература

- Маркетинг

- Математика

- Медицина

- Менеджмент

- Музыка

- МХК

- Немецкий язык

- ОБЖ

- Обществознание

- Окружающий мир

- Педагогика

- Русский язык

- Технология

- Физика

- Философия

- Химия

- Шаблоны, картинки для презентаций

- Экология

- Экономика

- Юриспруденция

Общая теория связи презентация

Содержание

- 1. Общая теория связи

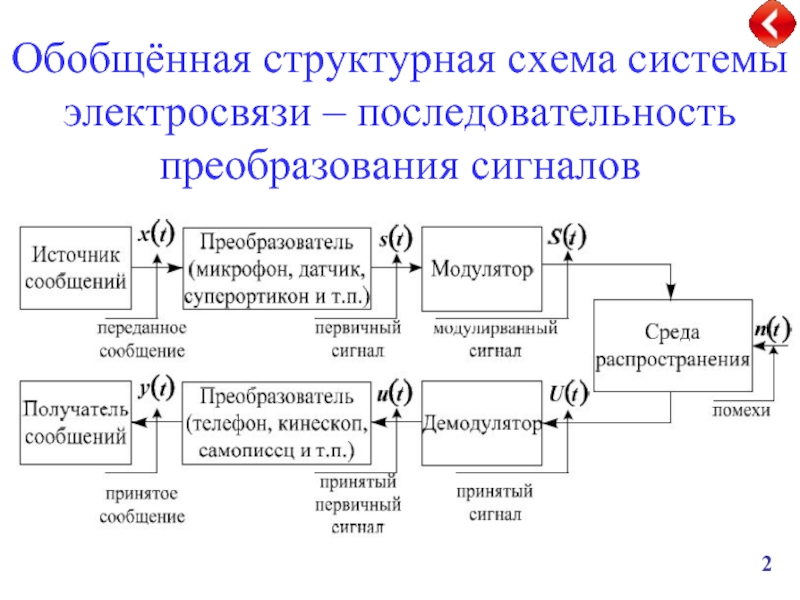

- 2. Обобщённая структурная схема системы электросвязи – последовательность преобразования сигналов

- 3. Виды модуляции сигналов амплитудная модуляция: A(t) =

- 4. Обобщённая схема модулятора

- 5. Принцип амплитудной модуляции mАМ = ΔA /

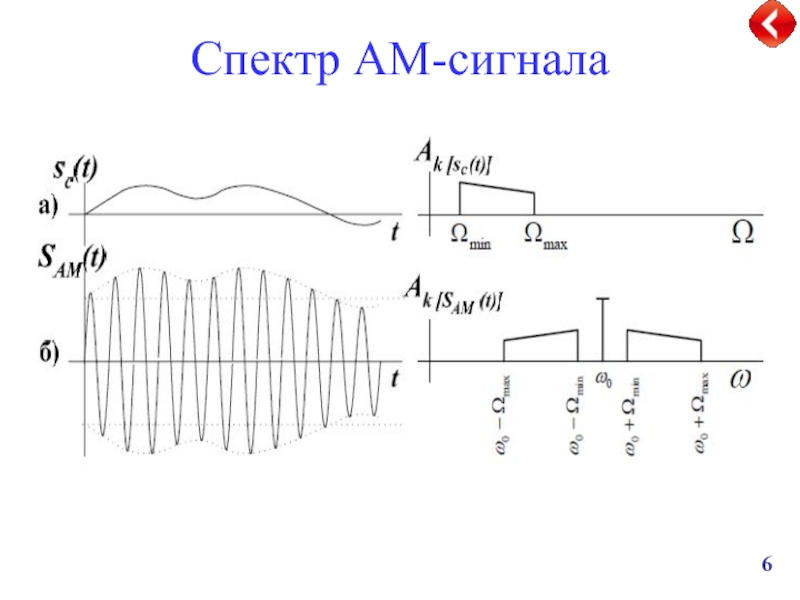

- 6. Спектр АМ-сигнала

- 7. Балансная модуляция

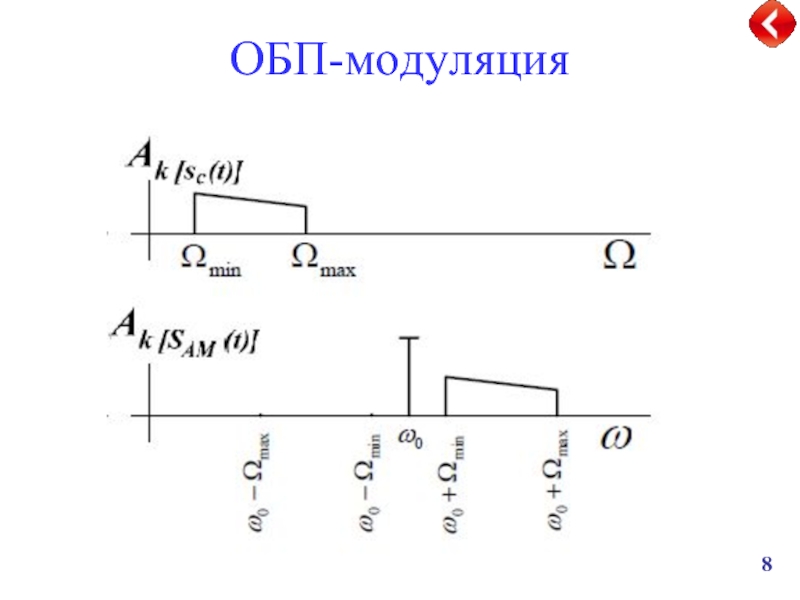

- 8. ОБП-модуляция

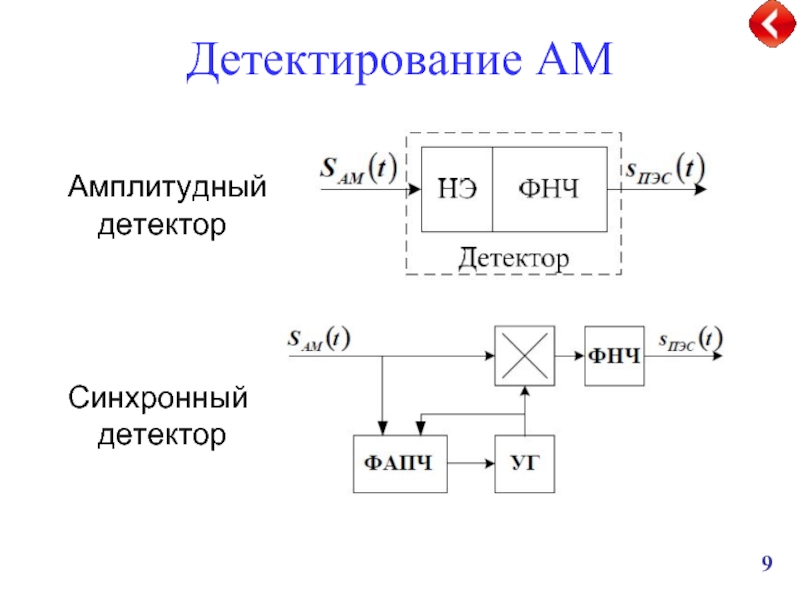

- 9. Детектирование АМ Амплитудный детектор Синхронный детектор

- 10. Фазовая модуляция

- 11. Частотная модуляция

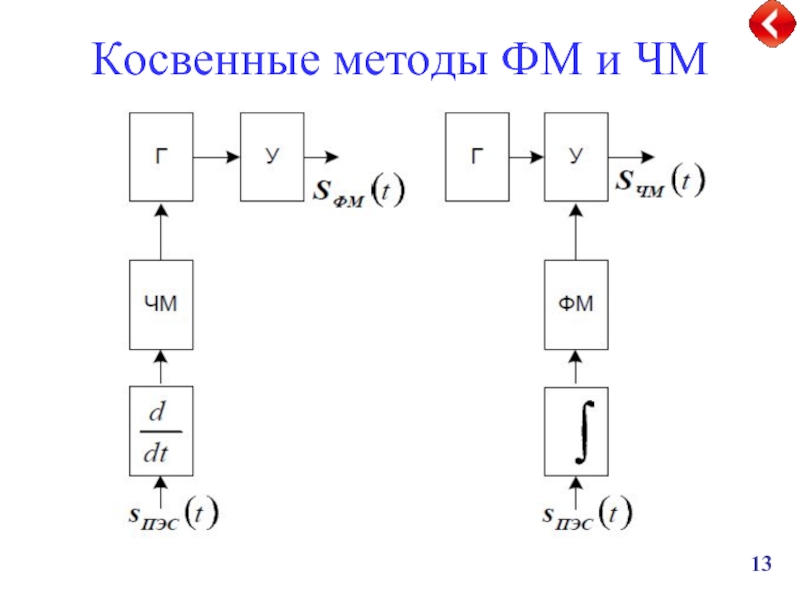

- 12. Прямые методы ЧМ и ФМ

- 13. Косвенные методы ФМ и ЧМ

- 14. Детектирование ФМ Разновидность синхронного детектора

- 15. Примеры Спектры модулированных сигналов.

- 16. Основы теории информации Методы количественного определения (К.

- 17. Энтропия Энтропия неотрицательна: H(A) = 0; p(ai)

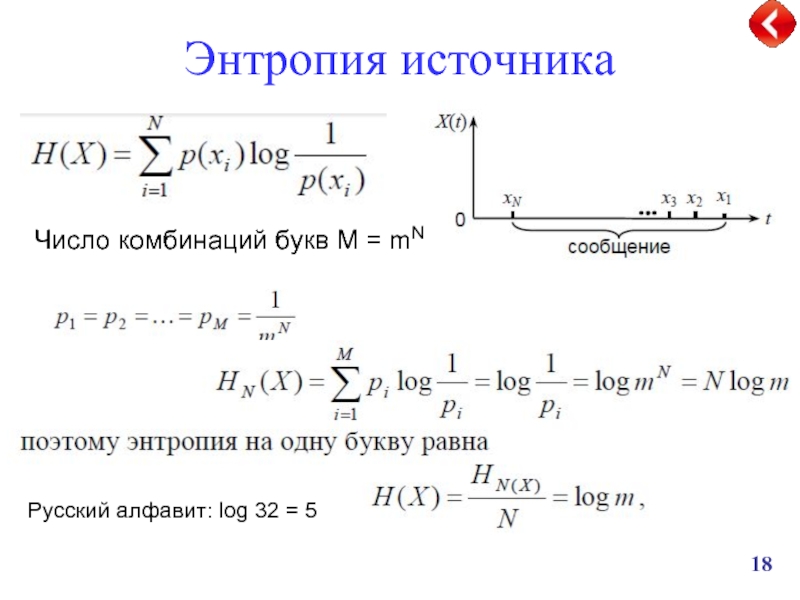

- 18. Энтропия источника Число комбинаций букв M = mN Русский алфавит: log 32 = 5

- 19. Вероятности русских букв

- 20. Избыточность источника Характеристика, показывающая количественное превышение числа

- 21. Производительность источника количество информации, выдаваемое источником в

- 22. Пропускная способность канала Пропускной способностью (C’, бит/символ)

- 23. Пропускная способность дискретного канала

- 24. Прямая и обратная теоремы кодирования Прямая теорема

- 25. Задание: Проработать раздел Основы теории кодирования дискретных

Слайд 1Общая теория связи

Занятие 2.

Преобразование сообщений в СПИ.

Виды модуляции.

Цифровое представление сообщений.

Основы

Слайд 2Обобщённая структурная схема системы электросвязи – последовательность преобразования сигналов

Слайд 3Виды модуляции сигналов

амплитудная модуляция:

A(t) = A0 + ΔA(t) = A0 +

asc(t)

частотная модуляция: ω(t) = ω0+Δω(t) = ω0 + asc(t)

фазовая модуляция: ϕ(t) = ϕ0 + Δϕ(t) = ϕ0 + asc(t)

частотная модуляция: ω(t) = ω0+Δω(t) = ω0 + asc(t)

фазовая модуляция: ϕ(t) = ϕ0 + Δϕ(t) = ϕ0 + asc(t)

Слайд 16Основы теории информации

Методы количественного определения

(К. Шеннон, 1948)

количество информации должно быть аддитивной

мерой;

количество информации о достоверном событии равно нулю;

количество информации не должно зависеть от содержания.

количество информации о достоверном событии равно нулю;

количество информации не должно зависеть от содержания.

Слайд 17Энтропия

Энтропия неотрицательна: H(A) = 0; p(ai) = 1;p(aj) = 0.

Энтропия аддитивна,

т. е. Если , то H<А, А, …, А> = nH(A).

Если в ансамбле K = mn различных сообщений, то H(A) ≤ log K.

Если в ансамбле K = mn различных сообщений, то H(A) ≤ log K.

Слайд 20Избыточность источника

Характеристика, показывающая количественное превышение числа символов в сообщении над минимально

необходимым для передачи содержания

Коэффициент избыточности

Слайд 21Производительность источника

количество информации, выдаваемое источником в среднем за единицу времени (одну

секунду) его непрерывной работы

Слайд 22Пропускная способность канала

Пропускной способностью (C’, бит/символ) канала, рассчитанной на один входной

символ, называется максимальное количество информации, которое может быть передано по каналу.

Используют также пропускную способность в единицу времени C = 1 / T * C’ , бит/с, или просто пропускную способность

Используют также пропускную способность в единицу времени C = 1 / T * C’ , бит/с, или просто пропускную способность

Слайд 24Прямая и обратная теоремы кодирования

Прямая теорема кодирования:

для любого однозначно декодируемого кода

среднее число символов в двоичном кодовом слове всегда не меньше энтропии источника сообщений

nСР ≥ H(X),

и существует однозначно декодируемый код, для которого выполняется неравенство nСР < H(X)+1.

Обратная теорема кодирования:

невозможно построить однозначно декодируемый код, для которого выполнялось бы неравенство nСР

Обратная теорема кодирования:

невозможно построить однозначно декодируемый код, для которого выполнялось бы неравенство nСР

Слайд 25Задание:

Проработать раздел Основы теории кодирования дискретных сообщений

Проработать разделы Основы оптимального

приёма дискретных и непрерывных сообщений

Самостоятельно!

Самостоятельно!

![Принцип амплитудной модуляцииmАМ = ΔA / A0SАМ(sc,t) = A0 [ 1+ mАМ sc(t) ] cos(ω0t +ϕ0).](/img/tmb/1/40604/cf515c2272efbf27e87f3fe7a959f2bf-800x.jpg)