М.Г.Кузьмина

Институт прикладной математики им. М.В.Келдыша РАН

- Главная

- Разное

- Дизайн

- Бизнес и предпринимательство

- Аналитика

- Образование

- Развлечения

- Красота и здоровье

- Финансы

- Государство

- Путешествия

- Спорт

- Недвижимость

- Армия

- Графика

- Культурология

- Еда и кулинария

- Лингвистика

- Английский язык

- Астрономия

- Алгебра

- Биология

- География

- Детские презентации

- Информатика

- История

- Литература

- Маркетинг

- Математика

- Медицина

- Менеджмент

- Музыка

- МХК

- Немецкий язык

- ОБЖ

- Обществознание

- Окружающий мир

- Педагогика

- Русский язык

- Технология

- Физика

- Философия

- Химия

- Шаблоны, картинки для презентаций

- Экология

- Экономика

- Юриспруденция

Вычислительные возможности нейронных сетей презентация

Содержание

- 1. Вычислительные возможности нейронных сетей

- 2. План 1. Предмет

- 5. Биологический прототип: нейронные структуры мозга

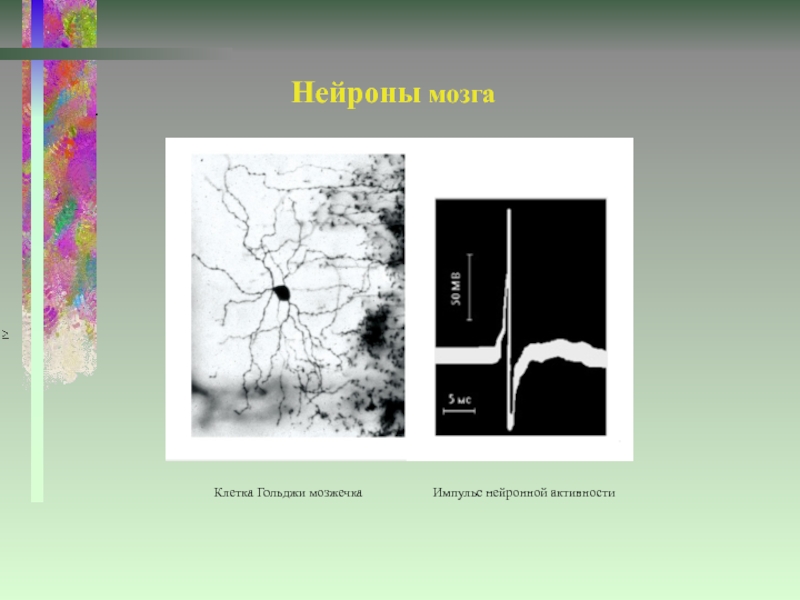

- 6. Нейроны мозга .

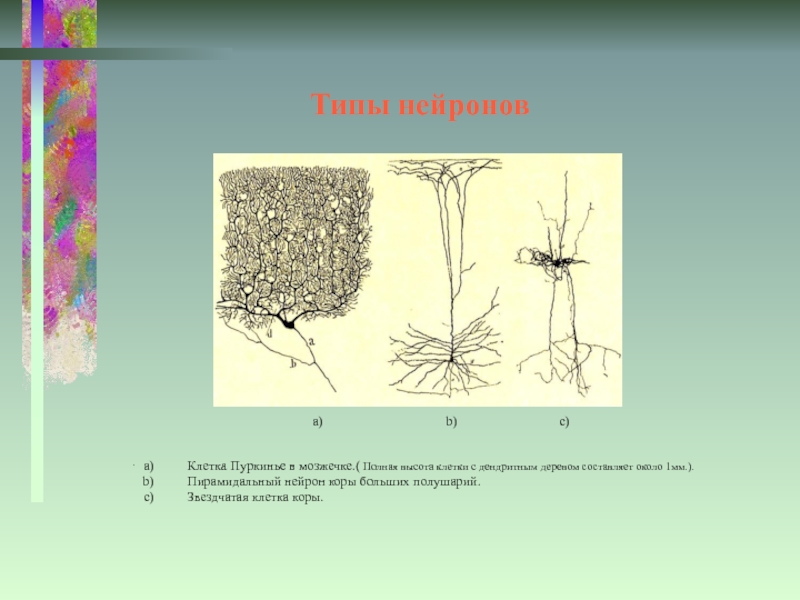

- 7. Типы нейронов a) b)

- 8. Нейроны зрительной

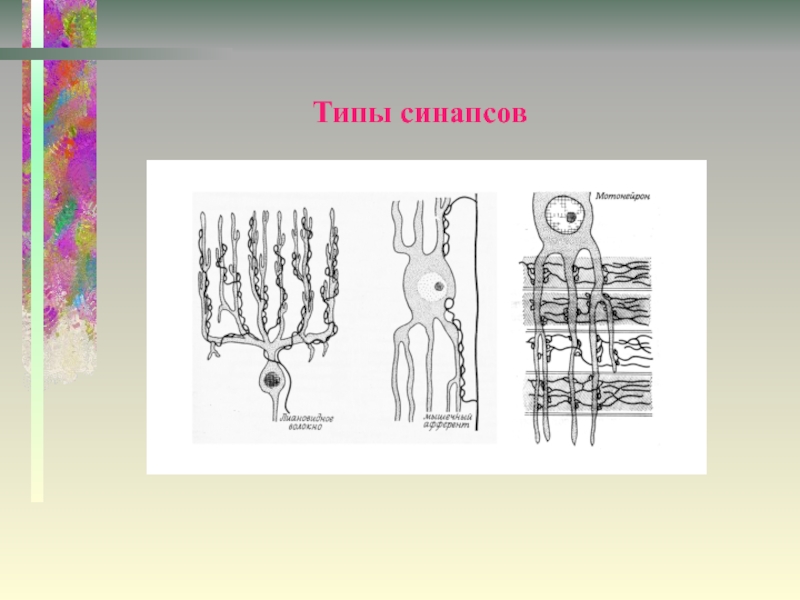

- 9. Типы синапсов

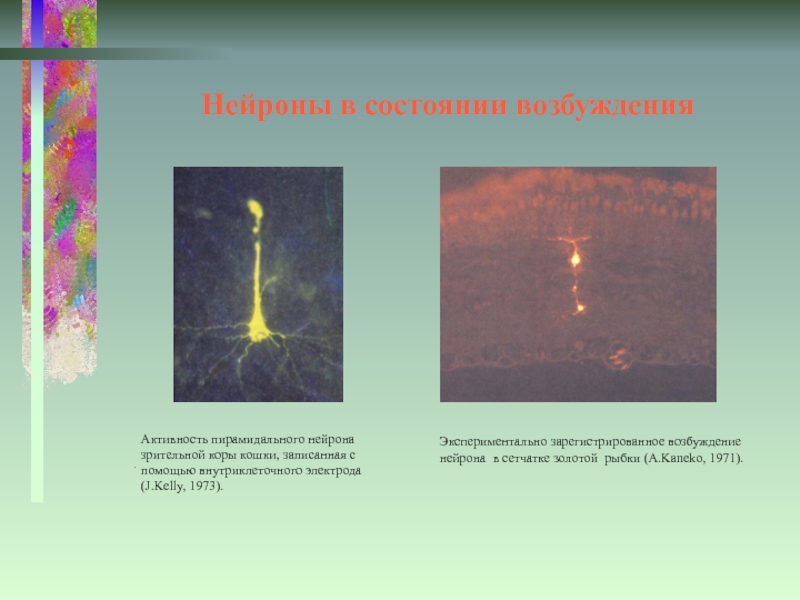

- 10. Нейроны в состоянии возбуждения

- 11. Формальный нейрон МакКаллока и Питтса

- 12. Простейшие архитектуры: однослойный персептрон Открытая

- 13. Каскад (многослойный персептрон). Рекуррентные сети.

- 14. Cети гетеро-ассоциативной памяти.

- 15. Рекуррентные сети авто-ассоциативной памяти

- 16. Подавление шума сетями гетеро-ассоциативной памяти

- 17. Реализация произвольной функции трехслойной сетью

- 19. Сеть Хопфилда: воспроизведение эталонов

- 20. Аналогия между сетями из формальных нейронов

- 22. Алгоритм “delta-rule” для однослойного персептрона

- 23. Алгоритм

- 24. Алгоритмы обучения для рекуррентных сетей

- 25. Типичные трудности градиентных методов обучения

- 27. Динамические нейронные сети

- 28. Некоторые направления современных исследований • Математическиее

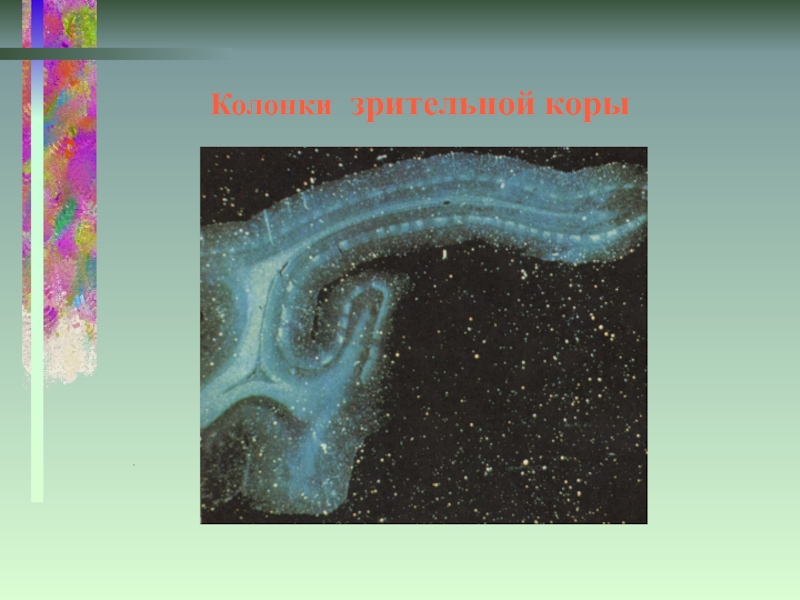

- 30. Колонки зрительной коры .

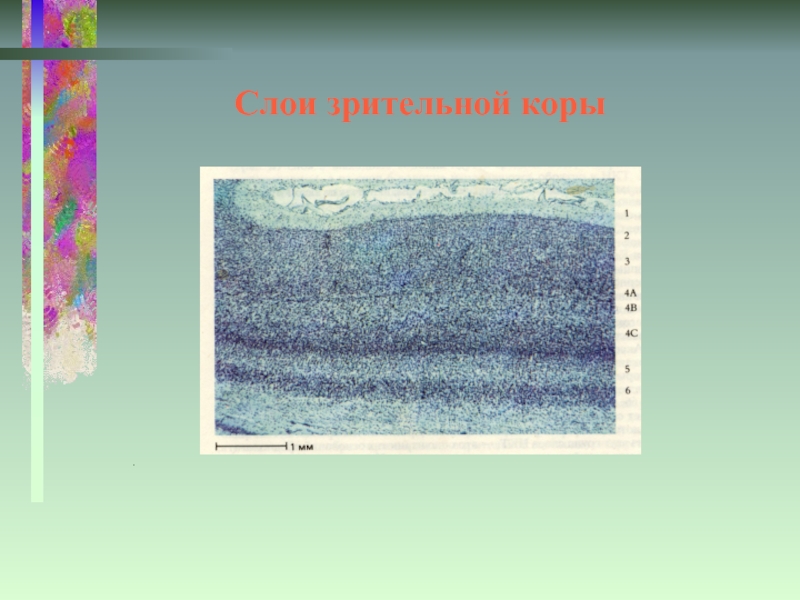

- 31. Слои зрительной коры .

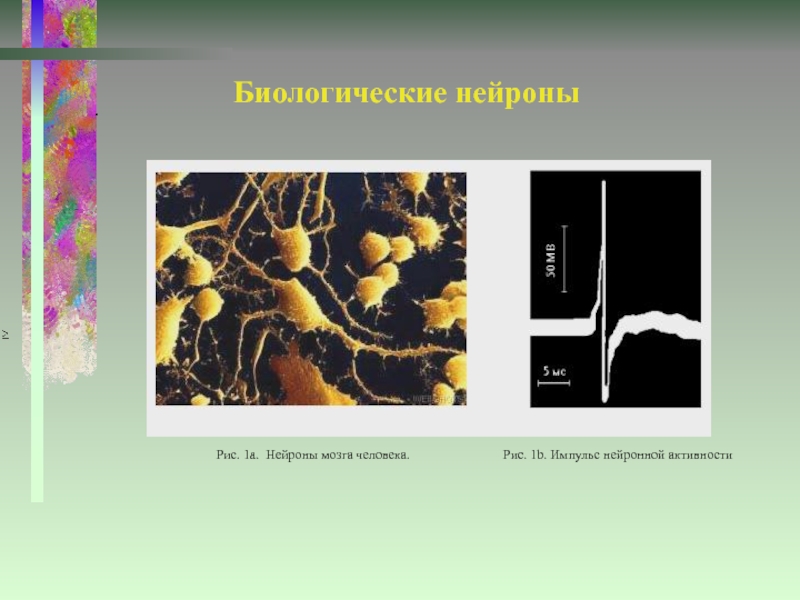

- 32. Биологические нейроны .

- 33. Многослойная структура коры

Слайд 1 Вычислительные возможности нейронных

Слайд 2План

1. Предмет теория нейронных сетей. Искусственные нейронные сети.

2. Биологический прототип: нейронные структуры мозга.

3. Сети из формальных нейронов. Типы сетевых архитектур.

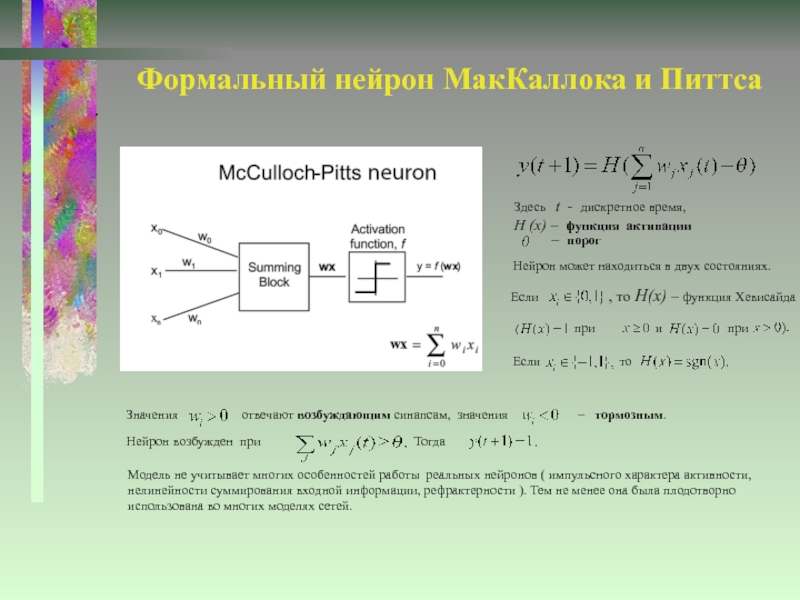

• Формальный нейрон МакКаллока и Питтса

• Однослойный персептрон

• Многослойный персептрон

• Рекуррентные сети

• Реализация произвольной функции трехслойной сетью

4. Сети ассоциативной памяти.

• Сети гетеро- и авто-ассоциативной памяти

• Подавление шумов сетями гетеро-ассоциативной памяти

5. Сеть Хопфилда. Связь со спиновыми системами.

6. Обучение нейронных сетей.

• Алгоритмы “delta-rule” и “back-propagation”

• Алгоритмы обучения для рекуррентных сетей

• Типичные трудности градиентных методов обучения

7. Динамические нейронные сети и нейроморфное моделирование.

8. Нейрокомпьютеры

9. Некоторые направления современных исследований

Слайд 3 Теория нейронных сетей:

Хорошо известно, что человеческий мозг по своим возможностям далеко превосходит обычные компьютеры при решении многих задач. Кроме того, мозг обладает еще целым рядом особенностей, которые ставят его вне конкуренции по сравнению с современными компьютерами, а также с лучшими приборами, созданными человеком. Это следующие особенности, которые были выработаны биологическими нейронными сетями в процессе биологической эволюции в течении 600 млн. лет:

• надежность и устойчивость к повреждениям;

• способность к адаптации и обучению;

• способность иметь дело с неполной, избыточной, зашумленной информацией;

• высокая степень параллельности при функционировании;

• очень низкие энергетические затраты.

При этом все процессы обработки информации выполняются биологическими системами автоматически, без какого-либо напряжения сознания или специального управления.

Мозг – высоко распараллеленная система, в которой информация передается в виде пространственно-временных

структур нервного возбуждения. Это значительно более гибкий и эффективный способ обработки информации, чем тот, который используется в современных традиционных компьютерах (несмотря на то, что скорость работы нейронов в раз меньше, чем скорость работы транзисторов).

Способность к обучению – адаптации к условиям и возможностям в изменяющейся внешней среде – столь важная особенность нейронных сетей, что теперь присоединена в качестве отдельного пункта к так называемому «тесту Тьюринга», являющемуся операционным определением понятия интеллект.

Основные цели исследований в области теории нейронных сетей – выяснение принципов работы мозга, а также изучение общих возможностей систем, осуществляющих параллельную распределенную обработку информации. Основное средство – построение и изучение моделей искусственных нейронных сетей.

Одна из основных целей – создание нейрокомпьютеров.

Слайд 4 Искусственные

Искусственная нейронная сеть – массивный параллельный распределенный

процессор, в котором заложены возможности для хранения и воспроизведения

информации, и который имеет сходство с мозгом в двух отношениях:

1) информация приобретается посредством процесса обучения;

2) хранение информации является распределенным и осуществляется в форме

распределения связей между элементами сети.

(S.Haykin, 1994)

Сеть состоит из большого числа простых активных элементов, каждый из которых оперирует

только локальной информацией. Вся сеть осуществляет параллельную обработку

информации.

Термин «нейронная» отражает тот факт, что объект возник под влиянием представления

о биологических нейронных сетях.

Слайд 5Биологический прототип: нейронные структуры мозга

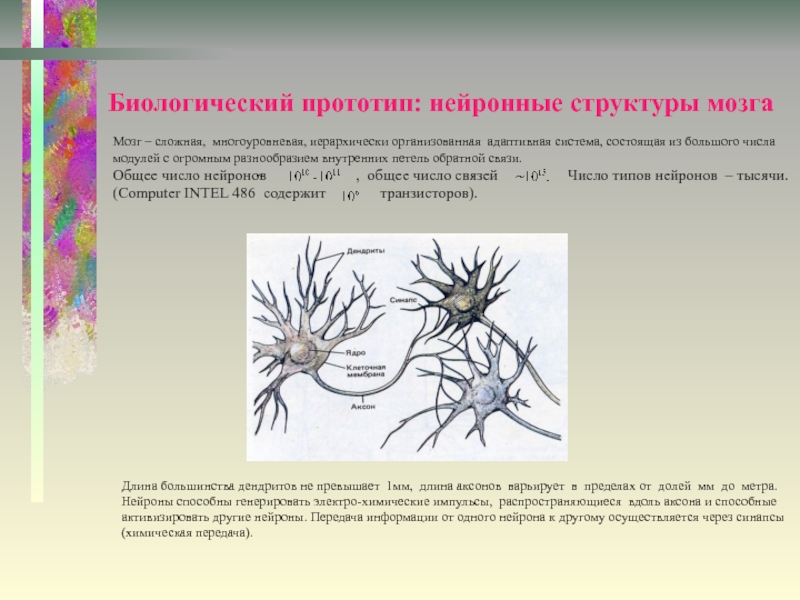

Мозг – сложная, многоуровневая,

модулей с огромным разнообразием внутренних петель обратной связи.

Общее число нейронов , общее число связей Число типов нейронов – тысячи.

(Сomputer INTEL 486 содержит транзисторов).

Длина большинства дендритов не превышает 1мм, длина аксонов варьирует в пределах от долей мм до метра.

Нейроны способны генерировать электро-химические импульсы, распространяющиеся вдоль аксона и способные

активизировать другие нейроны. Передача информации от одного нейрона к другому осуществляется через синапсы

(химическая передача).

Слайд 7Типы нейронов

a)

b)

c)

.

Клетка Пуркинье в мозжечке.( Полная высота клетки с дендритным

Пирамидальный нейрон коры больших полушарий.

Звездчатая клетка коры.

Слайд 8 Нейроны зрительной коры мозга

при которой видна лишь очень малая доля всех нервных клеток). Размер рисунка по вертикали на

левой половине рисунка соответствует 1мм. На правой части рисунка на микрофотографию

наложено изображение типичного вольфрамового электрода, применяемого при внеклеточной

регистрации нейронной активности.

Слайд 10 Нейроны в состоянии возбуждения

.

Активность пирамидального нейрона

зрительной коры кошки,

помощью внутриклеточного электрода

(J.Kelly, 1973).

Экспериментально зарегистрированное возбуждение

нейрона в сетчатке золотой рыбки (A.Kaneko, 1971).

Слайд 11Формальный нейрон МакКаллока и Питтса

.

Модель не учитывает многих

Здесь t - дискретное время,

H (x) – функция активации

– порог

Если , то H(x) – функция Хевисайда

при и

при

Если

то

Значения отвечают возбуждающим синапсам, значения – тормозным.

Нейрон возбужден при Тогда

Нейрон может находиться в двух состояниях.

Слайд 12Простейшие архитектуры: однослойный персептрон

Открытая однослойная сеть из m не

или

матрица.

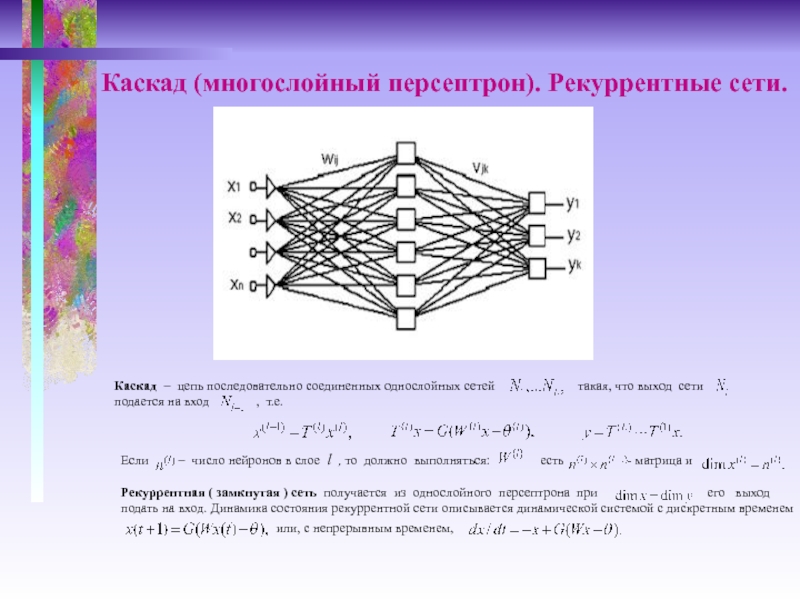

Слайд 13Каскад (многослойный персептрон). Рекуррентные сети.

Каскад – цепь последовательно соединенных однослойных сетей

Если – число нейронов в слое l , то должно выполняться: есть - матрица и

Рекуррентная ( замкнутая ) сеть получается из однослойного персептрона при его выход

подать на вход. Динамика состояния рекуррентной сети описывается динамической системой с дискретным временем

или, с непрерывным временем,

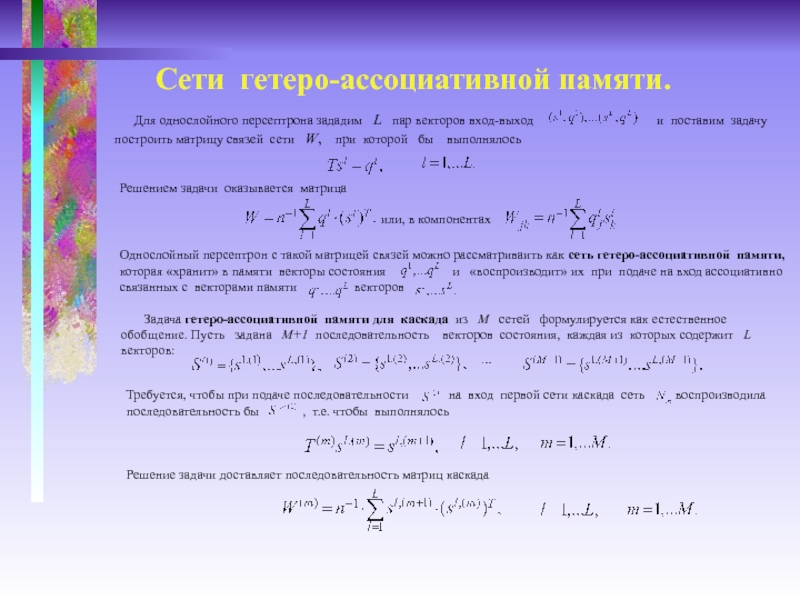

Слайд 14 Cети гетеро-ассоциативной памяти.

Решением задачи оказывается матрица

или, в компонентах

Однослойный персептрон с такой матрицей связей можно рассматриваить как сеть гетеро-ассоциативной памяти,

которая «хранит» в памяти векторы состояния и «воспроизводит» их при подаче на вход ассоциативно

связанных с векторами памяти векторов

Задача гетеро-ассоциативной памяти для каскада из M сетей формулируется как естественное обобщение. Пусть задана M+1 последовательность векторов состояния, каждая из которых содержит L векторов:

Требуется, чтобы при подаче последовательности на вход первой сети каскада сеть воспроизводила

последовательность бы , т.е. чтобы выполнялось

Решение задачи доставляет последовательность матриц каскада

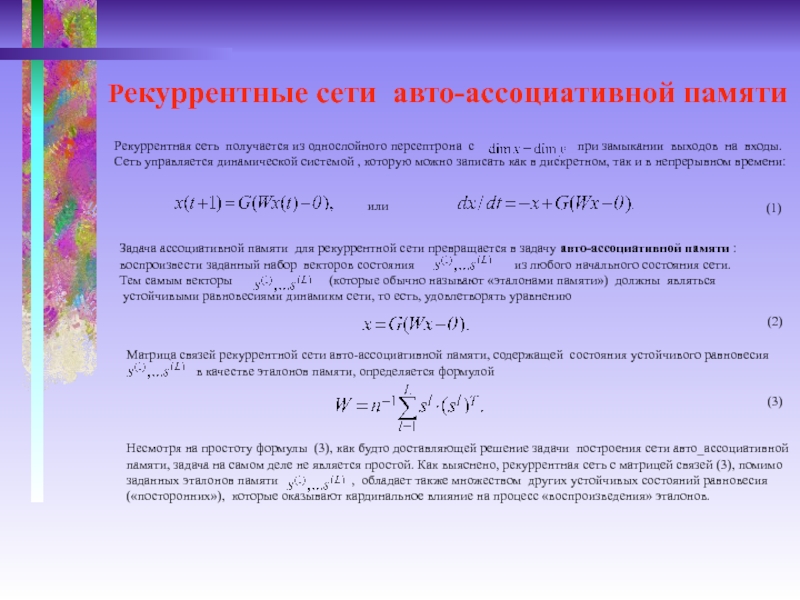

Слайд 15 Рекуррентные сети авто-ассоциативной памяти

Рекуррентная сеть получается из однослойного

Сеть управляется динамической системой , которую можно записать как в дискретном, так и в непрерывном времени:

или

Задача ассоциативной памяти для рекуррентной сети превращается в задачу авто-ассоциативной памяти :

воспроизвести заданный набор векторов состояния из любого начального состояния сети.

Тем самым векторы (которые обычно называют «эталонами памяти») должны являться

устойчивыми равновесиями динамикм сети, то есть, удовлетворять уравнению

Матрица связей рекуррентной сети авто-ассоциативной памяти, содержащей состояния устойчивого равновесия

в качестве эталонов памяти, определяется формулой

(1)

(2)

(3)

Несмотря на простоту формулы (3), как будто доставляющей решение задачи построения сети авто_ассоциативной

памяти, задача на самом деле не является простой. Как выяснено, рекуррентная сеть с матрицей связей (3), помимо

заданных эталонов памяти , обладает также множеством других устойчивых состояний равновесия

(«посторонних»), которые оказывают кардинальное влияние на процесс «воспроизведения» эталонов.

Слайд 16Подавление шума сетями гетеро-ассоциативной памяти

Рассмотрим

векторов состояния с компонентами {0,1} к векторам, компонентами которых являются независимо распределенные случайные величины, принимающие значения –1 и +1 с вероятностью 0.5. Уравнению динамики имеет вид

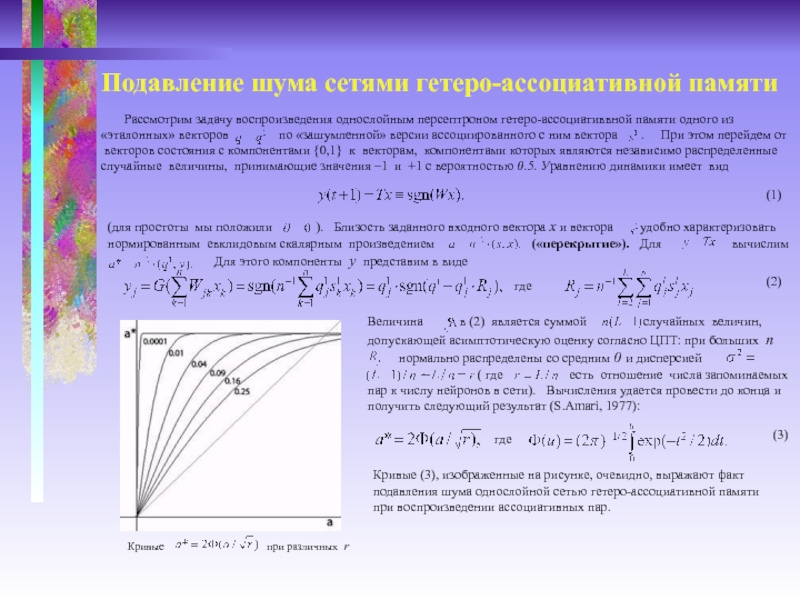

(для простоты мы положили ). Близость заданного входного вектора x и вектора удобно характеризовать нормированным евклидовым скалярным произведением («перекрытие»). Для вычислим

Для этого компоненты y представим в виде

где

(1)

(2)

Величина в (2) является суммой случайных величин,

допускающей асимптотическую оценку согласно ЦПТ: при больших n

нормально распределены со средним 0 и дисперсией

( где есть отношение числа запоминаемых

пар к числу нейронов в сети). Вычисления удается провести до конца и

получить следующий результат (S.Amari, 1977):

где

(3)

Кривые при различных r

Кривые (3), изображенные на рисунке, очевидно, выражают факт

подавления шума однослойной сетью гетеро-ассоциативной памяти

при воспроизведении ассоциативных пар.

Слайд 17 Реализация произвольной функции трехслойной сетью

Любая непрерывная функция многих переменных, заданная на компакте (замкнутом ограниченном множестве) может быть представлена в виде суперпозиции конечного числа функций одной переменной (теорема Колмогорова)

[*] А.Н.Колмогоров, ДАН СССР, 114, 953-956, (1957).

В случае, интересном с точки зрения нейронных сетей, когда функция определена на n-мерном вещественном

кубе , уточнение теоремы Колмогорова получено Д. Шпрехером (D.Sprecher) в 1965г.

Из результата Шпрехера следует теорема о нейросетевой реализации произвольной непрерывной функции многих переменных, определенной на на единичном n-мерном кубе :

Теорема. Произвольная непрерывная функция m вещественных переменных, определенная на единичном

n –мерном кубе: может быть реализована открытой трехслойной нейронной сетью (трехслойным персептроном), имеющей n – мерный вход x, 2n+1 активных элементов в среднем

( скрытом ) слое и m активных элементов в выходном слое (с m выходами).

n – мерный вход

1-ый слой:

2-ой слой:

3-ий слой

Как любая теорема существования, теорема Колмогорова не дает никаких рецептов построения функций

и Тем не менее, теорема Колмогорова гарантирует точное представление функции многих переменных трехслойной сетью.

Можно показать, что двуслойный персептрон является системой, которая способна реализовать любую булеву функцию.

С помощью же трехслойного персептрона можно вычислить любую непрерывную на основе теоремы Колмогорова:

Слайд 18 Сеть

Это рекуррентная сеть ассоциативной памяти с динамикой, управляемой системой

Вместо переменных {0, 1} используются переменные {-1, 1}, и полагается , так что динамическая система в компонентах имеет вид:

где

Емкость памяти r = L/n при больших n удается асимптотически оценить с помощью ЦПТ:

(1)

(2)

(3)

Ключавым моментом оказалась идея введения энергии сети (J.Hopfield, 1982):

(4)

Энергия является функцией Ляпунова для динамической системы (1): H убывает в силу динамики сети.

Кроме того, она соответствует Гамильтониану в статистической механике физических систем, целевой функции

в теории оптимизации и функции приспособленности в эволюционной биологии.

Векторы памяти, являющиеся устойчивыми аттракторами динамики, распологаются в локальных минимумах

«энергетической» поверхности.

- эталоны памяти, n – число нейронов сети, L – число эталонов.

Слайд 19 Сеть Хопфилда: воспроизведение эталонов памяти

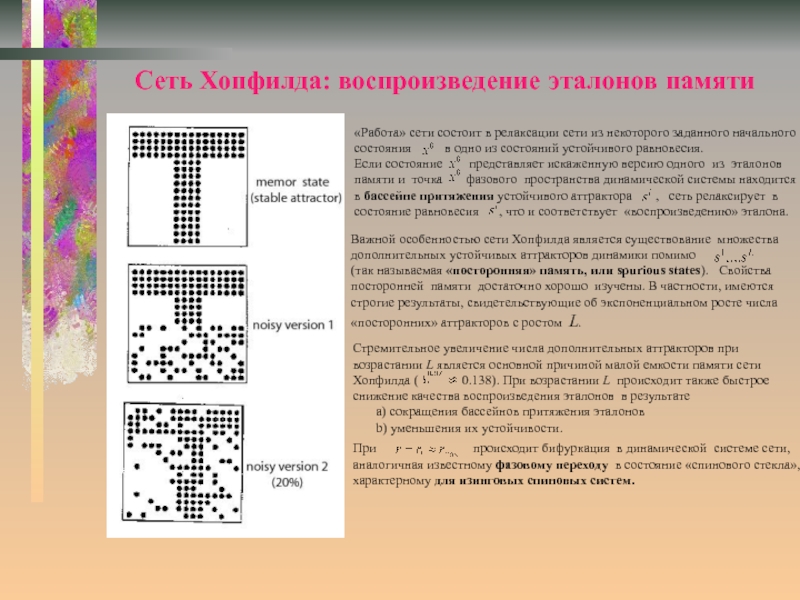

«Работа» сети состоит в релаксации сети из некоторого заданного начального состояния в одно из состояний устойчивого равновесия.

Если состояние представляет искаженную версию одного из эталонов памяти и точка фазового пространства динамической системы находится

в бассейне притяжения устойчивого аттрактора , сеть релаксирует в

состояние равновесия , что и соответствует «воспроизведению» эталона.

Важной особенностью сети Хопфилда является существование множества

дополнительных устойчивых аттракторов динамики помимо

(так называемая «посторонняя» память, или spurious states). Свойства

посторонней памяти достаточно хорошо изучены. В частности, имеются

строгие результаты, свидетельствующие об экспоненциальном росте числа

«посторонних» аттракторов с ростом L.

Стремительное увеличение числа дополнительных аттракторов при

возрастании L является основной причиной малой емкости памяти сети

Хопфилда ( 0.138). При возрастании L происходит также быстрое

снижение качества воспроизведения эталонов в результате

a) сокращения бассейнов притяжения эталонов

b) уменьшения их устойчивости.

При происходит бифуркация в динамической системе сети,

аналогичная известному фазовому переходу в состояние «спинового стекла»,

характерному для изинговых спиновых систем.

Слайд 20Аналогия между сетями из формальных нейронов

Существует близкая аналогия между сетями Хопфилда и моделями Изинга магнитных спиновых систем в статистической физике. Нейронные связи в сети соответствуют взаимодействию спинов, суммарный сетевой вход на каждый нейрон – действующему на спин полю со стороны остальных спинов системы , энергия сети – магнитной энергии спиновой системы, переход нейрона в состояние возбуждения – скачкообразному изменению ориентации спина в действующем магнитном поле. Существенным фактором в спиновых моделях является наличие тепловых флуктуаций, интенсивность которых зависит от температуры. Понятие температуры оказалось полезным ввести также для нейронных сетей.

В задачах исследования поведения макроскопических спиновых систем важную информацию о макроскопическом

поведении системы удается получить в приближении среднего поля, суть которого состоит в замене флуктуирующего действующего поля его тепловым средним. Это позволяет свести задачу коллективного поведения спинов к задаче для изолированного спина во внешнем поле. Для ферромагнетиков на этом пути сразу определяется температура фазового перехода в намагниченное состояние.

Введение температуры в детерминированную модель Хопфилда позволяет построить аналог приближения среднего

поля и в пределе определить критическую температуру , ниже которой эталоны памяти остаются

устойчивыми аттракторами сетевой динамики. При происходит фазовый переход – качественное измененме поведения системы из-за «наводнения» фазового пространства динамической системы сети аттракторами «посторонней памяти». В результате прежде устойчивые аттракторы - эталоны памяти - теряют устойчивость.

Вычисление критического значения емкости сети возможно на основе связанной системы уравнений для макропеременных

,

Такая система уравнений для сети Хопфилда получена и проанализирована. В результате удалось построить полную фазовую диаграмму состояний сети и, в частности, определить критическую емкость памяти сети Хопфилда

Оказалось, что всего имеется 4 фазы: 2 фазы воспроизведения ( A – эталоны в глобальных минимумах энергии; B – состояния посторонней памяти в глобальных, а эталоны – в локальных минимумах), фаза «спинового стекла» (эталоны памяти теряют устойчивость, а состояния посторонней памяти остаются устойчивыми ) и фаза «расплавленного стекла».

Альтернативный подход – макродинамическое приближение для динамики воспроизведения эталонов памяти.

Слайд 21 Обучение нейронных сетей

Способность к обучению – одна из важнейших особенностей биологических нейронных сетей. Благодаря ей

функционирование сетей изменяется не в соответствии с какими-либо сложными привнесенными извне правилами,

а путем обучения на примерах.

Под алгоритмом обучения искусственной нейронной сети понимают модификацию матрицы связей сети методом последовательных приближений, обеспечивающую требуемую работу сети при решении конкретной задачи.

Часто изменение матрицы связей W в соответствием с выбранным алгоритмом обучения производится во время специальной «фазы обучения». Однако, возможны и процессы обучения “on-line”, когда динамика сети с изменяемой

W управляется связанной системой уравнений для состояния сети и для W.

В случае обучаемой рекуррентной сети такая связанная система уравнений может быть записана в виде:

где – «интенсивность» обучения. Из этой системы виден математический смысл процесса обучения: нейросетевое

отображение осуществляет преобразование входа сети в ее выход посредством оператора T , а процесс обучения

заставляет эволюционировать сам оператор T (медленно по сравнению с временем релаксации состояния сети x ).

Обучение “on-line”, очевидно соответствует «адиабатическому» приближению.

Большинство алгоритмов обучения основаны на методах градиентного спуска, и по существу являются методами

многомерной оптимизации. Текущие значения компонент матрицы W изменяются в терминах подходящей

функция оценивания (cost function) E(v, y; W), зависящей от величины невязки между реальным (y) и

желаемым (v) выходами сети:

Слайд 22 Алгоритм “delta-rule” для однослойного персептрона

Требуется,

Решение задачи получается в явном виде с использованием простейшей функции ошибки (cost function)

Пусть задан однослойный персептрон с отображением y=G(Wx ), где dim x = m, dim y = n, W есть матрица,

G(u) - непрерывная функция активации нейрона ( например, ). Пусть также задана «обучающая»

выборка – конечное множество известных пар вход-выход,

Поправка к весам есть

где

Отсюда поправку к весам можно получить в виде

Формулу (3) модно записать в безиндексном виде

Слайд 23 Алгоритм back-propagation

Метод back-propagation («обратного распространения ошибки») является основным рабочим алгоритмом

обучения любых многослойных сетей. Был предложен независимо исследователями Bryson & Ho (1969),

Werbos (1974), Parker (1985), Rumelhart et al (1986).

Пусть задан персептрон из L слоев с числами нейронов в слоях , функциями активации нейронов и

матрицами связей Пусть задана обучающая выборка пар вход-выход

Функцию ошибки определим так же, как в алгоритме delta-rule ( )

.

1) Вычислим выходы из всех слоев

2) Вычислим ошибки для выходного слоя по алгоритму delta-rule как для однослойного персептрона, считая

его входом

3) Определим ошибки для слоев l = L – 1, L – 2, … 1 ( т.е. в обратном порядке ) по формуле

4) Определим по найденным поправки для матриц связей всех слоев:

Тем самым мы определили выходы из всех слоев персептрона, двигаясь в «прямом» направлении от первого.

входного слоя к последнему, выходному, а затем, определив ошибки и поправку выходного

слоя , вычислили и поправки к матрицам связей всех остальных слоев, двигаясь в обратном направлении от выходного слоя персептрона к входному.

Слайд 24 Алгоритмы обучения для рекуррентных сетей

Обучение Ойа (E.Oja, 1982) модифицирует хеббово обучение таким образом, чтобы рост весов W был

ограничен. В непрерывном времени этот алгоритм обучения записывается как

Для рекуррентных сетей задача сводится к итерационному построению матрицы связей сети, при которой

обучающая выборка будет являться множеством ассоциативных пар для сети:

если задать как начальное состояние , сеть в силу предписанной ей динамики релаксирует в состояние

Этот процесс обеспечивает обучение Хебба, самый известный алгоритм обучения для рекуррентных сетей.

Обучение Хебба соответствует экспериментально наблюдаемому закону модификации синапсов в реальных

нейронных сетях (Hebb, 1949). Модификация матрицы связей при обучении Хебба определяется формулой

В случае, когда динамика сети управляется динамической системой с непрерывным временем, модификацию W

По закону обучения Хебба можно записать в виде

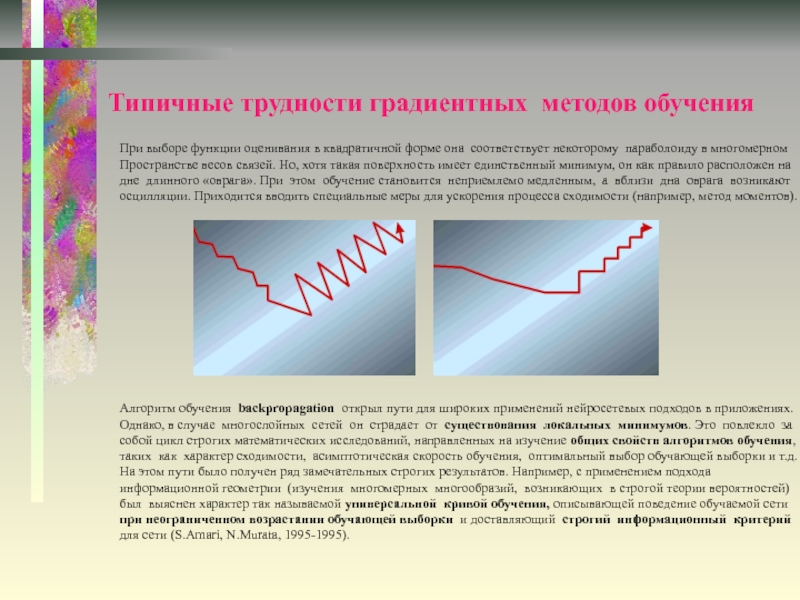

Слайд 25Типичные трудности градиентных методов обучения

При выборе функции оценивания в квадратичной форме она соответствует некоторому параболоиду в многомерном

Пространстве весов связей. Но, хотя такая поверхность имеет единственный минимум, он как правило расположен на

дне длинного «оврага». При этом обучение становится неприемлемо медленным, а вблизи дна оврага возникают

осцилляции. Приходится вводить специальные меры для ускорения процесса сходимости (например, метод моментов).

Алгоритм обучения backpropagation открыл пути для широких применений нейросетевых подходов в приложениях.

Однако, в случае многослойных сетей он страдает от существования локальных минимумов. Это повлекло за

собой цикл строгих математических исследований, направленных на изучение общих свойств алгоритмов обучения,

таких как характер сходимости, асимптотическая скорость обучения, оптимальный выбор обучающей выборки и т.д.

На этом пути было получен ряд замечательных строгих результатов. Например, с применением подхода

информационной геометрии (изучения многомерных многообразий, возникающих в строгой теории вероятностей)

был выяснен характер так называемой универсальной кривой обучения, описывающей поведение обучаемой сети

при неограниченном возрастании обучающей выборки и доставляющий строгий информационный критерий

для сети (S.Amari, N.Murata, 1995-1995).

Слайд 26 Нейрокомпьютеры

Некоторые характерные

можно указать уже теперь. Он будет:

• состоять из сетей, содержащих большое число паралледьно работающих активных элементов

( до )

• использовать ассоциативную обработку информации (храня в памяти наборы эталонов и

сравнивая с ними поступающую информацию)

• использовать обучение вместо программирования (адаптивное управление параметрами

«нейронов» и архитектурой связей в сетях).

Пока же созданы отдельные специализированные «нейрочипы» (нейропроцессоры). (В России разработки также ведутся)

Сегодня программная эмуляция (компьютерное моделирование) пока является основным способом моделирования нейронных сетей. Имеется целый ряд нейропакетов, созданных для моделирования разнообразных нейросетей. Существуют универсальные и специализированные нейропакеты. Они предоставляют пользователю следующие возможности:

— типа нейросети из набора стандартных;

— синтеза архитектуры сети;

— использования стандартных алгоритмов обучения ( типа delta-rule или backpropagation );

— включения нестандартных алгоритмов обучения ( с выбором нестандартных критериев обучения );

— использования различных вариантов визуализации результатов в процессе обучения и работы сети;

— включения программных модулей, написанных пользователем (реализовано лишь в некоторых нейропакетах).

1) NeuroSolution фирмы NeuroDimension Inc. (www.nd.com):NeuralWorksProfessionalфирмыNeuralWareInc. (www.neuralware.com)

2) NeuroShell 2 фирмы Ward Systems Group (www.wardsystems.com)

3) BrainMaker Pro фирмы California Scientific Software (www.calsci.com)

Примерами универсальных нейропакетов являются:

В России разработки нейропакетов также ведутся. Примером является пакет «Нейроимитатор», разработанный в МИРЭА.

Слайд 27 Динамические нейронные сети

Сети из формальных нейронов вполне

систем из большого числа активных элементов, осуществляющих параллельную обработку информации.

Изучение аспектов функционирования биологических нейронных сетей требует следующего естественного шага –

построения моделей нейрона, воспроизводящих импульсный характер нейронной активности. Это привело к серии моделей импульсных («спайковых») нейронов и изучению нейронных сетей из «спайковых» нейронов с импульсным взаимодействием .

Далее, экспериментально было обнаружено, что при обработке информации целый ряд структур мозга при обработке информации используют в качестве «рабочих инструментов» колебательную активность, синхронизацию и резонанс. Примерами таких структур являются обонятельная система (обонятельная луковица и кора ), слуховая система (улитка уха и слуховая кора ), зрительная система (сетчатка и зрительная кора).

Это стимулировало моделирование осцилляторных нейронных сетей. Активным элементом таких сетей является нейронный осциллятор, образованный парой нейронов, связанных возбуждающей и тормозной связями.

Так были построены модели осцилляторных сетей для задач распознавания запахов, распознавания речи при наличии

смеси многих интерферирующих звуковых источников и распознавания зрительных изображений. Работа построенных сетей порождает динамические методы обработки информации, основанные на синхронизации ансамблей сетевых осцилляторов.

Были также построены модели искусственных осцилляторных сетей ассоциативной памяти, активными элементами

которых являются различные модели осцилляторов. Эталонами памяти в таких сетях являются не состояния

устойчивого равновесия, а предельные циклы – состояния устойчивых синхронизованных колебаний осцилляторной

сети. Воспроизведение эталонов осуществляется посредством синхронизации. Были даже предложены теоретические модели оптических нейрокомпьютеров, построенных на осцилляторах, связанных через галографическую среду.

Слайд 28Некоторые направления современных исследований

• Математическиее аспекты ( развиваются на пересечении с

геометрии, статистического оценивания, регуляризации, многомерной оптимизации,

нелинейной фильтрации, методов нелинейного анализа смесей информационных

потоков (“blind signal separation”) и др.)

• Нейрокомпьютинг и интеллектуальные информационные системы

• Популяции автономных роботов с целенаправленным поведением (искусственная жизнь, генетические алгоритмы)

• Динамические нейронные сети и моделирование структур мозга ( в том числе развитие подходов к

моделированию сознания)

• Нейроморфное моделирование и биоробототехника ( в том числе нейропротезирование )

• Параллельные вычислительные алгоритмы ( «нейроматематика» )

• Прикладные нейросетевые исследования ( технические системы с адаптивным управлением, мониторинг, анализ

рынков, банки данных, маркетинг и др.)

• Квантовый компьютинг и квантовые нейронные сети.

Слайд 32Биологические нейроны

.

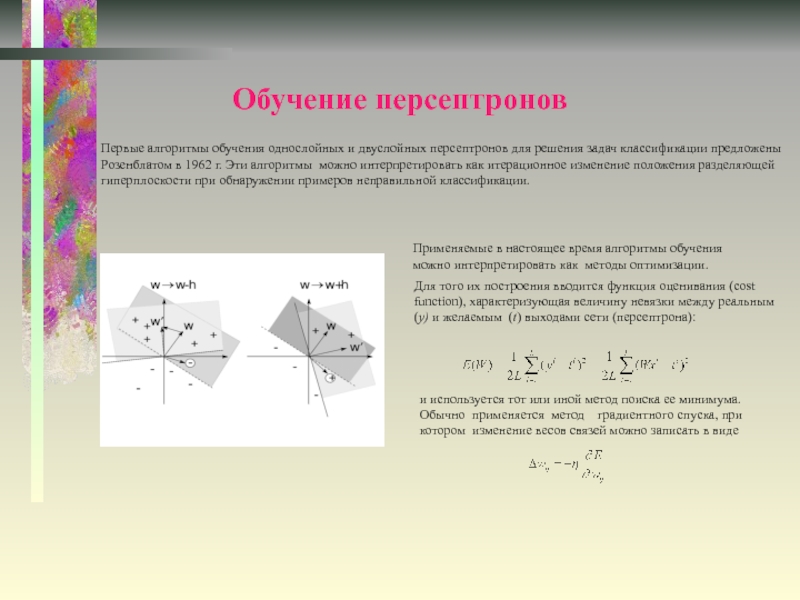

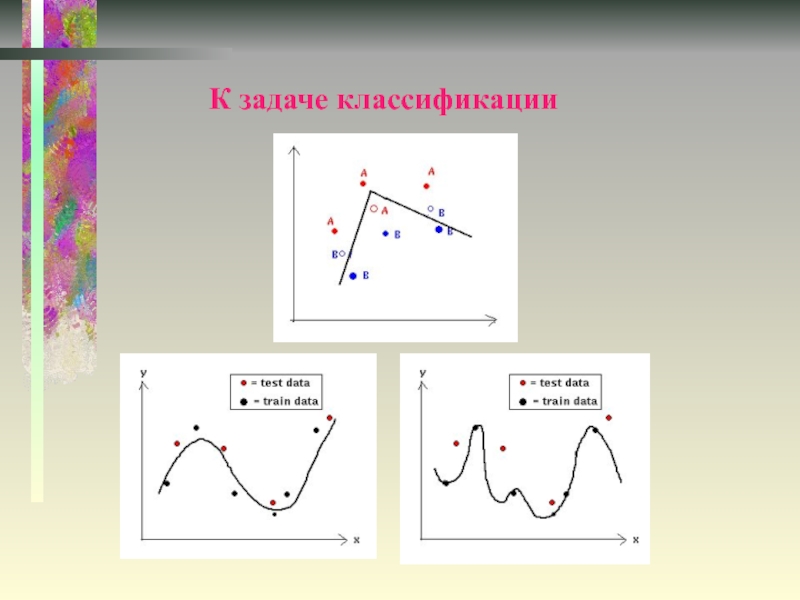

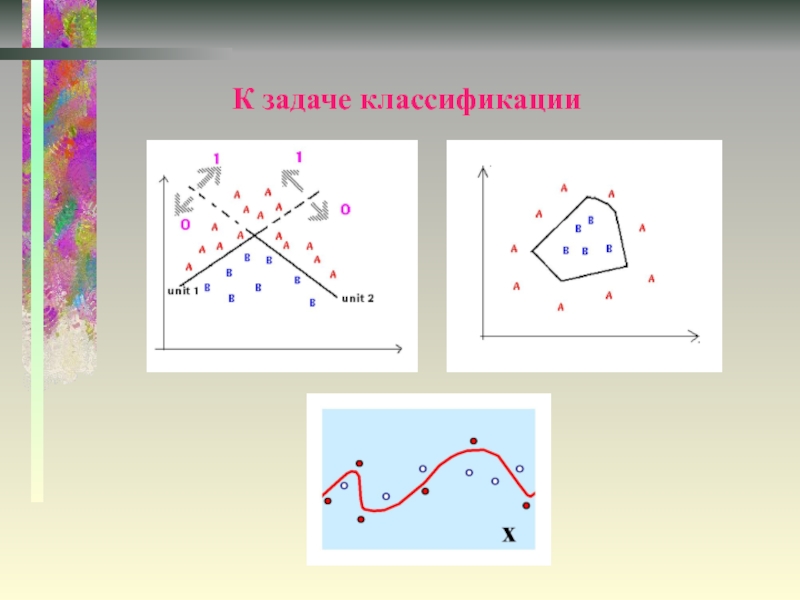

Слайд 34 Обучение персептронов

Первые алгоритмы обучения однослойных и двуслойных персептронов для решения задач классификации предложены

Розенблатом в 1962 г. Эти алгоритмы можно интерпретировать как итерационное изменение положения разделяющей гиперплоскости при обнаружении примеров неправильной классификации.

Для того их построения вводится функция оценивания (cost function), характеризующая величину невязки между реальным

(y) и желаемым (t) выходами сети (персептрона):

Применяемые в настоящее время алгоритмы обучения

можно интерпретировать как методы оптимизации.

и используется тот или иной метод поиска ее минимума.

Обычно применяется метод градиентного спуска, при котором изменение весов связей можно записать в виде