- Главная

- Разное

- Дизайн

- Бизнес и предпринимательство

- Аналитика

- Образование

- Развлечения

- Красота и здоровье

- Финансы

- Государство

- Путешествия

- Спорт

- Недвижимость

- Армия

- Графика

- Культурология

- Еда и кулинария

- Лингвистика

- Английский язык

- Астрономия

- Алгебра

- Биология

- География

- Детские презентации

- Информатика

- История

- Литература

- Маркетинг

- Математика

- Медицина

- Менеджмент

- Музыка

- МХК

- Немецкий язык

- ОБЖ

- Обществознание

- Окружающий мир

- Педагогика

- Русский язык

- Технология

- Физика

- Философия

- Химия

- Шаблоны, картинки для презентаций

- Экология

- Экономика

- Юриспруденция

Радиотехнические системы передачи информации презентация

Содержание

- 1. Радиотехнические системы передачи информации

- 2. * Лекция 1. Введение Число пользователей мобильной

- 3. * Основные концепции построения сотовых сетей Особенности

- 4. * Гексагональная структура сотовой сети Пример используемой

- 5. * Функциональная схема цифровой системы связи

- 6. * Повторное использование частот (frequency reuse) Цифра

- 7. * Жесткая «Handoff»-процедура Жесткий handoff - обслуживание

- 8. * Мягкий handoff - обслуживание лучшей базовой

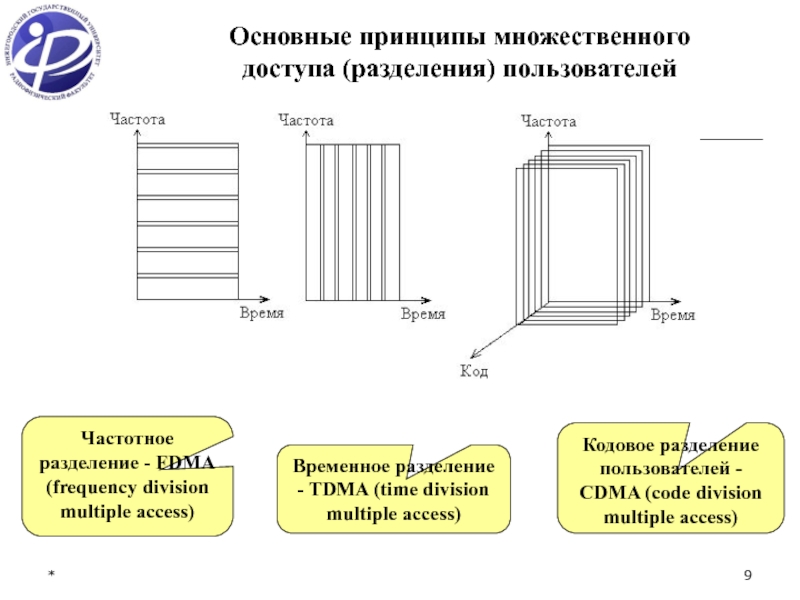

- 9. * Частотное разделение - FDMA (frequency division

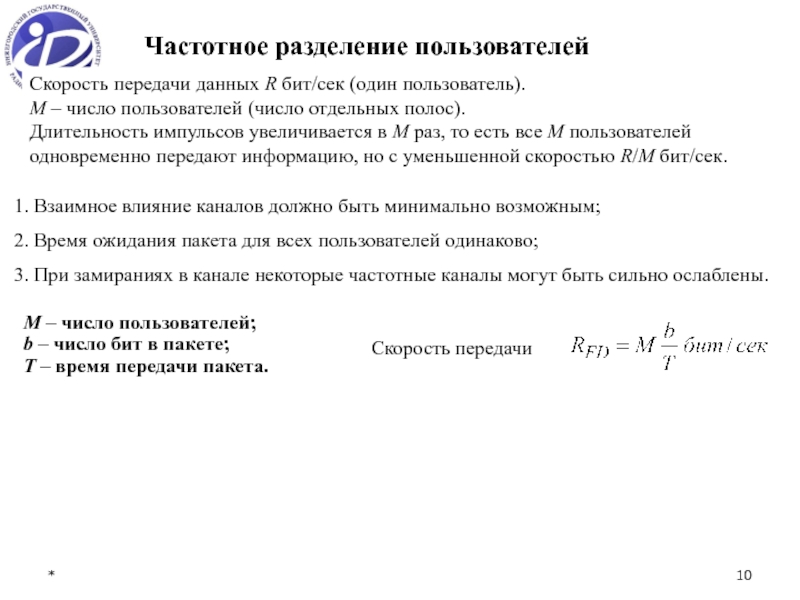

- 10. * Частотное разделение пользователей М – число

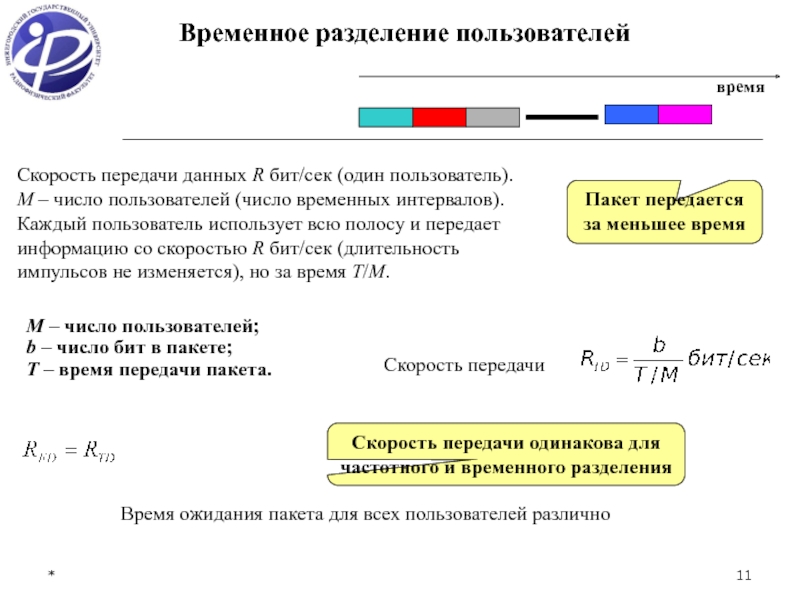

- 11. * Временное разделение пользователей М – число

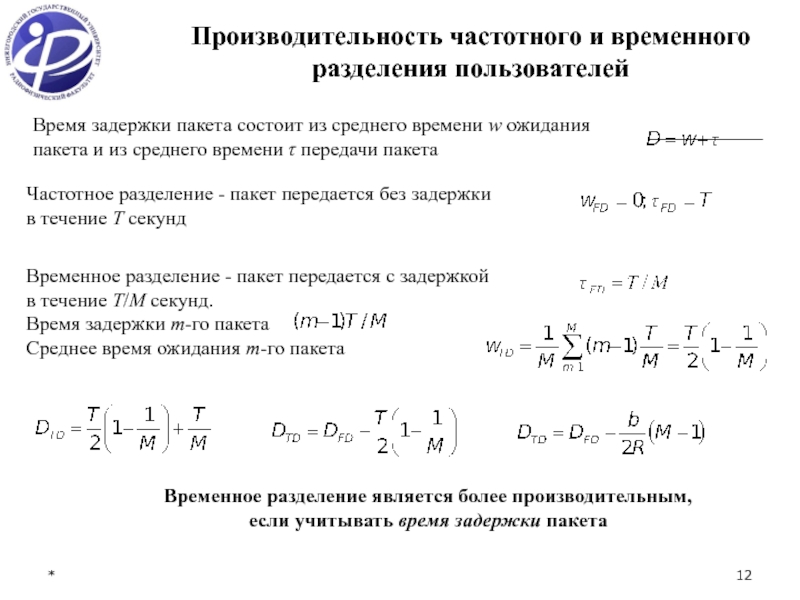

- 12. * Производительность частотного и временного разделения пользователей

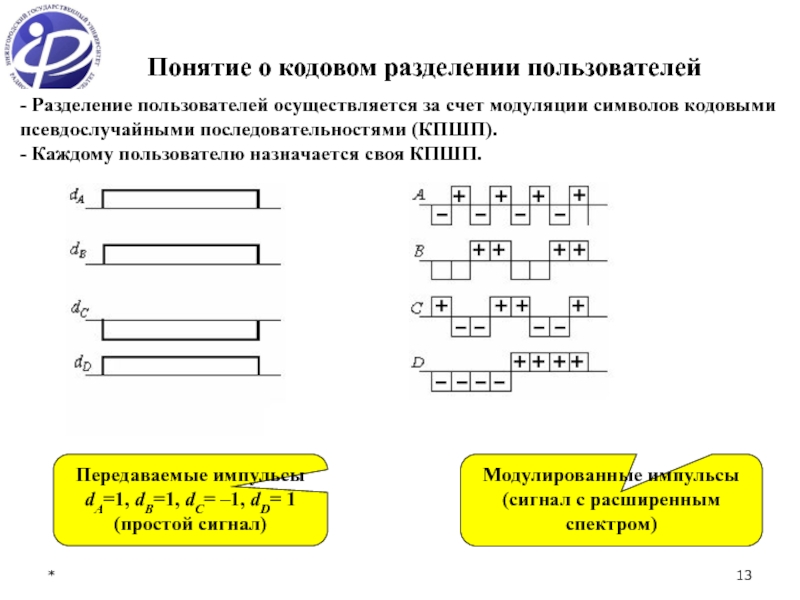

- 13. * Понятие о кодовом разделении пользователей -

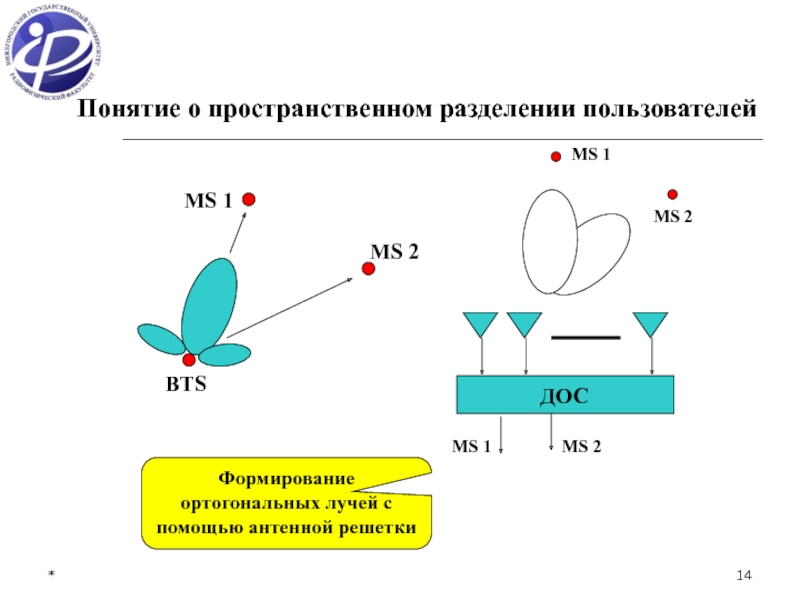

- 14. * Понятие о пространственном разделении пользователей

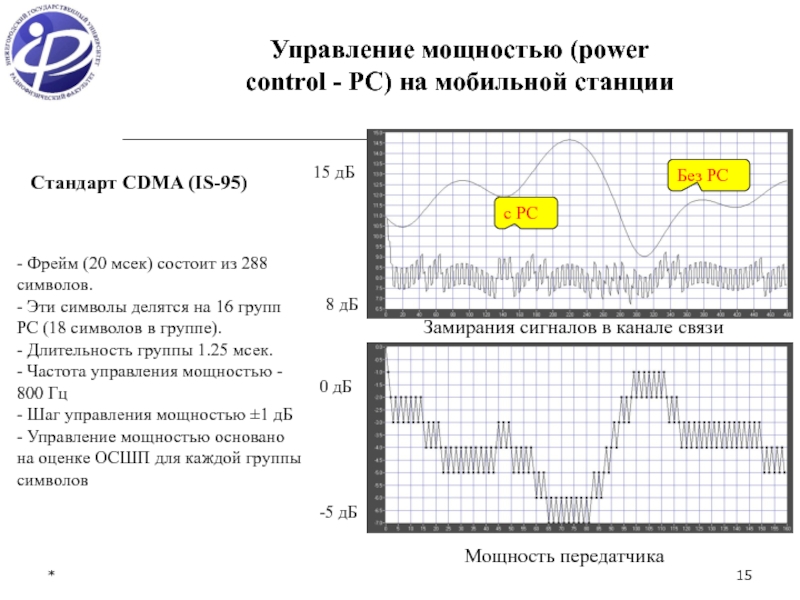

- 15. * Замирания сигналов в канале связи Мощность

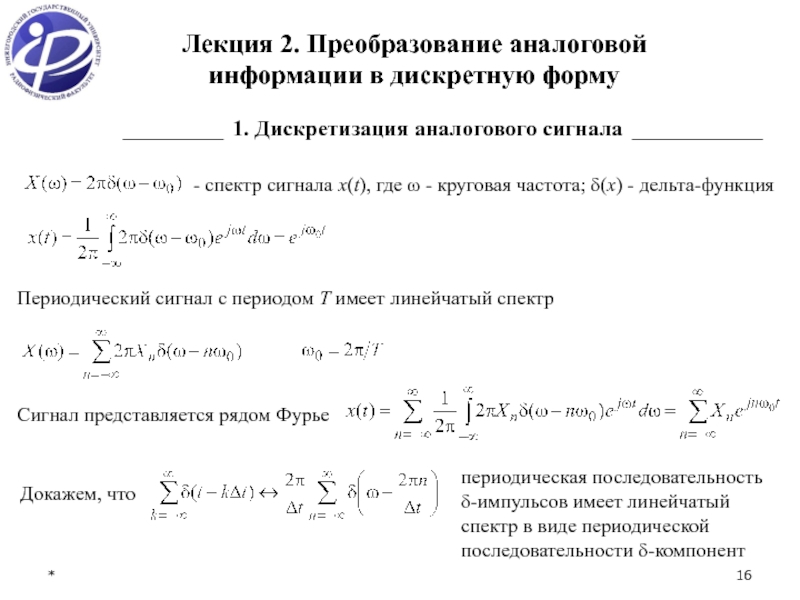

- 16. * Лекция 2. Преобразование аналоговой информации в

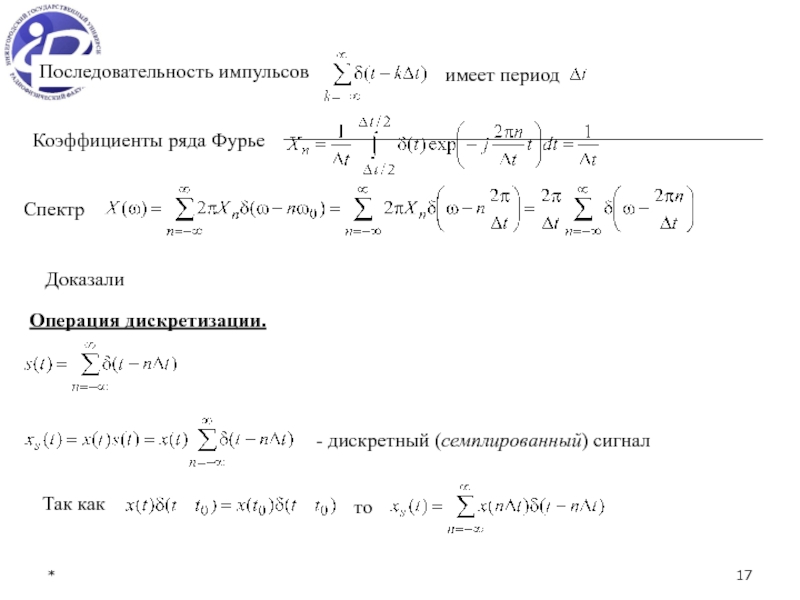

- 17. * Последовательность импульсов Коэффициенты ряда Фурье

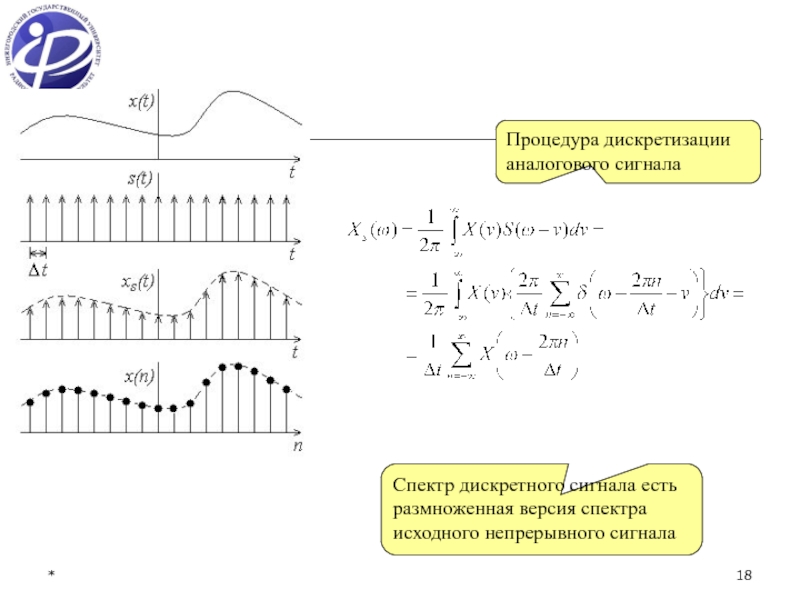

- 18. Процедура дискретизации аналогового сигнала Спектр дискретного сигнала есть размноженная версия спектра исходного непрерывного сигнала *

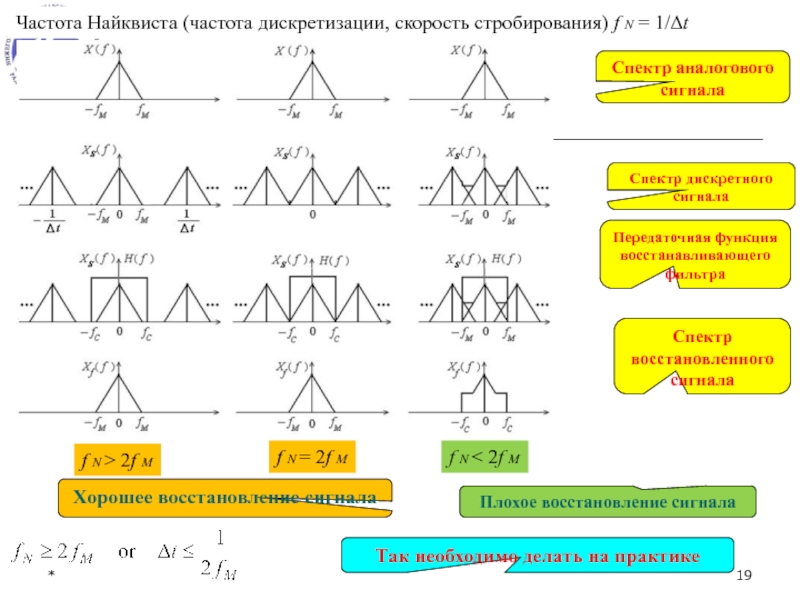

- 19. * Хорошее восстановление сигнала Так необходимо делать

- 20. * 2. Теорема Котельникова Непрерывный сигнал с

- 21. * 3. Квантование аналоговых сигналов

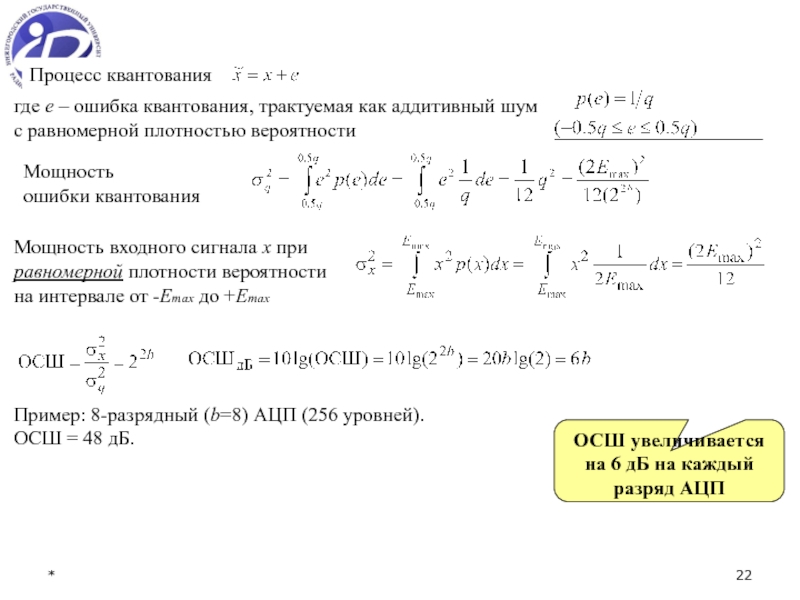

- 22. * Процесс квантования где e

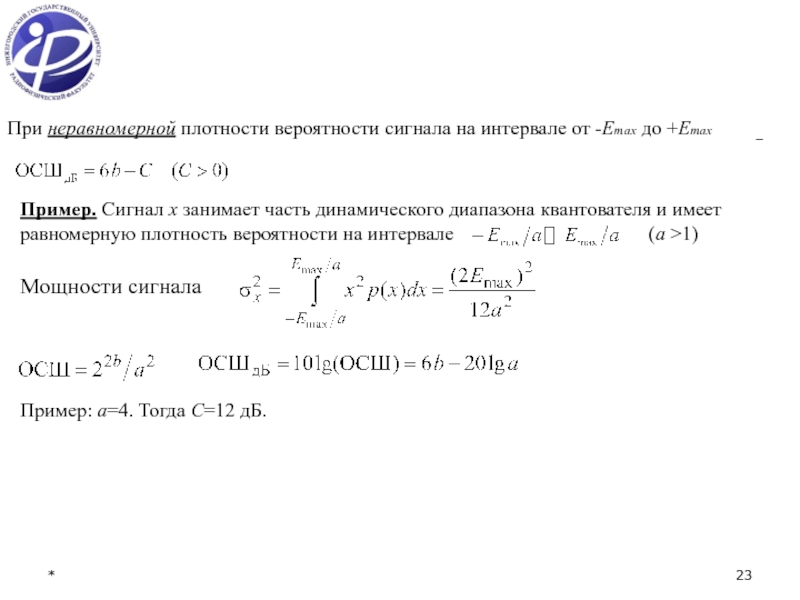

- 23. * При неравномерной плотности вероятности сигнала

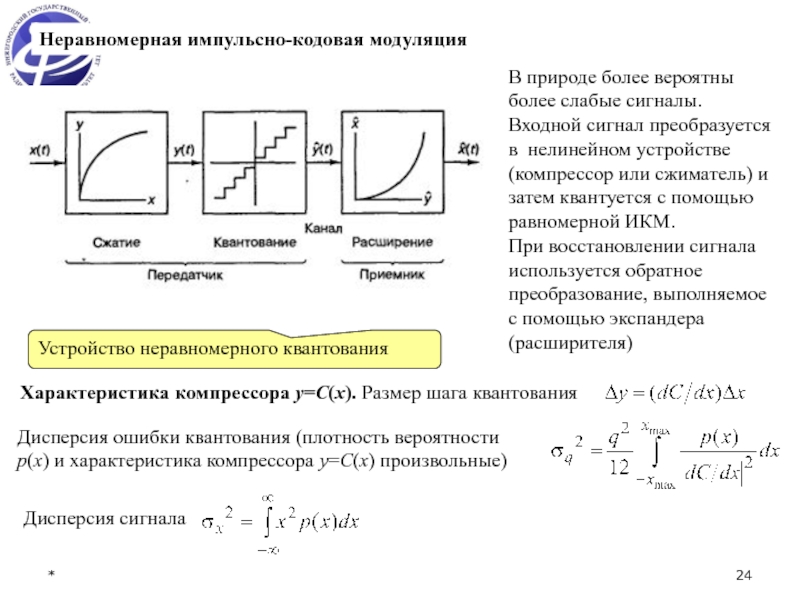

- 24. * Неравномерная импульсно-кодовая модуляция В

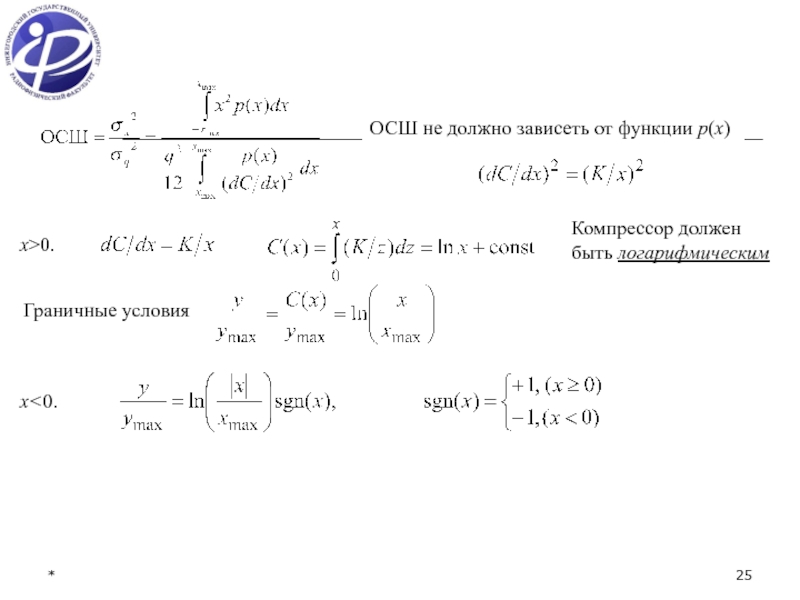

- 25. * ОСШ не должно зависеть от функции

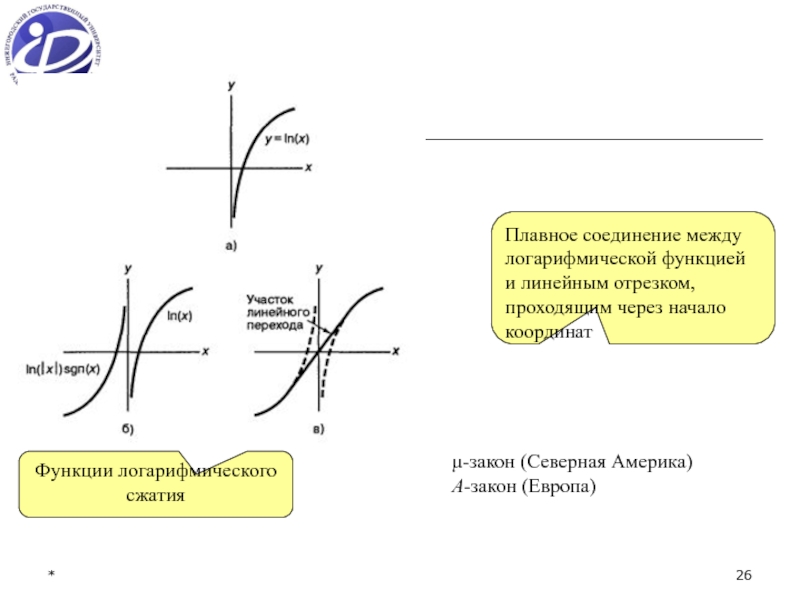

- 26. * μ-закон (Северная Америка) A-закон (Европа)

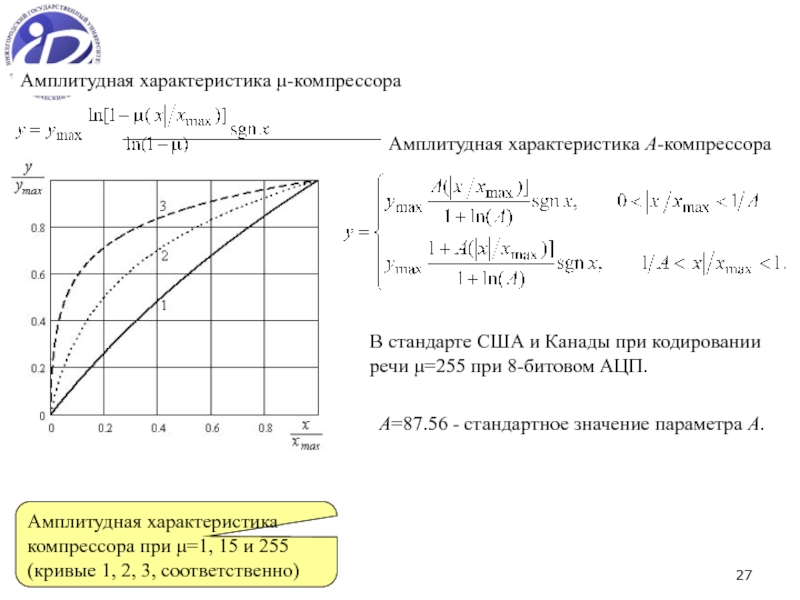

- 27. * Амплитудная характеристика компрессора при μ=1,

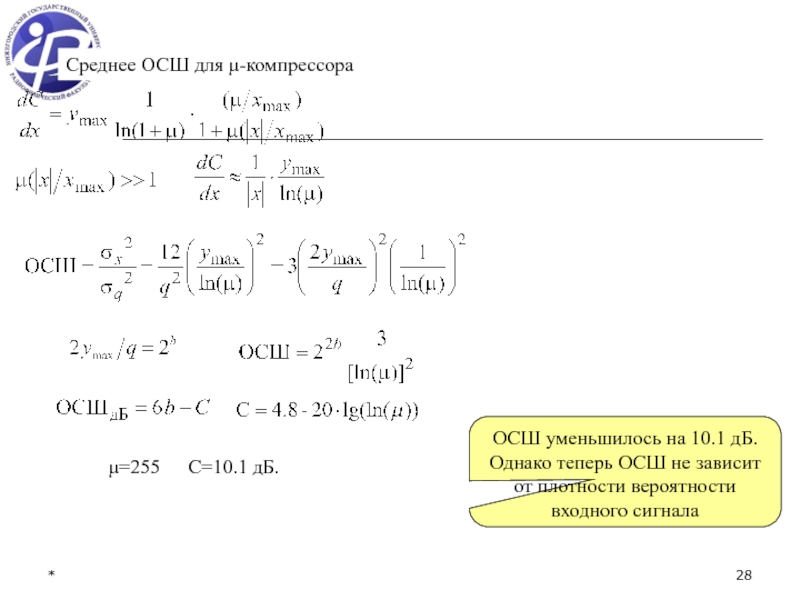

- 28. * Среднее ОСШ для μ-компрессора

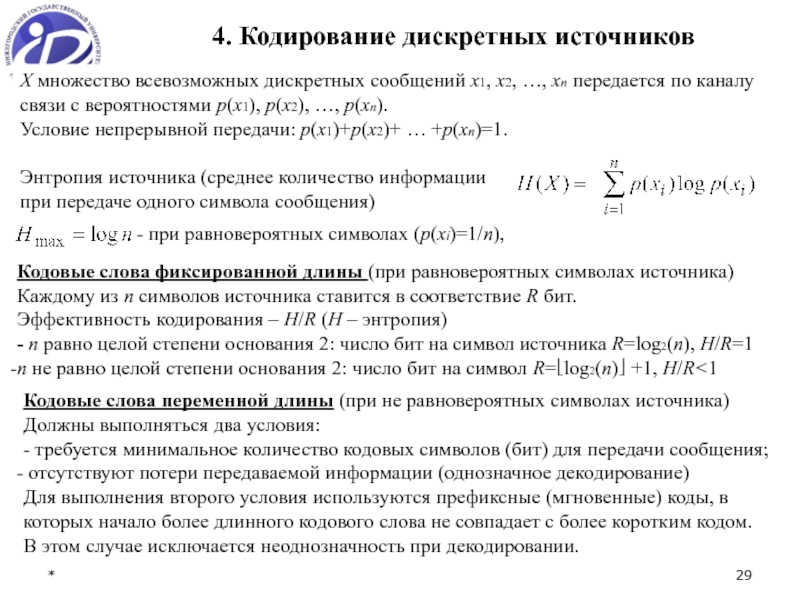

- 29. * 4. Кодирование дискретных источников Кодовые слова

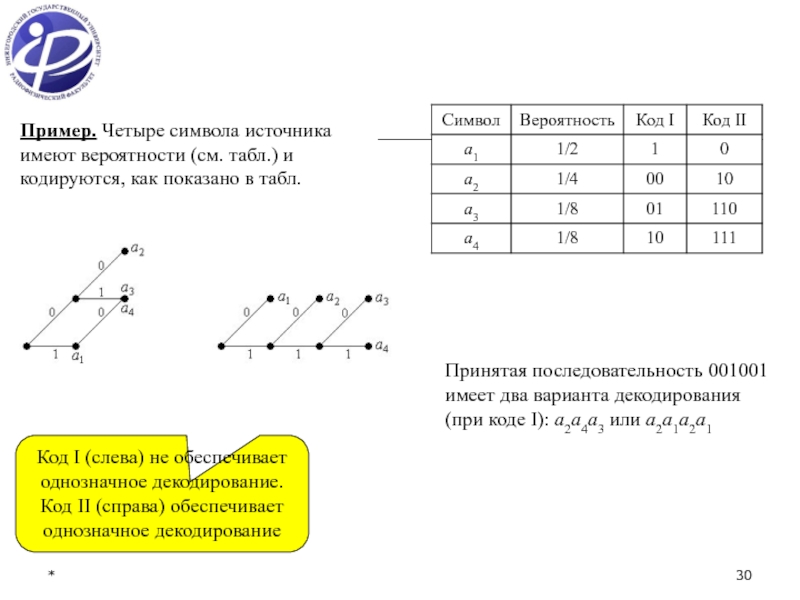

- 30. * Пример. Четыре символа источника имеют вероятности

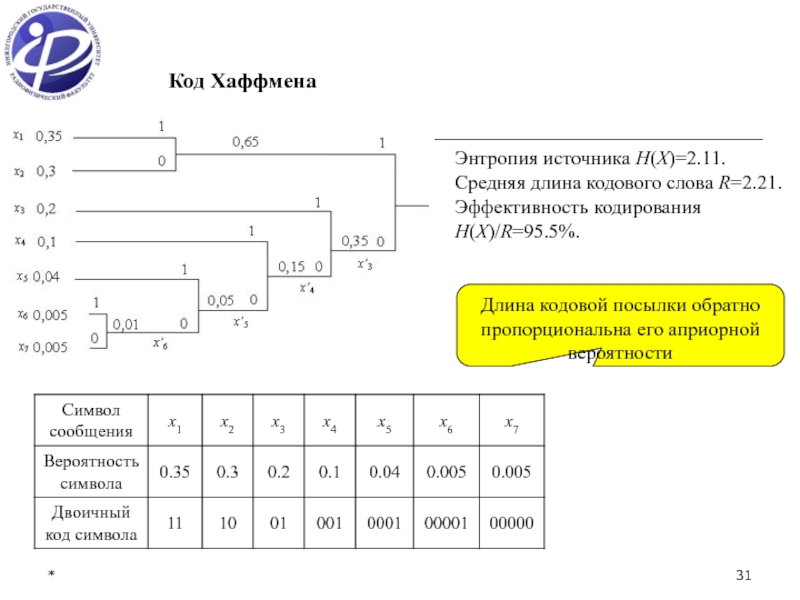

- 31. * Энтропия источника H(X)=2.11. Средняя длина кодового

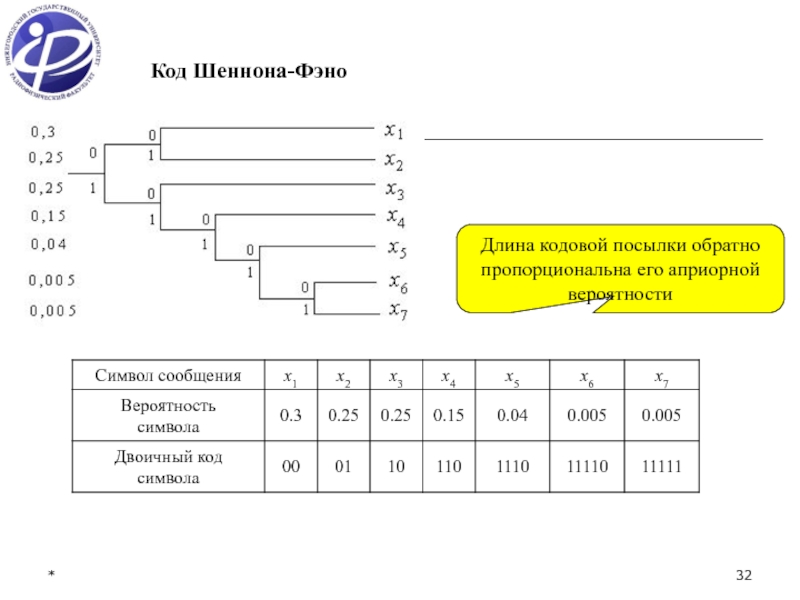

- 32. * Код Шеннона-Фэно Длина кодовой посылки обратно пропорциональна его априорной вероятности

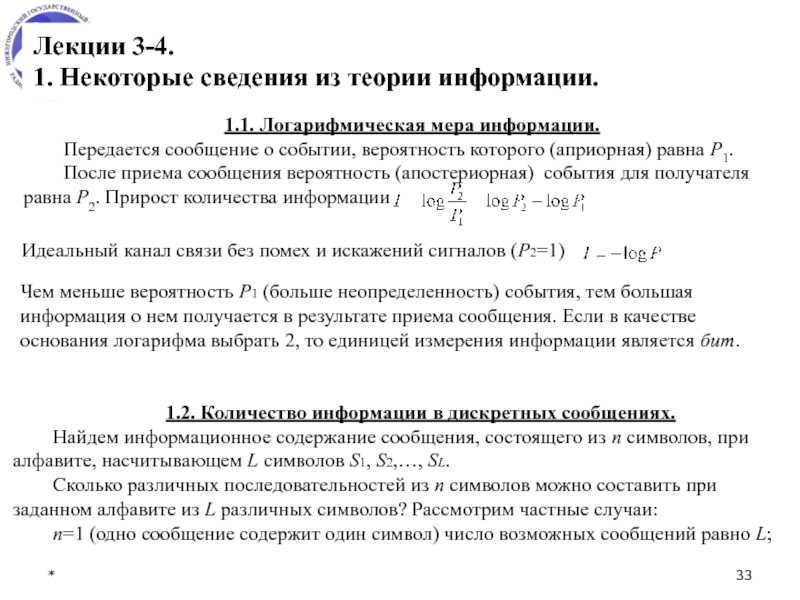

- 33. * Лекции 3-4. 1. Некоторые сведения из

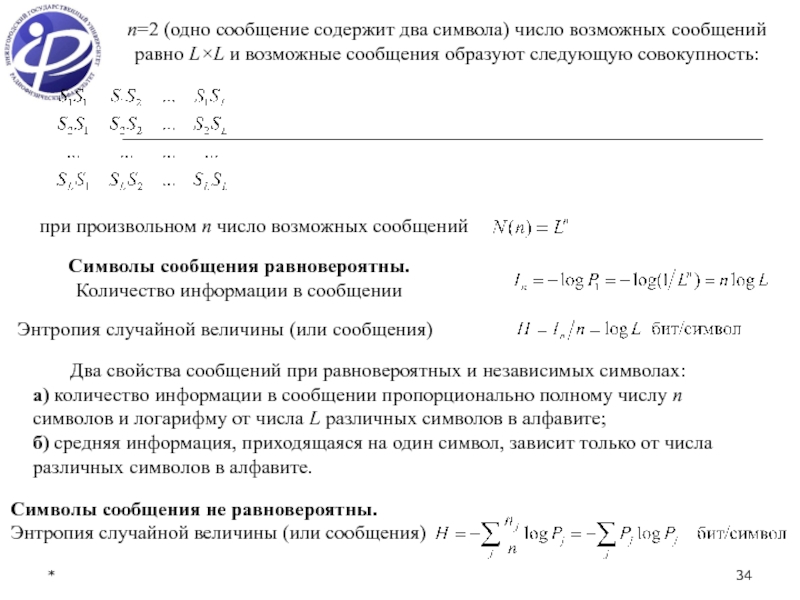

- 34. * при произвольном n число возможных сообщений

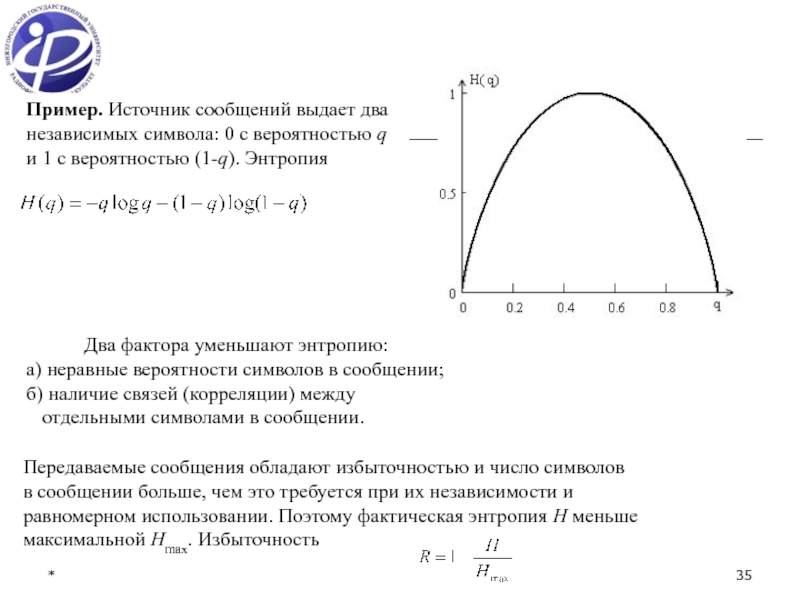

- 35. * Два фактора уменьшают энтропию: а) неравные

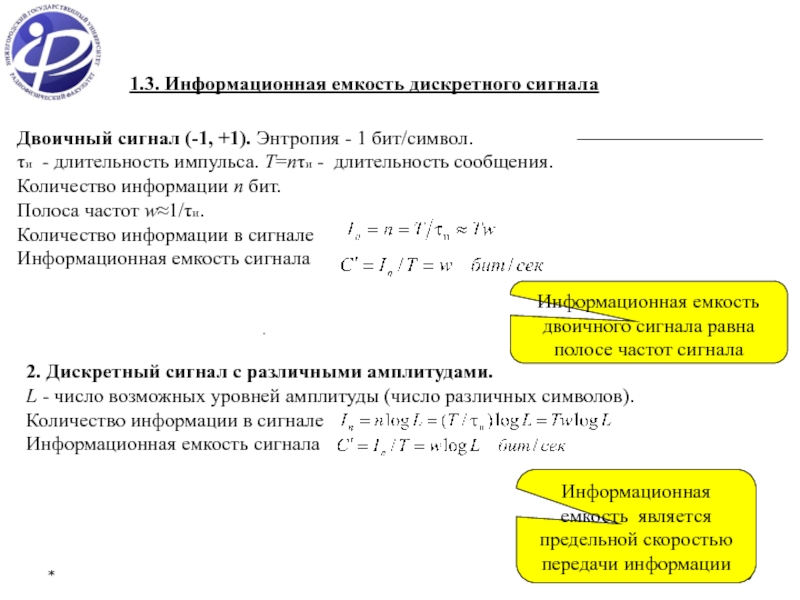

- 36. * 2. Дискретный сигнал с различными амплитудами.

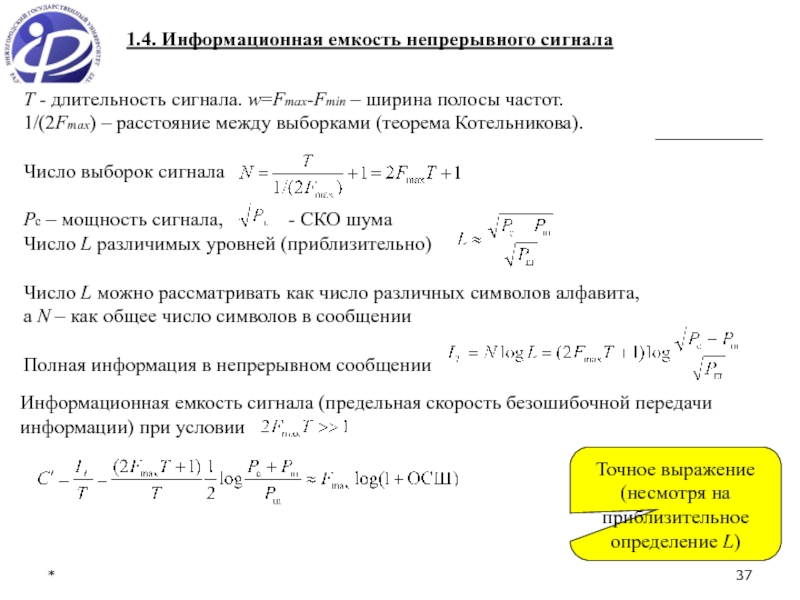

- 37. * 1.4. Информационная емкость непрерывного сигнала

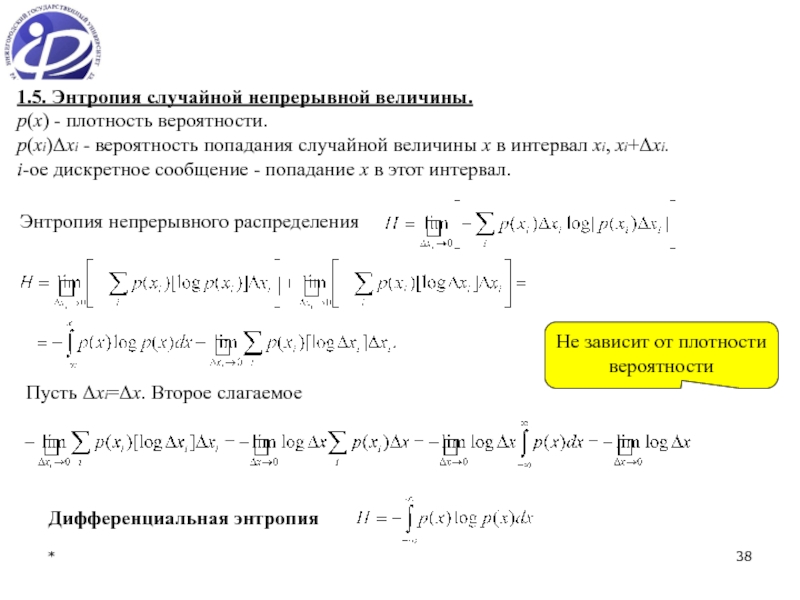

- 38. * 1.5. Энтропия случайной непрерывной величины.

- 39. * Примеры. 1. Гармоническое колебание со случайной

- 40. * Плотность вероятности процесса со случайной

- 41. * 2. Модели каналов без памяти.

- 42. * 2.2. Дискретный канал без памяти (ДКБП).

- 43. * 2.3. Канал с дискретным входом и

- 44. * 2.4. Сигнальный канал. Это физический канал

- 45. * 3.1. Дискретный канал без памяти (ДКБП).

- 46. * Пример. ДСКБП с переходными вероятностями P(0/1)=p

- 47. * 3.2. Канал с дискретным входом и

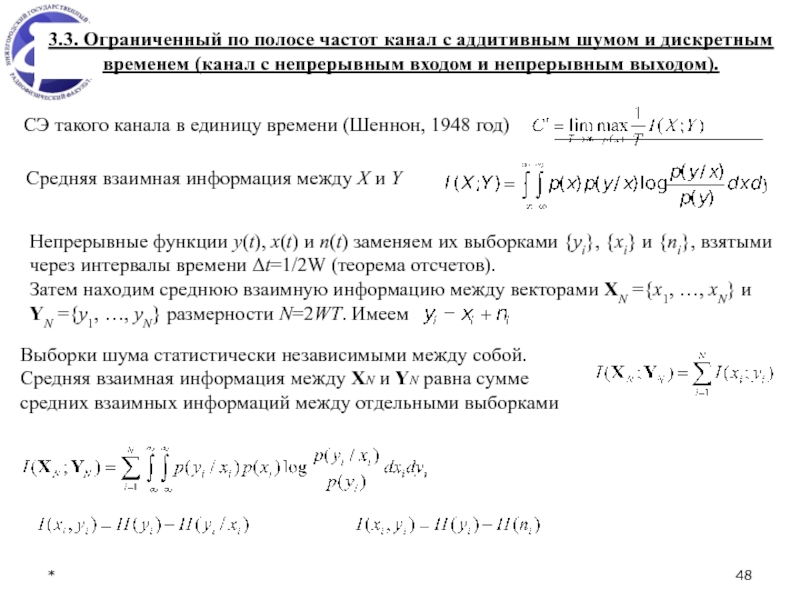

- 48. * 3.3. Ограниченный по полосе частот канал

- 49. * СЭ канала в единицу времени (удельная

- 50. * Спектральная плотность мощности шума -

- 51. *

- 52. * 1. Цифровой модулятор преобразует битовую последовательность

- 53. * Цифровой АМ сигнал на интервале времени

- 54. * - энергия

- 55. * При ФМ M сигналов на интервале

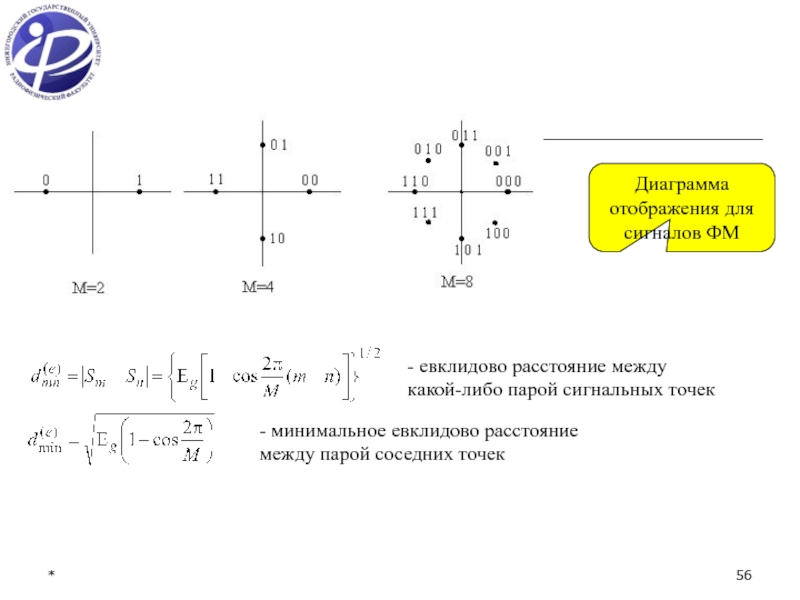

- 56. * Диаграмма отображения для сигналов ФМ

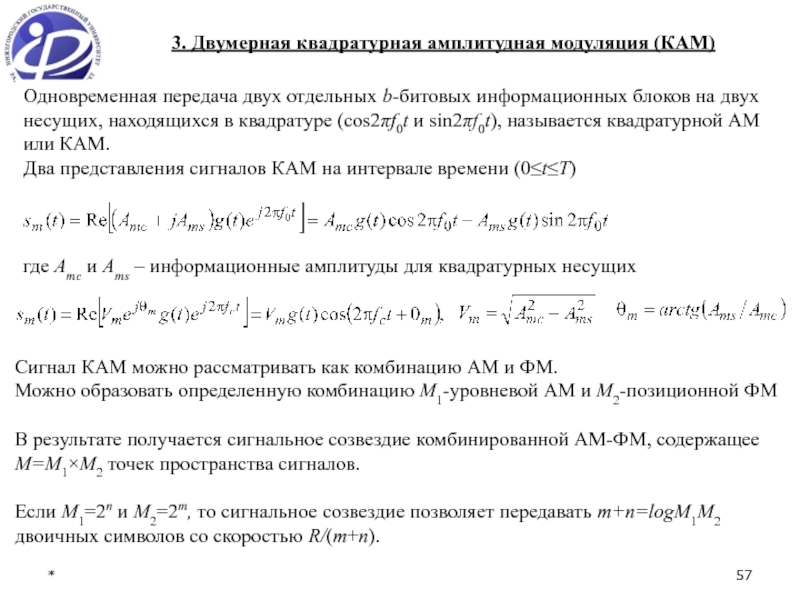

- 57. * Одновременная передача двух отдельных b-битовых информационных

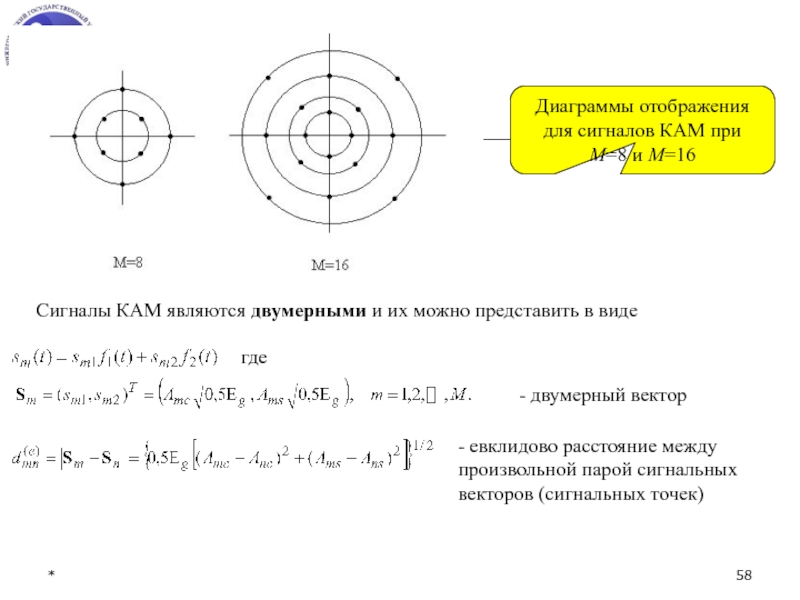

- 58. * Диаграммы отображения для сигналов КАМ при

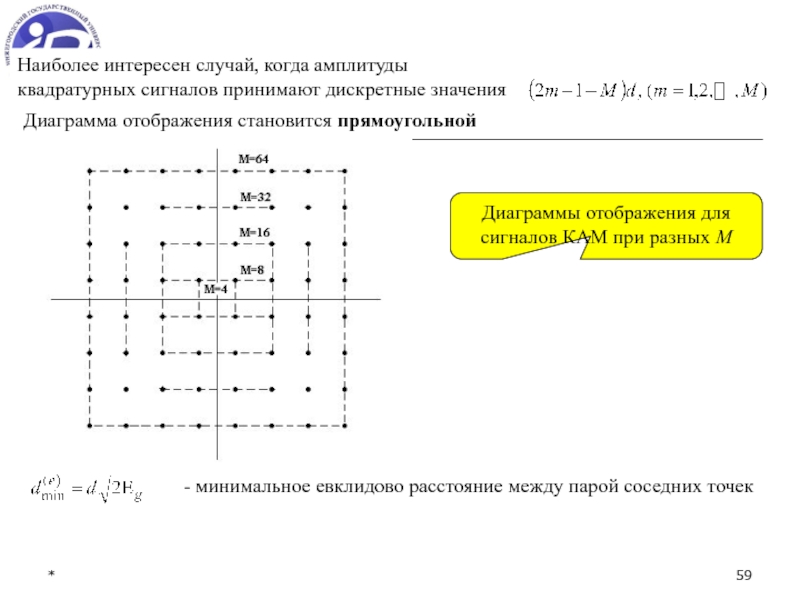

- 59. * Наиболее интересен случай, когда амплитуды квадратурных

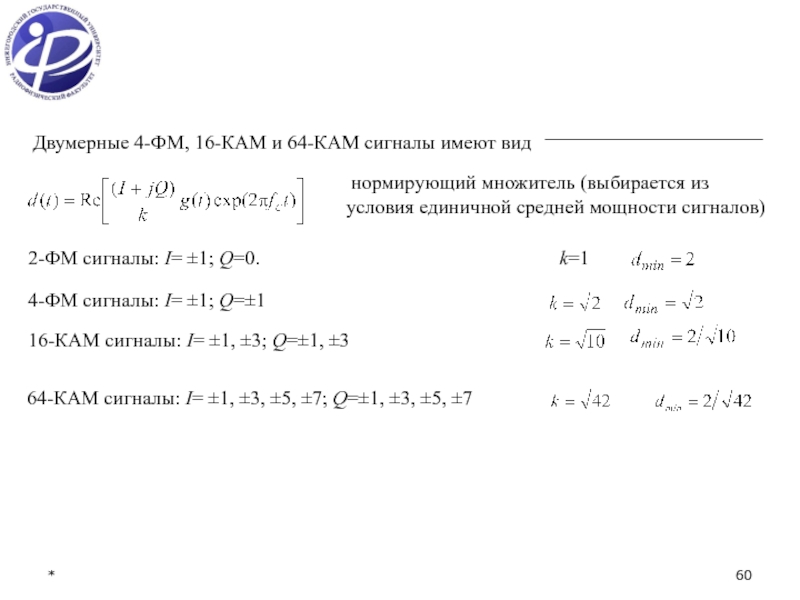

- 60. * Двумерные 4-ФМ, 16-КАМ и 64-КАМ сигналы

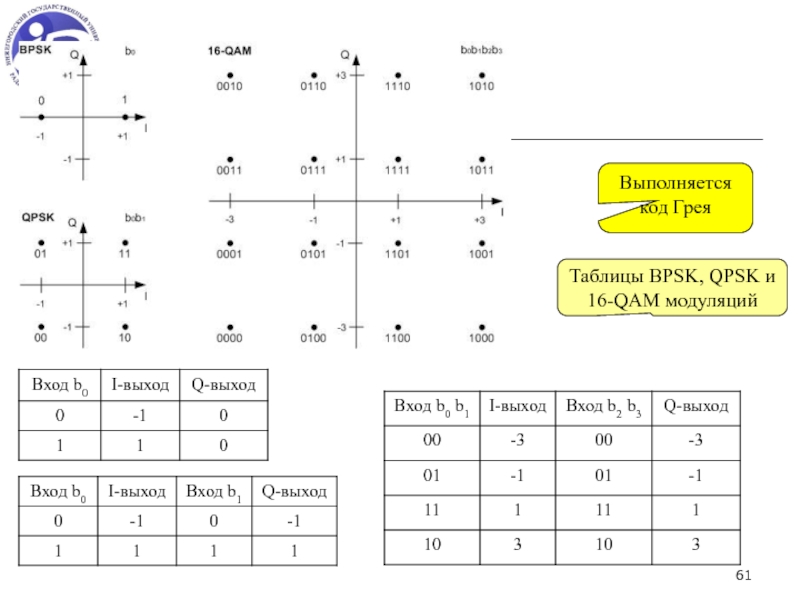

- 61. Таблицы BPSK, QPSK и 16-QAM модуляций Выполняется код Грея

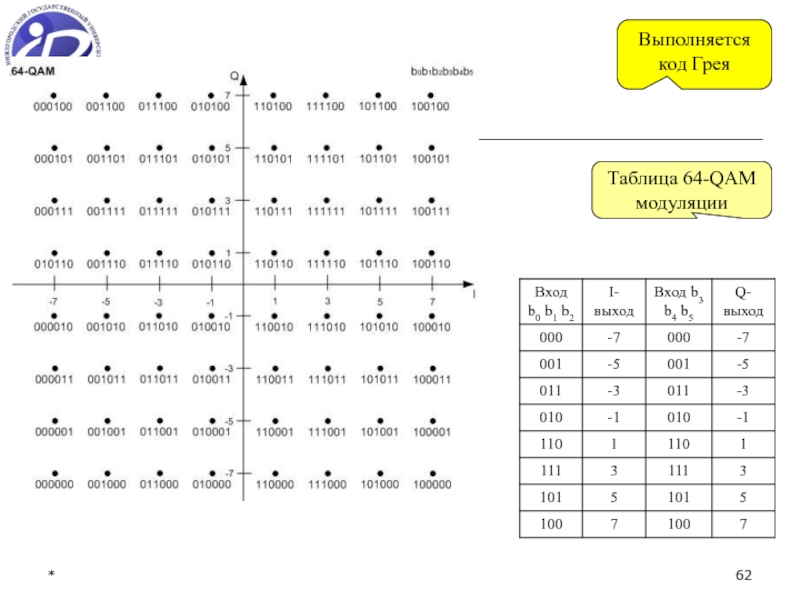

- 62. Таблица 64-QAM модуляции Выполняется код Грея *

- 63. Применение некоторых модуляций в системах связи

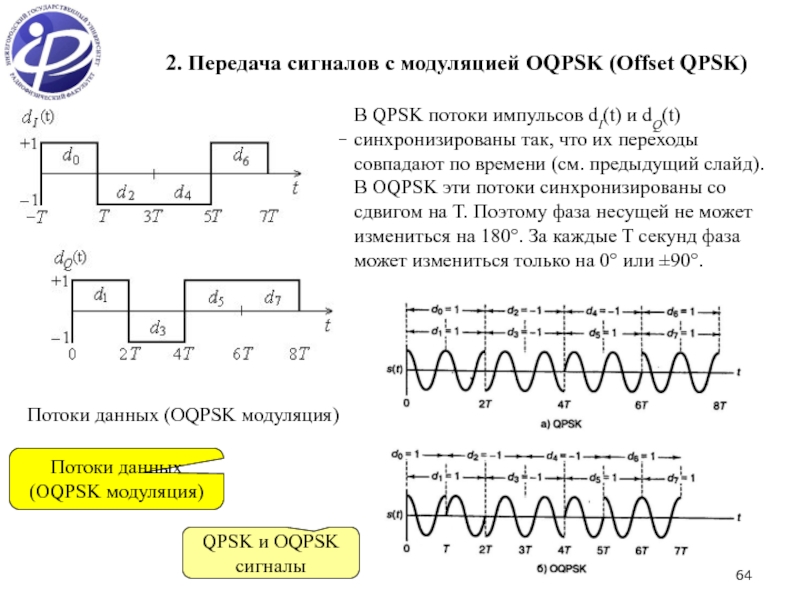

- 64. 2. Передача сигналов с модуляцией OQPSK (Offset

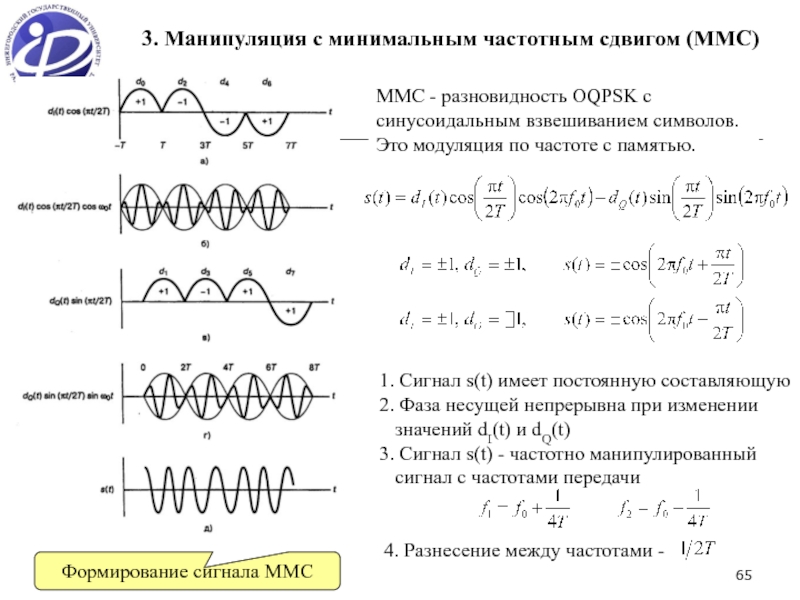

- 65. 3. Манипуляция с минимальным частотным сдвигом (ММС)

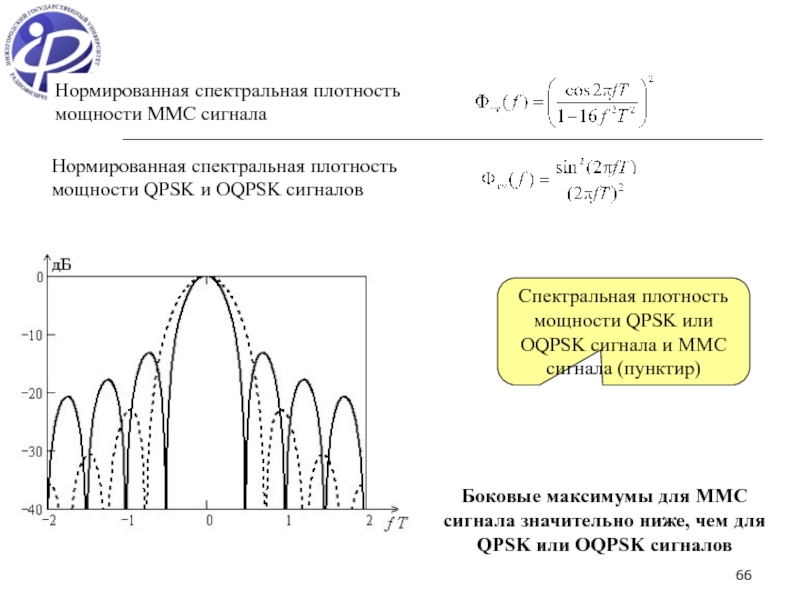

- 66. Нормированная спектральная плотность мощности ММС сигнала

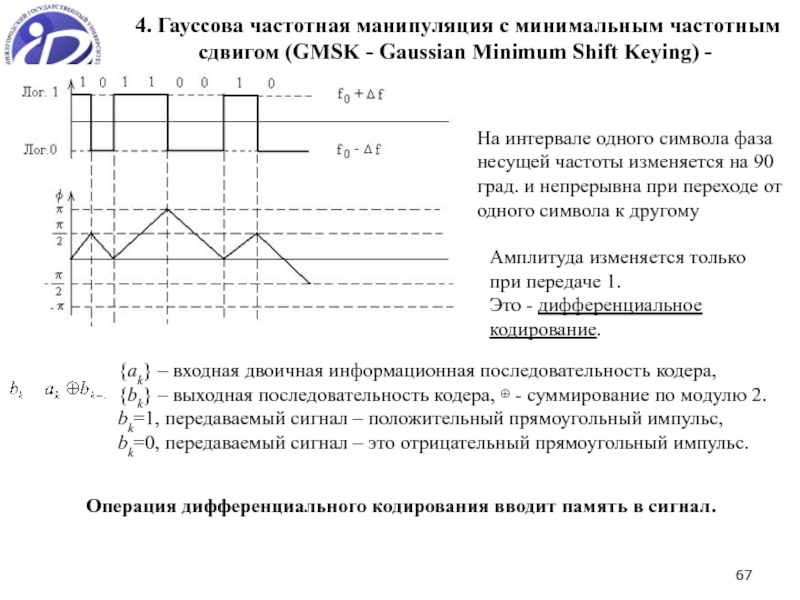

- 67. На интервале одного символа фаза несущей частоты

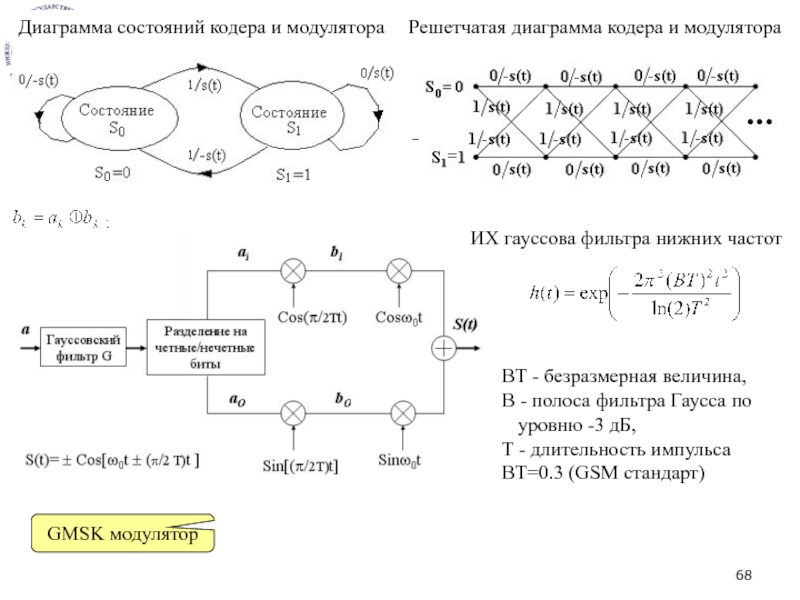

- 68. ИХ гауссова фильтра нижних частот GMSK

- 69. * Лекция 6. 1. Оптимальный прием сигналов

- 70. * 2-ФМ сигналы (N=1) – энергия

- 71. * Проекции на базисные функции 0.5N0

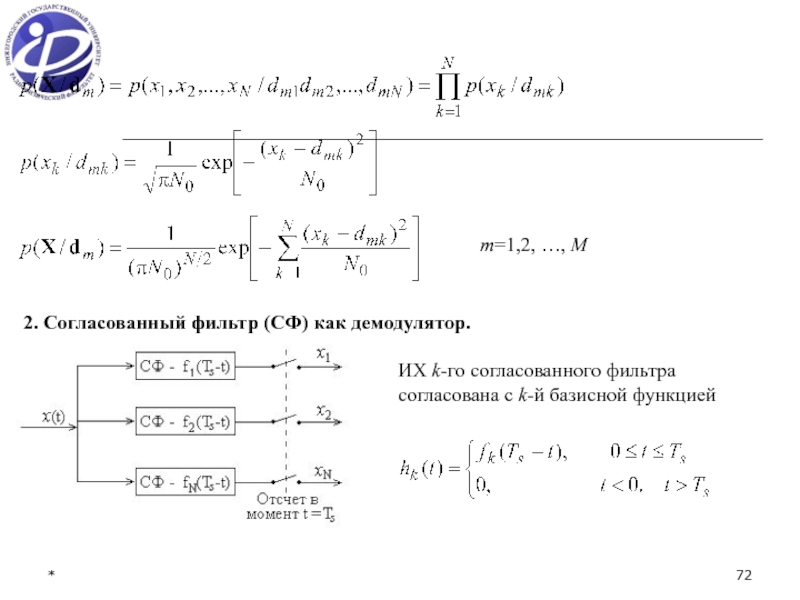

- 72. * m=1,2, …, M 2. Согласованный фильтр

- 73. * Отсчет в момент времени t=Ts

- 74. * Критерий максимального правдоподобия. Используется когда априорная

- 75. * Пример. 4-ФМ сигналы (N=2) Обозначение Детектирование по минимуму расстояния Корреляционная метрика

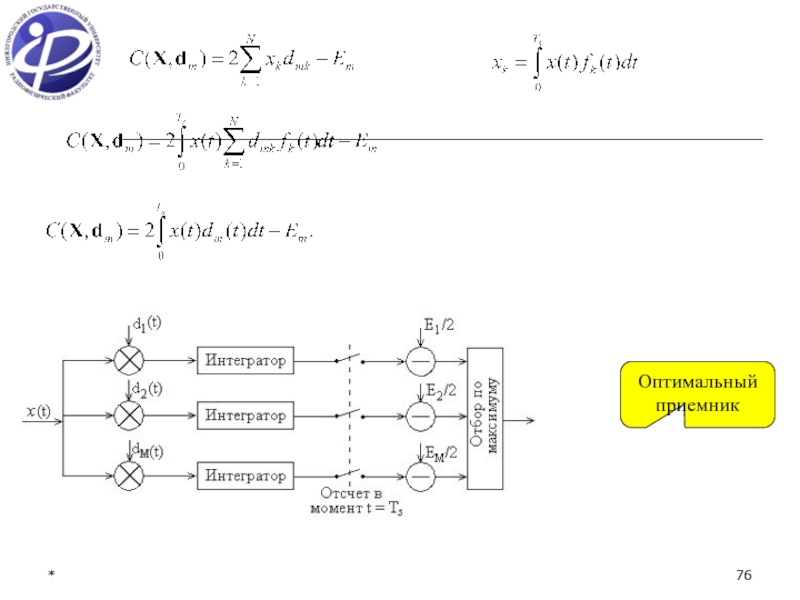

- 76. * Оптимальный приемник

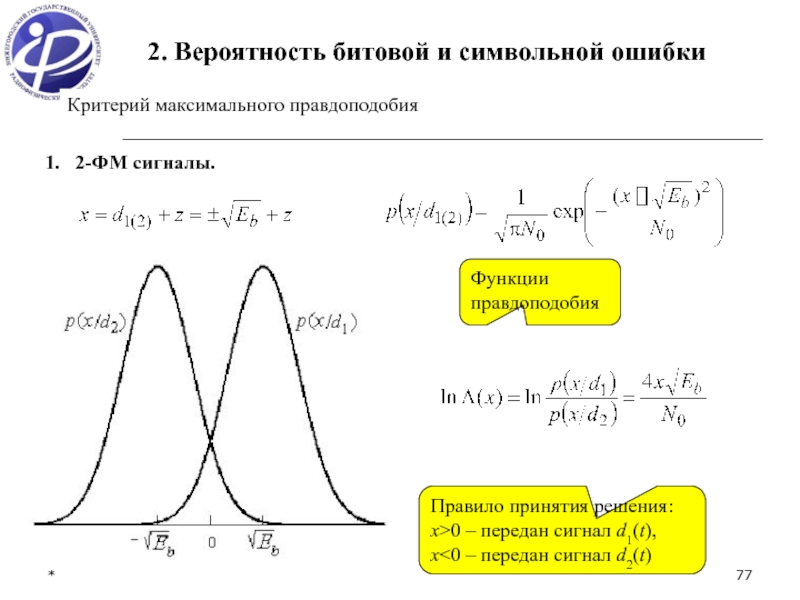

- 77. * 2. Вероятность битовой и символьной ошибки

- 78. * Вероятность битовой ошибки при передаче первого

- 79. * Φ(x) – интеграл вероятности

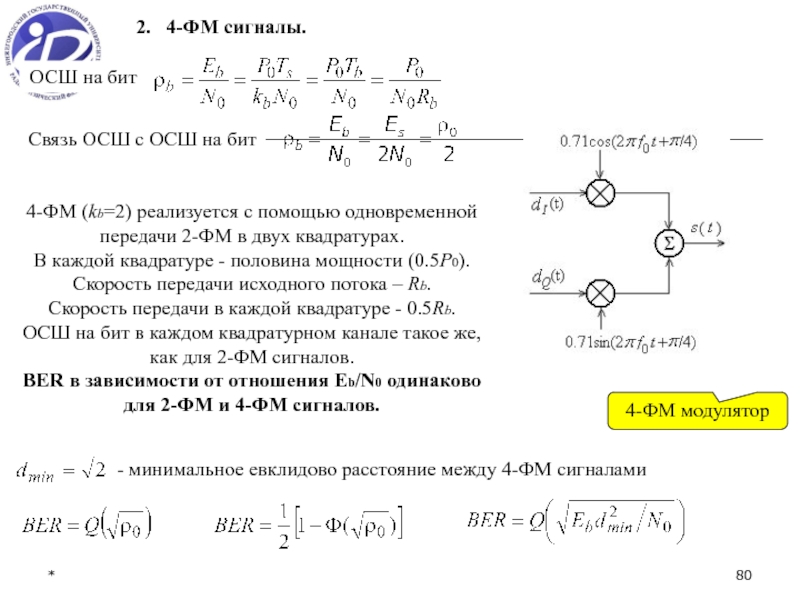

- 80. * 2. 4-ФМ сигналы. 4-ФМ

- 81. * BER в зависимости от ОСШ для

- 82. * Вероятность символьной ошибки (SER) Вероятность правильного

- 83. * BER в зависимости от ОСШ для

- 84. * BER в зависимости от ОСШ для

- 85. * Приближенная формула для достаточно высоких уровней

- 86. BER в зависимости от Eb/N0 для 2-ФМ,

Слайд 1*

Радиотехнические системы передачи информации

Профессор, д.ф.-м.н. А.Г. Флаксман

Кафедра радиоэлектронных систем НГТУ

Литература

Прокис Д. Цифровая связь. Пер. с англ. – М: Радио и связь, 2000. 800с.

Скляр Б. Цифровая связь. Теоретические основы и практическое применение. Пер. с англ. М:, Вильямс, 2003. 1104 с.

Ермолаев В.Т., Маврычев Е.А., Флаксман А.Г. Современные методы обработки сигналов в беспроводных системах связи. Учебное пособие. / Нижний Новгород: Изд-во НГТУ им. Р.Е. Алексеева, 2011. – 140 с.

Ермолаев В.Т., Флаксман А.Г. Современные методы пространственной обработки сигналов в радиосистемах с антенными решетками. Учебное пособие. / Нижний Новгород: Изд-во НГТУ им. Р.Е. Алексеева, 2008. - 171 с.

В.Т. Ермолаев, А.А. Мальцев, А.Г. Флаксман, О.В. Болховская, А.В. Клюев. Мобильная связь: вопросы теории и типовые задачи. Учебное пособие. / Нижний Новгород: Изд-во Нижегородского госуниверситета ННГУ им. Н.И. Лобачевского, 2014. 234 с.

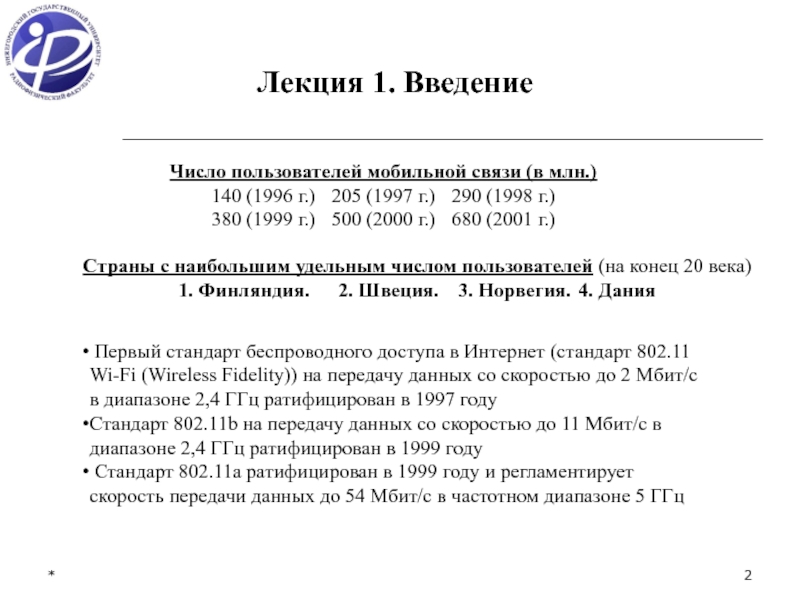

Слайд 2*

Лекция 1. Введение

Число пользователей мобильной связи (в млн.)

140 (1996 г.) 205 (1997

380 (1999 г.) 500 (2000 г.) 680 (2001 г.)

Страны с наибольшим удельным числом пользователей (на конец 20 века)

1. Финляндия. 2. Швеция. 3. Норвегия. 4. Дания

Первый стандарт беспроводного доступа в Интернет (стандарт 802.11 Wi-Fi (Wireless Fidelity)) на передачу данных со скоростью до 2 Мбит/с в диапазоне 2,4 ГГц ратифицирован в 1997 году

Стандарт 802.11b на передачу данных со скоростью до 11 Мбит/с в диапазоне 2,4 ГГц ратифицирован в 1999 году

Стандарт 802.11а ратифицирован в 1999 году и регламентирует скорость передачи данных до 54 Мбит/с в частотном диапазоне 5 ГГц

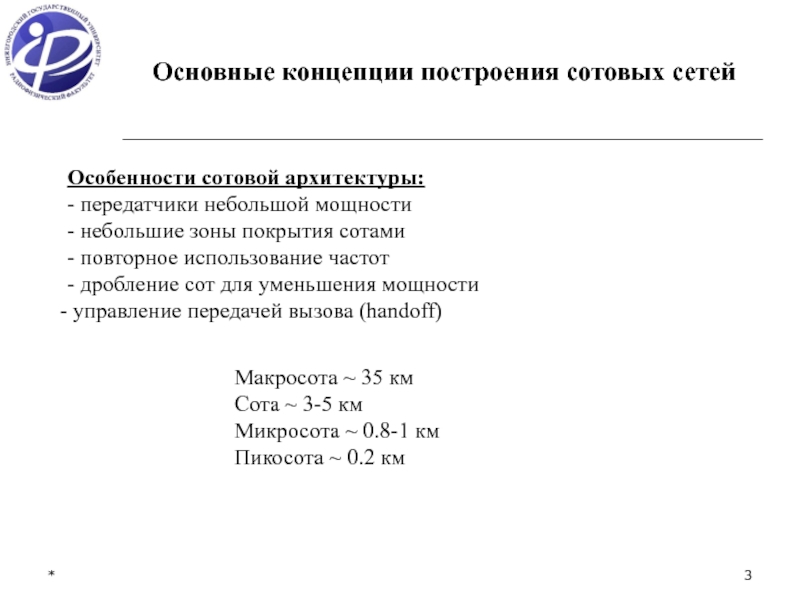

Слайд 3*

Основные концепции построения сотовых сетей

Особенности сотовой архитектуры:

- передатчики небольшой мощности

- небольшие

- повторное использование частот

- дробление сот для уменьшения мощности

управление передачей вызова (handoff)

Макросота ~ 35 км

Сота ~ 3-5 км

Микросота ~ 0.8-1 км

Пикосота ~ 0.2 км

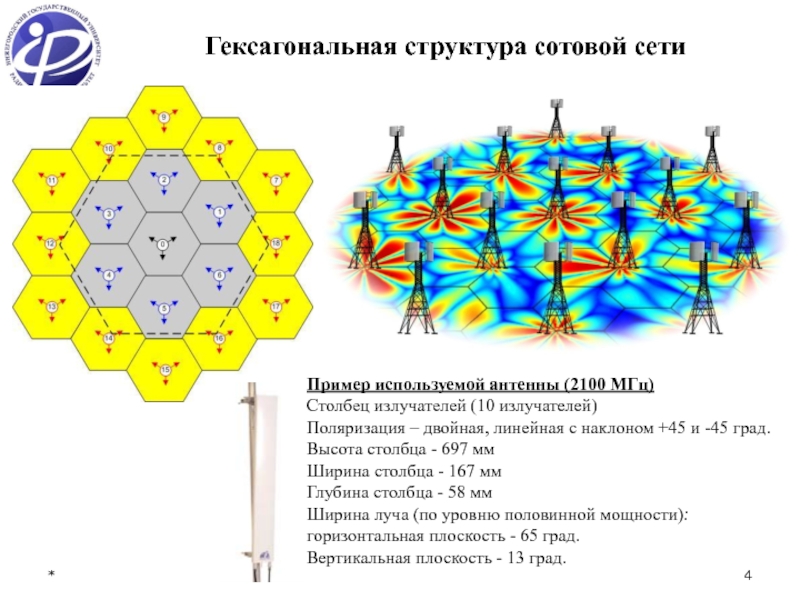

Слайд 4*

Гексагональная структура сотовой сети

Пример используемой антенны (2100 МГц)

Столбец излучателей (10 излучателей)

Поляризация

Высота столбца - 697 мм

Ширина столбца - 167 мм

Глубина столбца - 58 мм

Ширина луча (по уровню половинной мощности):

горизонтальная плоскость - 65 град.

Вертикальная плоскость - 13 град.

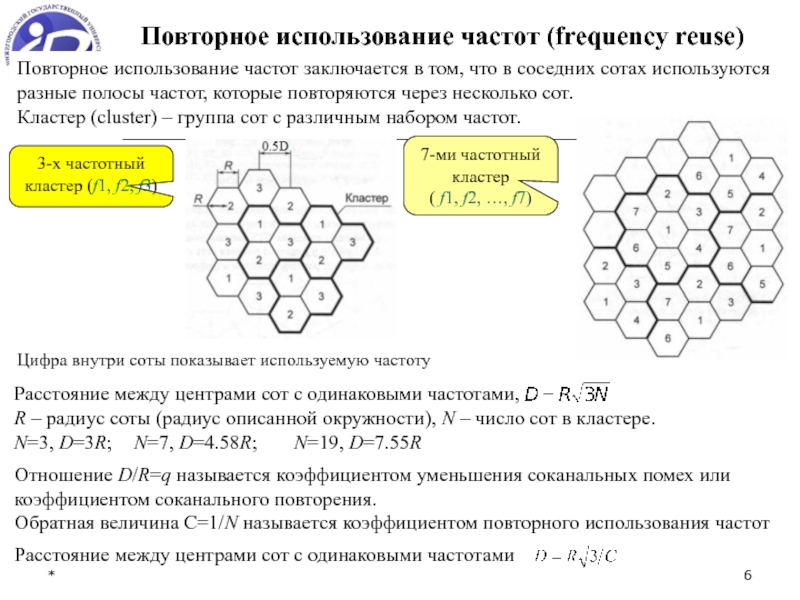

Слайд 6*

Повторное использование частот (frequency reuse)

Цифра внутри соты показывает используемую частоту

3-х частотный

Повторное использование частот заключается в том, что в соседних сотах используются разные полосы частот, которые повторяются через несколько сот.

Кластер (cluster) – группа сот с различным набором частот.

7-ми частотный кластер

( f1, f2, …, f7)

Расстояние между центрами сот с одинаковыми частотами,

R – радиус соты (радиус описанной окружности), N – число сот в кластере.

N=3, D=3R; N=7, D=4.58R; N=19, D=7.55R

Отношение D/R=q называется коэффициентом уменьшения соканальных помех или коэффициентом соканального повторения.

Обратная величина C=1/N называется коэффициентом повторного использования частот

Расстояние между центрами сот с одинаковыми частотами

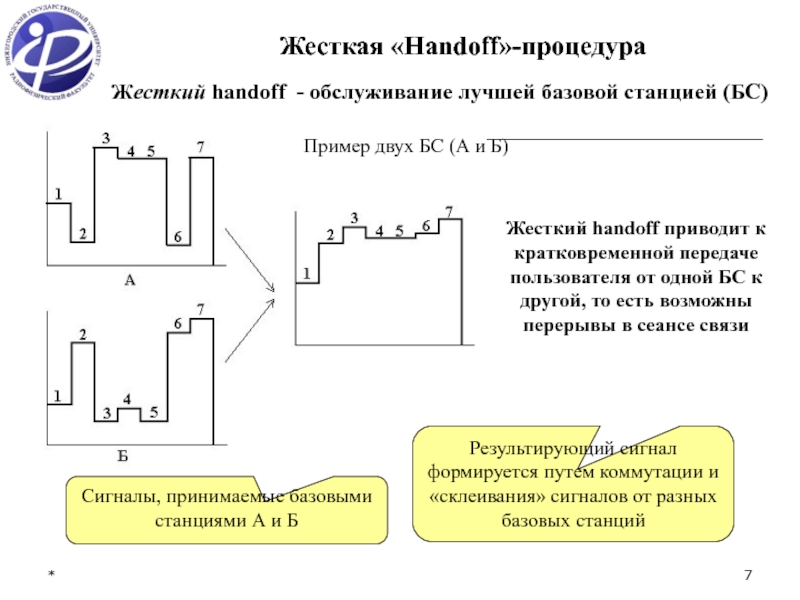

Слайд 7*

Жесткая «Handoff»-процедура

Жесткий handoff - обслуживание лучшей базовой станцией (БС)

Пример двух БС

Результирующий сигнал формируется путем коммутации и «склеивания» сигналов от разных базовых станций

Сигналы, принимаемые базовыми станциями А и Б

Жесткий handoff приводит к кратковременной передаче пользователя от одной БС к другой, то есть возможны перерывы в сеансе связи

Слайд 8*

Мягкий handoff - обслуживание лучшей базовой станцией (БС)

Пример двух БС

Пороговое ОСШ

Пороговое ОСШ (замена обслуживающей БС)

Нет Handoff

Handoff

Сигналы, принимаемые базовыми станциями А и Б

Мягкий handoff уменьшает число передач пользователя от одной БС к другой, то есть число возможных перерывах в сеансе связи

Мягкая «Handoff»-процедура

Слайд 9*

Частотное разделение - FDMA (frequency division multiple access)

Временное разделение -

Кодовое разделение пользователей - CDMA (code division multiple access)

Основные принципы множественного

доступа (разделения) пользователей

Слайд 10*

Частотное разделение пользователей

М – число пользователей;

b – число бит в пакете;

Т

1. Взаимное влияние каналов должно быть минимально возможным;

2. Время ожидания пакета для всех пользователей одинаково;

3. При замираниях в канале некоторые частотные каналы могут быть сильно ослаблены.

Скорость передачи данных R бит/сек (один пользователь).

М – число пользователей (число отдельных полос).

Длительность импульсов увеличивается в M раз, то есть все M пользователей одновременно передают информацию, но с уменьшенной скоростью R/M бит/сек.

Скорость передачи

Слайд 11*

Временное разделение пользователей

М – число пользователей;

b – число бит в пакете;

Т

Время ожидания пакета для всех пользователей различно

Скорость передачи данных R бит/сек (один пользователь).

М – число пользователей (число временных интервалов).

Каждый пользователь использует всю полосу и передает информацию со скоростью R бит/сек (длительность импульсов не изменяется), но за время T/M.

Скорость передачи

Скорость передачи одинакова для частотного и временного разделения

Пакет передается за меньшее время

время

Слайд 12*

Производительность частотного и временного разделения пользователей

Временное разделение является более производительным, если

Время задержки пакета состоит из среднего времени w ожидания пакета и из среднего времени τ передачи пакета

Частотное разделение - пакет передается без задержки

в течение T секунд

Временное разделение - пакет передается с задержкой

в течение T/M секунд.

Время задержки m-го пакета

Среднее время ожидания m-го пакета

Слайд 13*

Понятие о кодовом разделении пользователей

- Разделение пользователей осуществляется за счет модуляции

- Каждому пользователю назначается своя КПШП.

Модулированные импульсы

(сигнал с расширенным спектром)

Передаваемые импульсы dA=1, dB=1, dC= –1, dD= 1

(простой сигнал)

Слайд 14*

Понятие о пространственном разделении пользователей

ДОС

Формирование ортогональных лучей с помощью антенной решетки

MS

MS 2

MS 1

MS 2

Слайд 15*

Замирания сигналов в канале связи

Мощность передатчика

- Фрейм (20 мсек) состоит из

- Эти символы делятся на 16 групп PC (18 символов в группе).

- Длительность группы 1.25 мсек.

- Частота управления мощностью - 800 Гц

- Шаг управления мощностью ±1 дБ

- Управление мощностью основано на оценке ОСШП для каждой группы символов

15 дБ

8 дБ

0 дБ

-5 дБ

Без РС

с РС

Стандарт CDMA (IS-95)

Управление мощностью (power

control - PC) на мобильной станции

Слайд 16*

Лекция 2. Преобразование аналоговой информации в дискретную форму

1. Дискретизация аналогового сигнала

-

Периодический сигнал с периодом T имеет линейчатый спектр

Сигнал представляется рядом Фурье

Докажем, что

периодическая последовательность δ-импульсов имеет линейчатый спектр в виде периодической последовательности δ-компонент

Слайд 17*

Последовательность импульсов

Коэффициенты ряда Фурье

имеет период

Спектр

Доказали

Операция дискретизации.

- дискретный (семплированный)

Так как

то

Слайд 18Процедура дискретизации аналогового сигнала

Спектр дискретного сигнала есть размноженная версия спектра исходного

*

Слайд 19*

Хорошее восстановление сигнала

Так необходимо делать на практике

Частота Найквиста (частота дискретизации, скорость

Плохое восстановление сигнала

Спектр аналогового сигнала

Спектр дискретного сигнала

Передаточная функция восстанавливающего фильтра

Спектр восстановленного сигнала

f N > 2f M

f N = 2f M

f N < 2f M

Слайд 20*

2. Теорема Котельникова

Непрерывный сигнал с ограниченной полосой [−fM÷fM] может быть восстановлен

Δtmax=1/(2fM) - максимальный интервал между временными отсчетами сигнала, определяемый шириной полосы

Доказательство. Сигнал можно восстановить в частотной области, используя идеальный низкочастотный фильтр

Идеальная передающая функция

(см. рисунок на слайде выше)

Идеальная импульсная характеристика

Доказали

Слайд 21*

3. Квантование аналоговых сигналов

Равномерная импульсно-кодовая модуляция (ИКМ)

Каждый отчет квантуется

Динамический диапазон сигнала [−Emax÷Emax].

Размер шага квантования

Амплитудная характеристика 3-битового квантователя

Слайд 22*

Процесс квантования

где e – ошибка квантования, трактуемая как аддитивный шум

Мощность

ошибки квантования

Мощность входного сигнала x при равномерной плотности вероятности на интервале от -Emax до +Emax

ОСШ увеличивается на 6 дБ на каждый разряд АЦП

Пример: 8-разрядный (b=8) АЦП (256 уровней). ОСШ = 48 дБ.

Слайд 23*

При неравномерной плотности вероятности сигнала на интервале от -Emax до +Emax

Пример. Сигнал x занимает часть динамического диапазона квантователя и имеет равномерную плотность вероятности на интервале (a >1)

Мощности сигнала

Пример: a=4. Тогда C=12 дБ.

Слайд 24*

Неравномерная импульсно-кодовая модуляция

В природе более вероятны более слабые сигналы.

Входной сигнал

При восстановлении сигнала используется обратное преобразование, выполняемое с помощью экспандера (расширителя)

Характеристика компрессора y=C(x). Размер шага квантования

Дисперсия ошибки квантования (плотность вероятности p(x) и характеристика компрессора y=C(x) произвольные)

Дисперсия сигнала

.

Устройство неравномерного квантования

Слайд 25*

ОСШ не должно зависеть от функции p(x)

x>0.

Компрессор должен быть

Граничные условия

x<0.

Слайд 26*

μ-закон (Северная Америка)

A-закон (Европа)

Плавное соединение между логарифмической функцией и линейным

Функции логарифмического сжатия

Слайд 27*

Амплитудная характеристика компрессора при μ=1, 15 и 255 (кривые 1, 2,

Амплитудная характеристика μ-компрессора

Амплитудная характеристика A-компрессора

A=87.56 - стандартное значение параметра A.

В стандарте США и Канады при кодировании речи μ=255 при 8-битовом АЦП.

Слайд 28*

Среднее ОСШ для μ-компрессора

μ=255 C=10.1 дБ.

ОСШ уменьшилось на 10.1 дБ.

Слайд 29*

4. Кодирование дискретных источников

Кодовые слова переменной длины (при не равновероятных символах

Должны выполняться два условия:

- требуется минимальное количество кодовых символов (бит) для передачи сообщения;

отсутствуют потери передаваемой информации (однозначное декодирование)

Для выполнения второго условия используются префиксные (мгновенные) коды, в которых начало более длинного кодового слова не совпадает с более коротким кодом.

В этом случае исключается неоднозначность при декодировании.

X множество всевозможных дискретных сообщений x1, x2, …, xn передается по каналу связи с вероятностями p(x1), p(x2), …, p(xn).

Условие непрерывной передачи: p(x1)+p(x2)+ … +p(xn)=1.

Энтропия источника (среднее количество информации при передаче одного символа сообщения)

- при равновероятных символах (p(xi)=1/n),

Кодовые слова фиксированной длины (при равновероятных символах источника)

Каждому из n символов источника ставится в соответствие R бит.

Эффективность кодирования – H/R (H – энтропия)

- n равно целой степени основания 2: число бит на символ источника R=log2(n), H/R=1

n не равно целой степени основания 2: число бит на символ R=⎣log2(n)⎦ +1, H/R<1

Слайд 30*

Пример. Четыре символа источника имеют вероятности (см. табл.) и кодируются, как

Код I (слева) не обеспечивает однозначное декодирование.

Код II (справа) обеспечивает однозначное декодирование

Принятая последовательность 001001 имеет два варианта декодирования (при коде I): a2a4a3 или а2а1а2а1

Слайд 31*

Энтропия источника H(X)=2.11. Средняя длина кодового слова R=2.21.

Эффективность кодирования H(X)/R=95.5%.

Код

Длина кодовой посылки обратно пропорциональна его априорной вероятности

Слайд 33*

Лекции 3-4.

1. Некоторые сведения из теории информации.

1.1. Логарифмическая мера информации.

Передается сообщение

После приема сообщения вероятность (апостериорная) события для получателя равна P2. Прирост количества информации

Идеальный канал связи без помех и искажений сигналов (P2=1)

Чем меньше вероятность P1 (больше неопределенность) события, тем большая информация о нем получается в результате приема сообщения. Если в качестве основания логарифма выбрать 2, то единицей измерения информации является бит.

1.2. Количество информации в дискретных сообщениях.

Найдем информационное содержание сообщения, состоящего из n символов, при алфавите, насчитывающем L символов S1, S2,…, SL.

Сколько различных последовательностей из n символов можно составить при заданном алфавите из L различных символов? Рассмотрим частные случаи:

n=1 (одно сообщение содержит один символ) число возможных сообщений равно L;

Слайд 34*

при произвольном n число возможных сообщений

Символы сообщения равновероятны. Количество информации

Энтропия случайной величины (или сообщения)

Два свойства сообщений при равновероятных и независимых символах:

а) количество информации в сообщении пропорционально полному числу n символов и логарифму от числа L различных символов в алфавите;

б) средняя информация, приходящаяся на один символ, зависит только от числа различных символов в алфавите.

Символы сообщения не равновероятны. Энтропия случайной величины (или сообщения)

n=2 (одно сообщение содержит два символа) число возможных сообщений равно L×L и возможные сообщения образуют следующую совокупность:

Слайд 35*

Два фактора уменьшают энтропию:

а) неравные вероятности символов в сообщении;

б) наличие связей

Пример. Источник сообщений выдает два независимых символа: 0 с вероятностью q и 1 с вероятностью (1-q). Энтропия

Передаваемые сообщения обладают избыточностью и число символов в сообщении больше, чем это требуется при их независимости и равномерном использовании. Поэтому фактическая энтропия H меньше максимальной Hmax. Избыточность

Слайд 36*

2. Дискретный сигнал с различными амплитудами.

L - число возможных уровней амплитуды

Количество информации в сигнале

Информационная емкость сигнала

1.3. Информационная емкость дискретного сигнала

Двоичный сигнал (-1, +1). Энтропия - 1 бит/символ.

τи - длительность импульса. T=nτи - длительность сообщения.

Количество информации n бит.

Полоса частот w≈1/τи.

Количество информации в сигнале

Информационная емкость сигнала

.

Информационная емкость двоичного сигнала равна полосе частот сигнала

Информационная емкость является предельной скоростью передачи информации

Слайд 37*

1.4. Информационная емкость непрерывного сигнала

T - длительность сигнала. w=Fmax-Fmin –

1/(2Fmax) – расстояние между выборками (теорема Котельникова).

Число выборок сигнала

Pс – мощность сигнала, - СКО шума

Число L различимых уровней (приблизительно)

Число L можно рассматривать как число различных символов алфавита, а N – как общее число символов в сообщении

Полная информация в непрерывном сообщении

Информационная емкость сигнала (предельная скорость безошибочной передачи информации) при условии

Точное выражение (несмотря на приблизительное определение L)

Слайд 38*

1.5. Энтропия случайной непрерывной величины.

p(x) - плотность вероятности.

p(xi)Δxi - вероятность попадания

i-ое дискретное сообщение - попадание x в этот интервал.

Энтропия непрерывного распределения

Пусть Δxi=Δx. Второе слагаемое

Не зависит от плотности вероятности

Дифференциальная энтропия

Слайд 39*

Примеры.

1. Гармоническое колебание со случайной фазой ϕ, равномерно распределенной на интервале

Средняя мощность сигнала

Энтропия

2. Случайный процесс с нулевым средним и амплитудой, равномерно распределенной на интервале [−A0÷A0].

Плотность вероятности

Энтропия

3. Гауссов случайный процесс с нулевым средним и дисперсией (мощностью) P0.

Энтропия

Слайд 40*

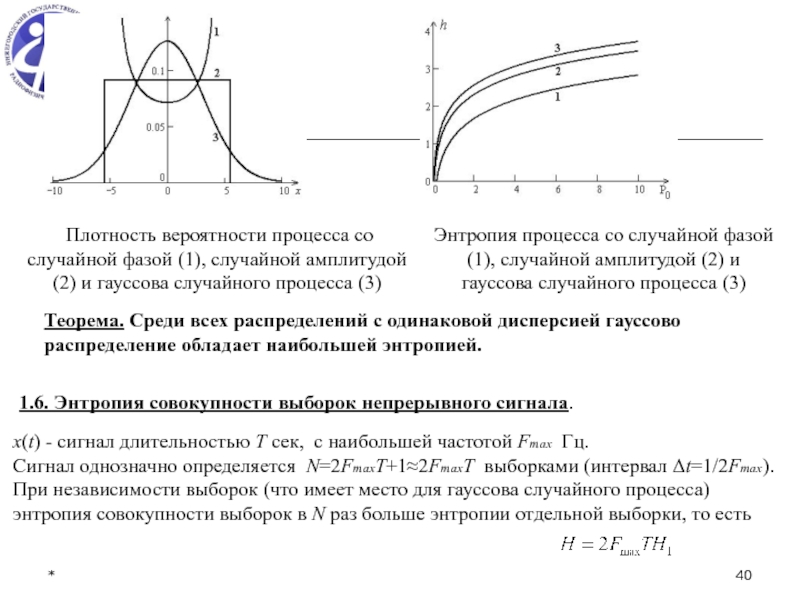

Плотность вероятности процесса со случайной фазой (1), случайной амплитудой (2)

Энтропия процесса со случайной фазой (1), случайной амплитудой (2) и гауссова случайного процесса (3)

Теорема. Среди всех распределений с одинаковой дисперсией гауссово распределение обладает наибольшей энтропией.

1.6. Энтропия совокупности выборок непрерывного сигнала.

x(t) - сигнал длительностью T сек, с наибольшей частотой Fmax Гц.

Сигнал однозначно определяется N=2FmaxT+1≈2FmaxT выборками (интервал Δt=1/2Fmax).

При независимости выборок (что имеет место для гауссова случайного процесса) энтропия совокупности выборок в N раз больше энтропии отдельной выборки, то есть

Слайд 41*

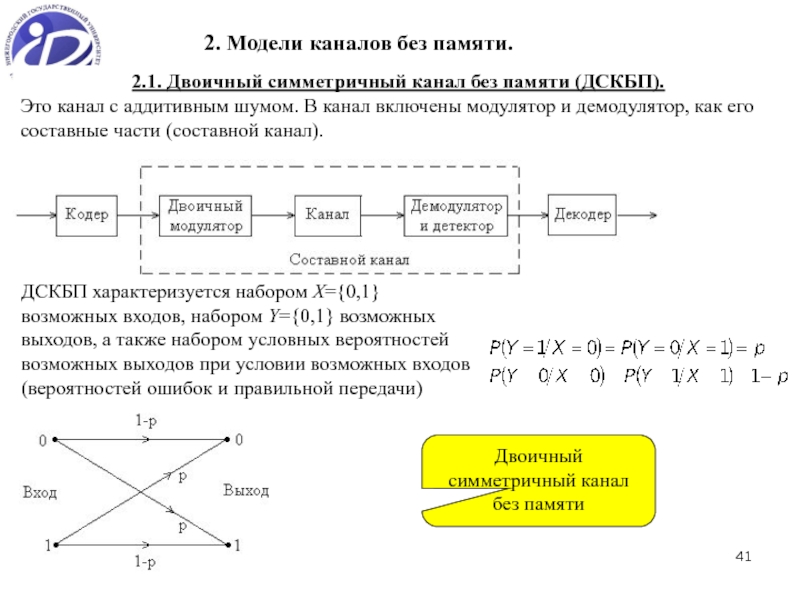

2. Модели каналов без памяти.

2.1. Двоичный симметричный канал без памяти

Это канал с аддитивным шумом. В канал включены модулятор и демодулятор, как его составные части (составной канал).

ДСКБП характеризуется набором X={0,1} возможных входов, набором Y={0,1} возможных выходов, а также набором условных вероятностей возможных выходов при условии возможных входов (вероятностей ошибок и правильной передачи)

Двоичный симметричный канал без памяти

Слайд 42*

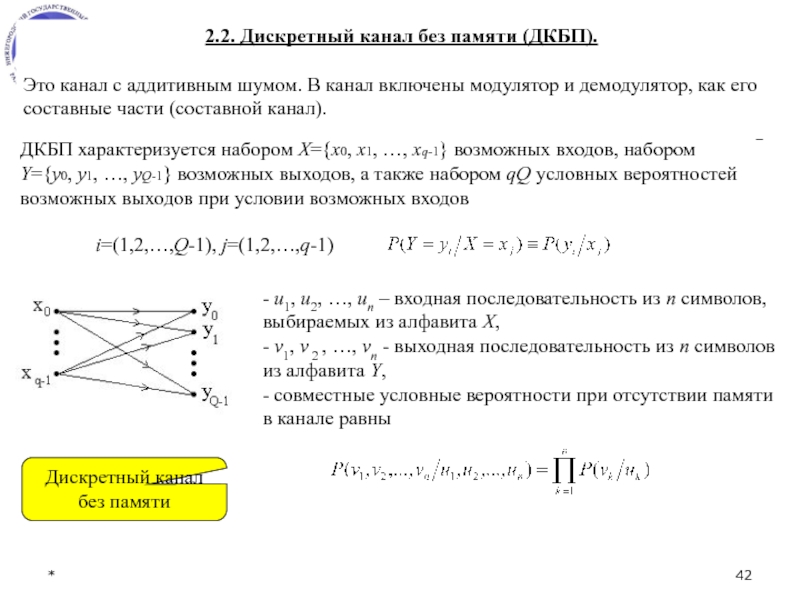

2.2. Дискретный канал без памяти (ДКБП).

Это канал с аддитивным шумом. В

ДКБП характеризуется набором X={x0, x1, …, xq-1} возможных входов, набором Y={y0, y1, …, yQ-1} возможных выходов, а также набором qQ условных вероятностей возможных выходов при условии возможных входов

Дискретный канал без памяти

i=(1,2,…,Q-1), j=(1,2,…,q-1)

- u1, u2, …, un – входная последовательность из n символов, выбираемых из алфавита X,

- v1, v 2 , …, vn - выходная последовательность из n символов из алфавита Y,

- совместные условные вероятности при отсутствии памяти в канале равны

Слайд 43*

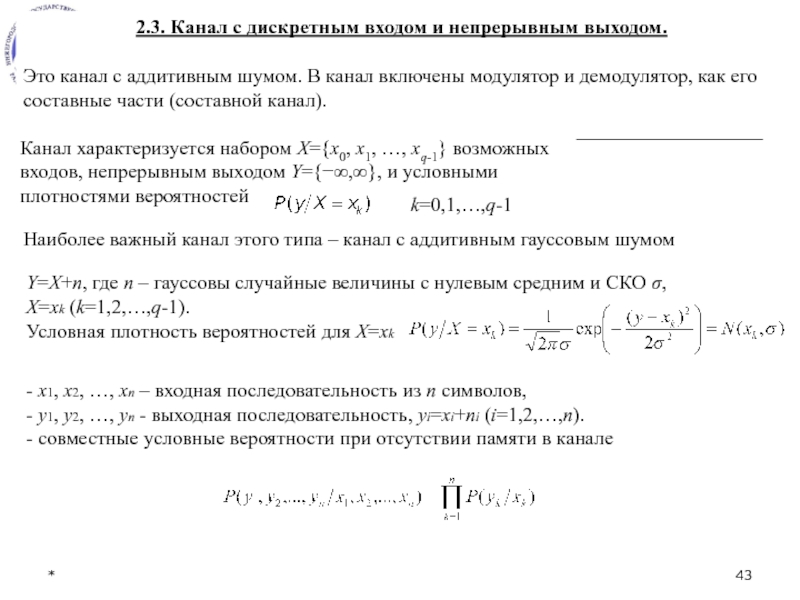

2.3. Канал с дискретным входом и непрерывным выходом.

Это канал с аддитивным

Канал характеризуется набором X={x0, x1, …, xq-1} возможных входов, непрерывным выходом Y={−∞,∞}, и условными плотностями вероятностей

k=0,1,…,q-1

Наиболее важный канал этого типа – канал с аддитивным гауссовым шумом

Y=X+n, где n – гауссовы случайные величины с нулевым средним и СКО σ, X=xk (k=1,2,…,q-1).

Условная плотность вероятностей для X=xk

- x1, x2, …, xn – входная последовательность из n символов,

- y1, y2, …, yn - выходная последовательность, yi=xi+ni (i=1,2,…,n).

- совместные условные вероятности при отсутствии памяти в канале

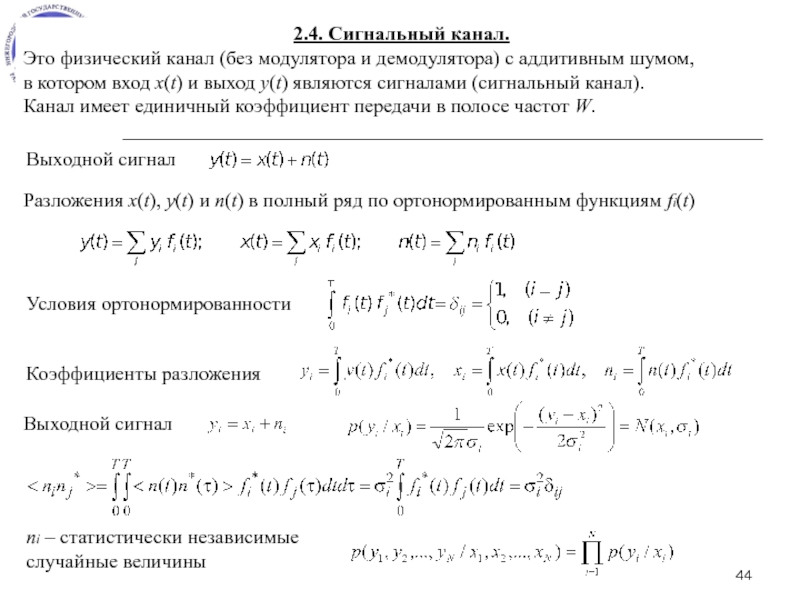

Слайд 44*

2.4. Сигнальный канал.

Это физический канал (без модулятора и демодулятора) с аддитивным

в котором вход x(t) и выход y(t) являются сигналами (сигнальный канал).

Канал имеет единичный коэффициент передачи в полосе частот W.

Разложения x(t), y(t) и n(t) в полный ряд по ортонормированным функциям fi(t)

Условия ортонормированности

Выходной сигнал

Коэффициенты разложения

Выходной сигнал

ni – статистически независимые случайные величины

Слайд 45*

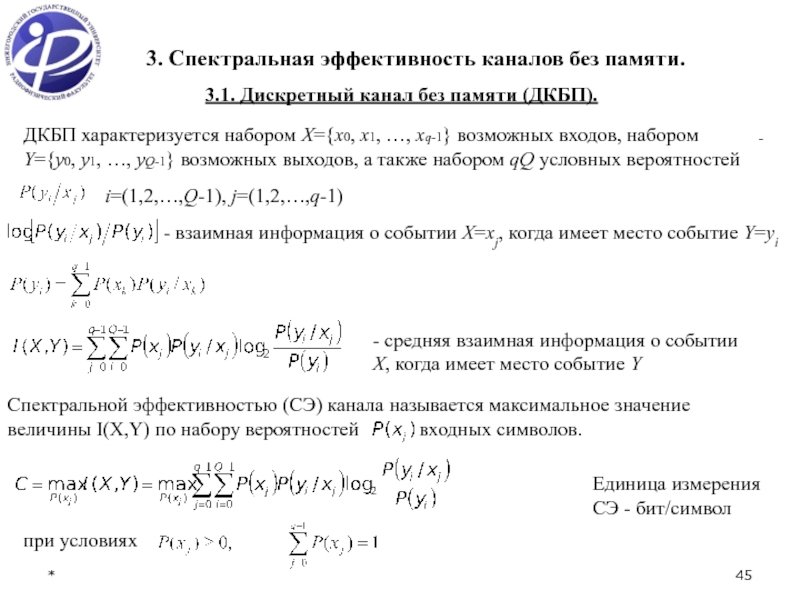

3.1. Дискретный канал без памяти (ДКБП).

ДКБП характеризуется набором X={x0, x1, …,

i=(1,2,…,Q-1), j=(1,2,…,q-1)

- взаимная информация о событии X=xj, когда имеет место событие Y=yi

- средняя взаимная информация о событии X, когда имеет место событие Y

Спектральной эффективностью (СЭ) канала называется максимальное значение величины I(X,Y) по набору вероятностей входных символов.

при условиях

Единица измерения СЭ - бит/символ

3. Спектральная эффективность каналов без памяти.

Слайд 46*

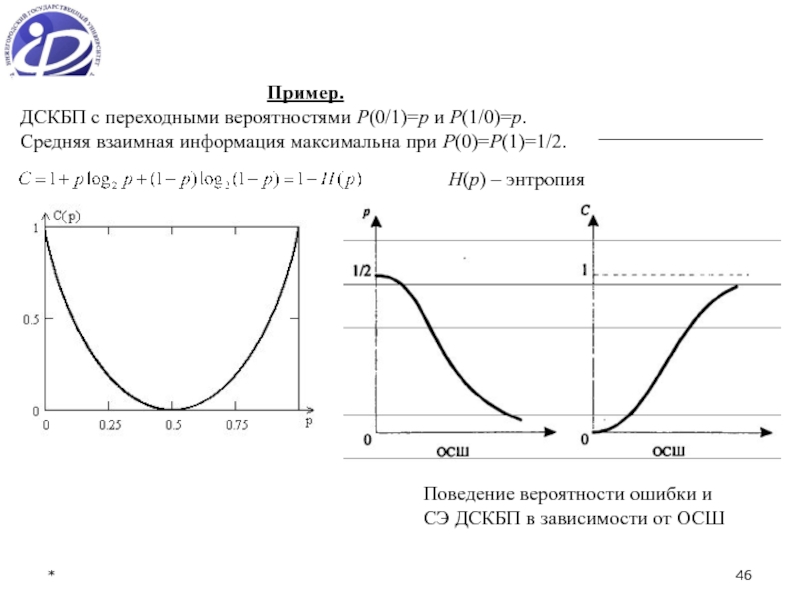

Пример.

ДСКБП с переходными вероятностями P(0/1)=p и P(1/0)=p.

Средняя взаимная информация максимальна при

H(p) – энтропия

Поведение вероятности ошибки и СЭ ДСКБП в зависимости от ОСШ

Слайд 47*

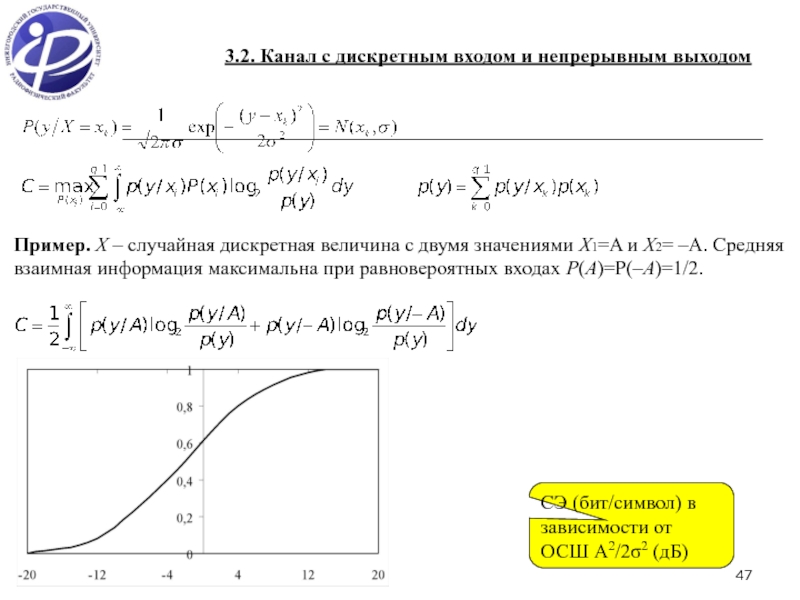

3.2. Канал с дискретным входом и непрерывным выходом

Пример. X – случайная

СЭ (бит/символ) в зависимости от ОСШ A2/2σ2 (дБ)

Слайд 48*

3.3. Ограниченный по полосе частот канал с аддитивным шумом и дискретным

СЭ такого канала в единицу времени (Шеннон, 1948 год)

Средняя взаимная информация между X и Y

Непрерывные функции y(t), x(t) и n(t) заменяем их выборками {yi}, {xi} и {ni}, взятыми через интервалы времени Δt=1/2W (теорема отсчетов).

Затем находим среднюю взаимную информацию между векторами XN ={x1, …, xN} и YN ={y1, …, yN} размерности N=2WT. Имеем

Выборки шума статистически независимыми между собой. Средняя взаимная информация между XN и YN равна сумме средних взаимных информаций между отдельными выборками

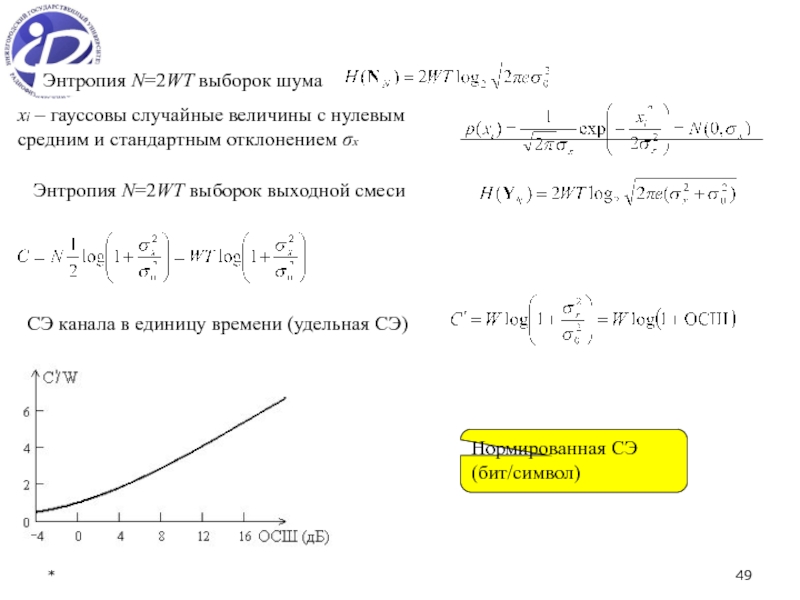

Слайд 49*

СЭ канала в единицу времени (удельная СЭ)

Энтропия N=2WT выборок шума

xi

Нормированная СЭ (бит/символ)

Энтропия N=2WT выборок выходной смеси

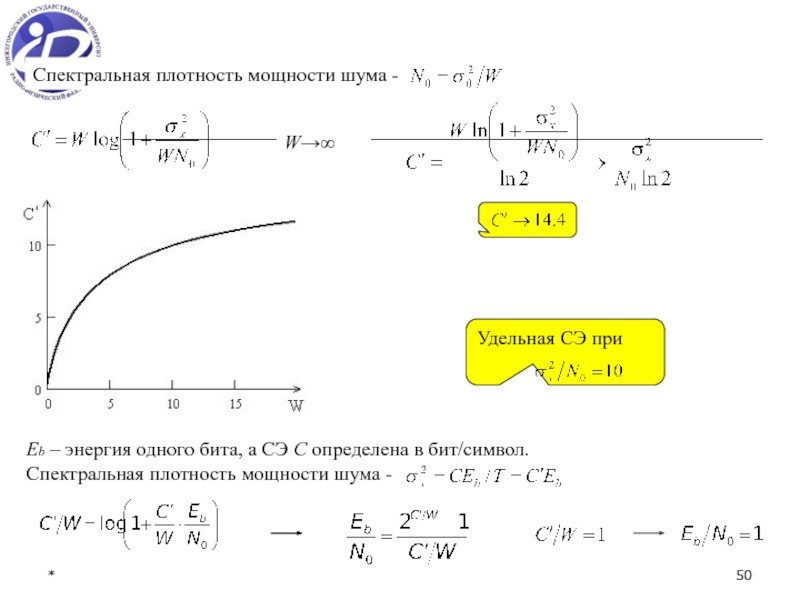

Слайд 50*

Спектральная плотность мощности шума -

W→∞

Удельная СЭ при

Eb – энергия одного

Спектральная плотность мощности шума -

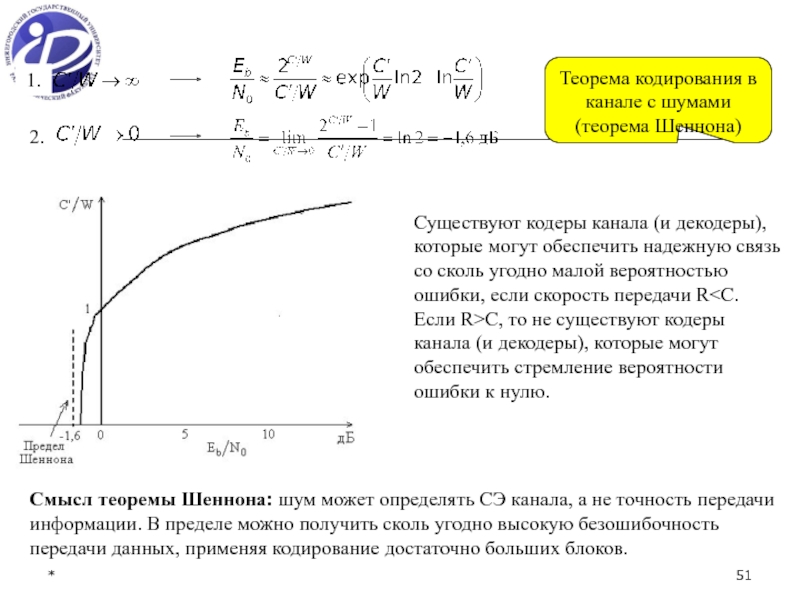

Слайд 51*

1.

2.

Существуют кодеры канала (и декодеры), которые могут обеспечить надежную

Теорема кодирования в канале с шумами (теорема Шеннона)

Смысл теоремы Шеннона: шум может определять СЭ канала, а не точность передачи информации. В пределе можно получить сколь угодно высокую безошибочность передачи данных, применяя кодирование достаточно больших блоков.

Слайд 52*

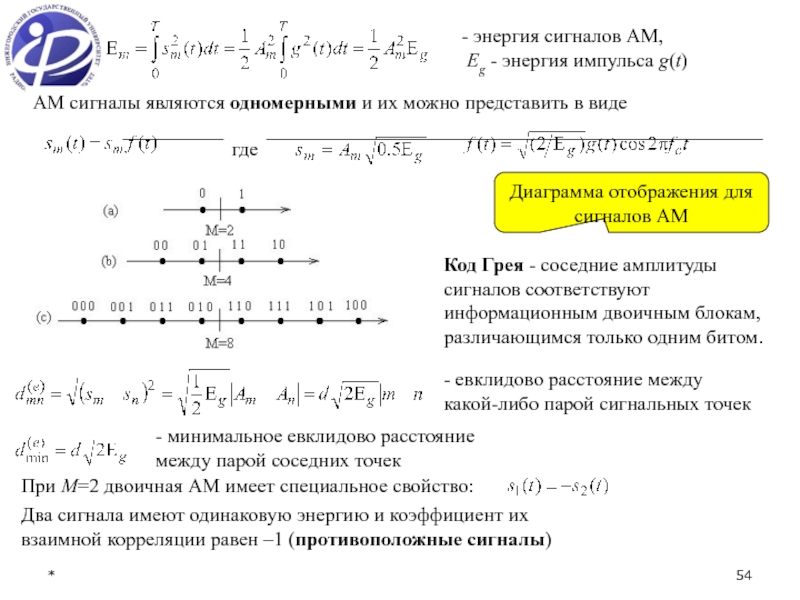

1. Цифровой модулятор преобразует битовую последовательность в последовательность узкополосных электрических сигналов,

2. Модуляция M-го порядка. Если последовательность {an} из b бит преобразуется в сигнал, то модулятор должен иметь возможность вырабатывать M=2b детерминированных сигналов {sm(t), m=1,2,…,M}, так как число возможных двоичных последовательностей, которые можно получить из b бит, равно 2b.

3. Если двоичную последовательность необходимо передавать со скоростью R бит/сек, то она входит в модулятор за время b/R секунд, т.е. длительность сигналов должна составлять b/R секунд, а символьная скорость равна R/b символов в секунду.

4. Когда отображение цифровой последовательности {an} в сигнал осуществляется так, что сигнал, передаваемый на данном временном интервале, зависит от одного или более сигналов, переданных раньше, то говорят, что модулятор имеет память.

5. Если отображение цифровой последовательности {an} в сигналы {sm(t)},

осуществляется так, что передаваемые сигналы не зависят от ранее переданных сигналов, то модулятор называют модулятором без памяти.

Лекция 5.

Модуляции, используемые в системах цифровой связи

Слайд 53*

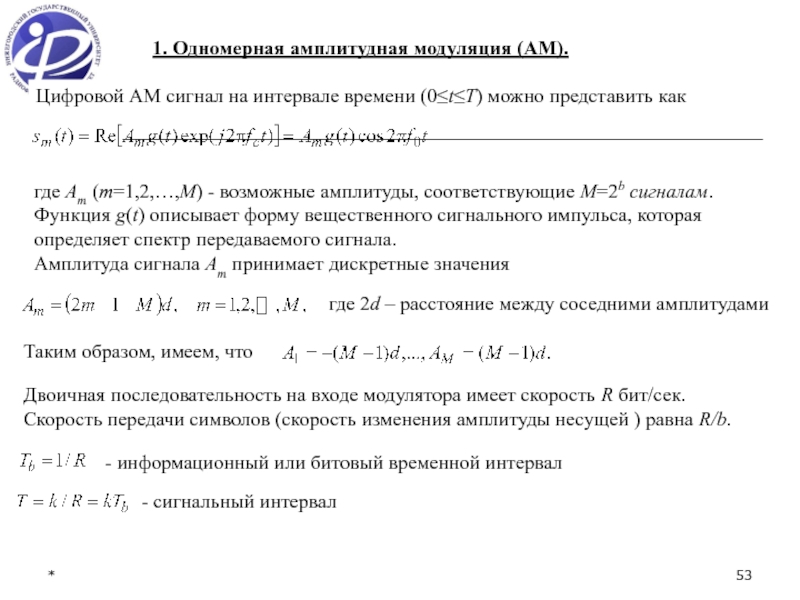

Цифровой АМ сигнал на интервале времени (0≤t≤T) можно представить как

1. Одномерная

где Am (m=1,2,…,M) - возможные амплитуды, соответствующие M=2b сигналам.

Функция g(t) описывает форму вещественного сигнального импульса, которая определяет спектр передаваемого сигнала.

Амплитуда сигнала Am принимает дискретные значения

Таким образом, имеем, что

где 2d – расстояние между соседними амплитудами

Двоичная последовательность на входе модулятора имеет скорость R бит/сек.

Скорость передачи символов (скорость изменения амплитуды несущей ) равна R/b.

- сигнальный интервал

- информационный или битовый временной интервал

Слайд 54*

- энергия сигналов АМ,

Eg - энергия импульса g(t)

АМ сигналы являются

где

Диаграмма отображения для сигналов АМ

Код Грея - соседние амплитуды сигналов соответствуют информационным двоичным блокам, различающимся только одним битом.

- евклидово расстояние между какой-либо парой сигнальных точек

- минимальное евклидово расстояние между парой соседних точек

При M=2 двоичная АМ имеет специальное свойство:

Два сигнала имеют одинаковую энергию и коэффициент их взаимной корреляции равен –1 (противоположные сигналы)

Слайд 55*

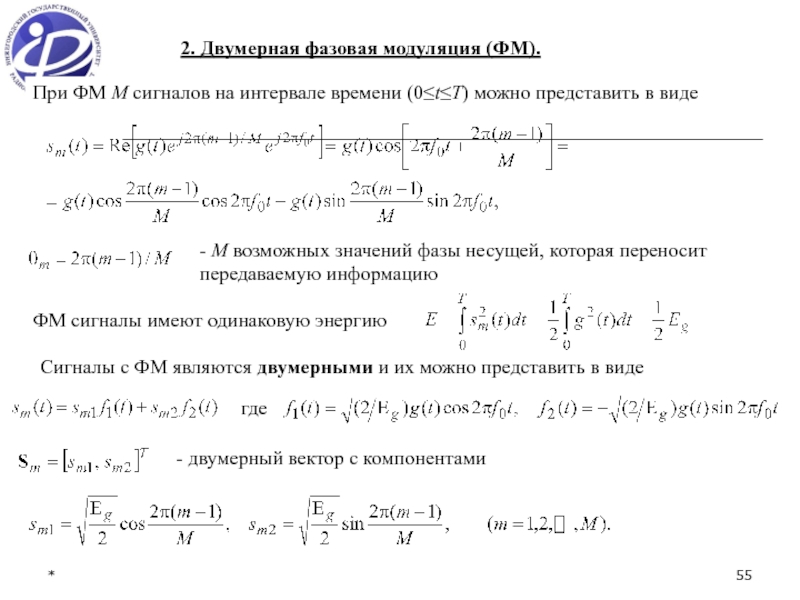

При ФМ M сигналов на интервале времени (0≤t≤T) можно представить в

2. Двумерная фазовая модуляция (ФМ).

- M возможных значений фазы несущей, которая переносит передаваемую информацию

ФМ сигналы имеют одинаковую энергию

Сигналы с ФМ являются двумерными и их можно представить в виде

где

- двумерный вектор с компонентами

Слайд 56*

Диаграмма отображения для сигналов ФМ

- евклидово расстояние между какой-либо парой сигнальных

- минимальное евклидово расстояние между парой соседних точек

Слайд 57*

Одновременная передача двух отдельных b-битовых информационных блоков на двух несущих, находящихся

Два представления сигналов КАМ на интервале времени (0≤t≤T)

3. Двумерная квадратурная амплитудная модуляция (КАМ)

где Amc и Ams – информационные амплитуды для квадратурных несущих

Сигнал КАМ можно рассматривать как комбинацию АМ и ФМ.

Можно образовать определенную комбинацию М1-уровневой АМ и М2-позиционной ФМ

В результате получается сигнальное созвездие комбинированной АМ-ФМ, содержащее М=М1×М2 точек пространства сигналов.

Если М1=2n и М2=2m, то сигнальное созвездие позволяет передавать m+n=logM1M2 двоичных символов со скоростью R/(m+n).

Слайд 58*

Диаграммы отображения для сигналов КАМ при M=8 и M=16

Сигналы КАМ являются

где

- двумерный вектор

- евклидово расстояние между произвольной парой сигнальных векторов (сигнальных точек)

Слайд 59*

Наиболее интересен случай, когда амплитуды квадратурных сигналов принимают дискретные значения

Диаграмма

Диаграммы отображения для сигналов КАМ при разных M

- минимальное евклидово расстояние между парой соседних точек

Слайд 60*

Двумерные 4-ФМ, 16-КАМ и 64-КАМ сигналы имеют вид

нормирующий множитель (выбирается

4-ФМ сигналы: I= ±1; Q=±1

16-КАМ сигналы: I= ±1, ±3; Q=±1, ±3

2-ФМ сигналы: I= ±1; Q=0.

k=1

64-КАМ сигналы: I= ±1, ±3, ±5, ±7; Q=±1, ±3, ±5, ±7

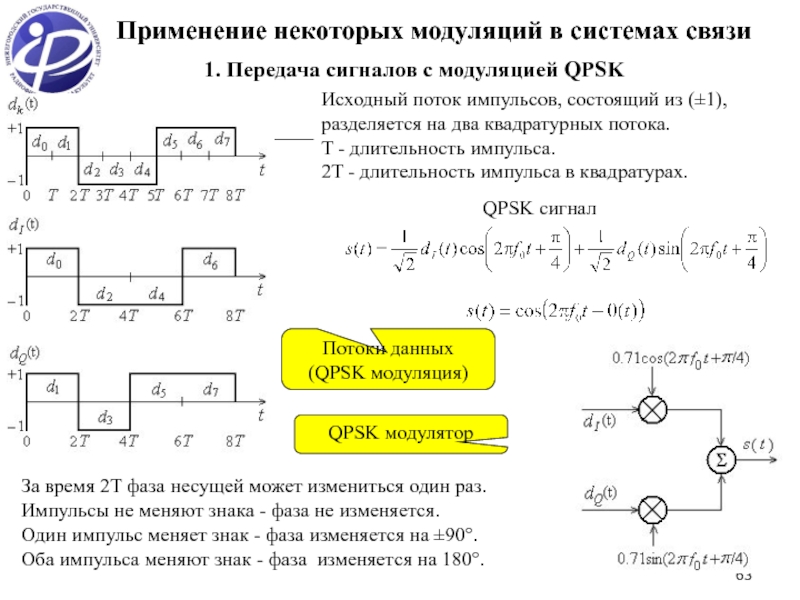

Слайд 63Применение некоторых модуляций в системах связи

1. Передача сигналов с модуляцией

Исходный поток импульсов, состоящий из (±1), разделяется на два квадратурных потока.

T - длительность импульса.

2T - длительность импульса в квадратурах.

QPSK сигнал

За время 2T фаза несущей может измениться один раз.

Импульсы не меняют знака - фаза не изменяется.

Один импульс меняет знак - фаза изменяется на ±90°.

Оба импульса меняют знак - фаза изменяется на 180°.

Потоки данных (QPSK модуляция)

QPSK модулятор

Слайд 642. Передача сигналов с модуляцией OQPSK (Offset QPSK)

Потоки данных (OQPSK

В QPSK потоки импульсов dI(t) и dQ(t) синхронизированы так, что их переходы совпадают по времени (см. предыдущий слайд).

В OQPSK эти потоки синхронизированы со сдвигом на T. Поэтому фаза несущей не может измениться на 180°. За каждые T секунд фаза может измениться только на 0° или ±90°.

QPSK и OQPSK сигналы

Потоки данных (OQPSK модуляция)

Слайд 653. Манипуляция с минимальным частотным сдвигом (ММС)

ММС - разновидность OQPSK

Формирование сигнала ММС

1. Сигнал s(t) имеет постоянную составляющую

2. Фаза несущей непрерывна при изменении значений dI(t) и dQ(t)

3. Сигнал s(t) - частотно манипулированный сигнал с частотами передачи

4. Разнесение между частотами -

Слайд 66Нормированная спектральная плотность мощности ММС сигнала

Нормированная спектральная плотность мощности QPSK

Спектральная плотность мощности QPSK или OQPSK сигнала и ММС сигнала (пунктир)

Боковые максимумы для ММС сигнала значительно ниже, чем для QPSK или OQPSK сигналов

Слайд 67На интервале одного символа фаза несущей частоты изменяется на 90 град.

Амплитуда изменяется только при передаче 1.

Это - дифференциальное кодирование.

4. Гауссова частотная манипуляция с минимальным частотным сдвигом (GMSK - Gaussian Minimum Shift Keying) -

{ak} – входная двоичная информационная последовательность кодера,

{bk} – выходная последовательность кодера, ⊕ - суммирование по модулю 2.

bk=1, передаваемый сигнал – положительный прямоугольный импульс,

bk=0, передаваемый сигнал – это отрицательный прямоугольный импульс.

Операция дифференциального кодирования вводит память в сигнал.

Слайд 68ИХ гауссова фильтра нижних частот

GMSK модулятор

BT - безразмерная величина,

B -

T - длительность импульса

BT=0.3 (GSM стандарт)

Диаграмма состояний кодера и модулятора

Решетчатая диаграмма кодера и модулятора

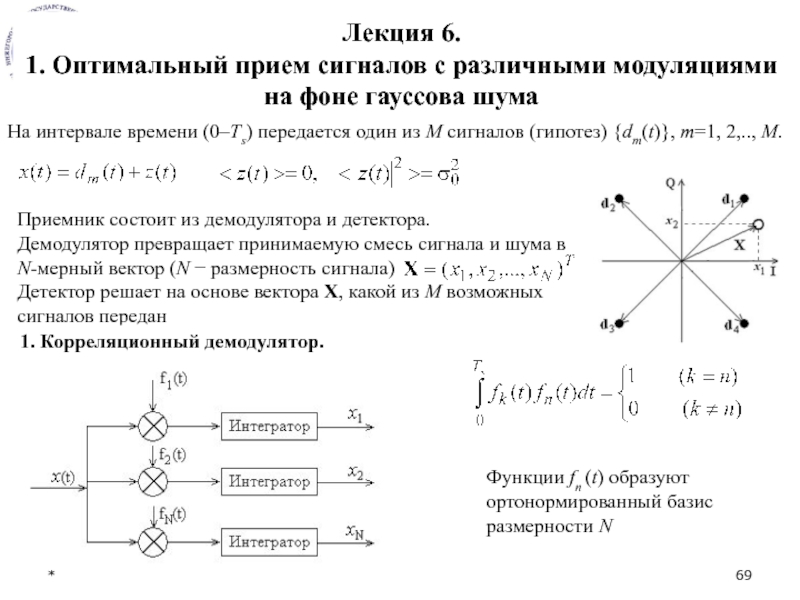

Слайд 69*

Лекция 6.

1. Оптимальный прием сигналов с различными модуляциями на фоне гауссова

На интервале времени (0–Ts) передается один из M сигналов (гипотез) {dm(t)}, m=1, 2,.., M.

Функции fn (t) образуют ортонормированный базис размерности N

Приемник состоит из демодулятора и детектора.

Демодулятор превращает принимаемую смесь сигнала и шума в N-мерный вектор (N − размерность сигнала)

Детектор решает на основе вектора X, какой из M возможных сигналов передан

1. Корреляционный демодулятор.

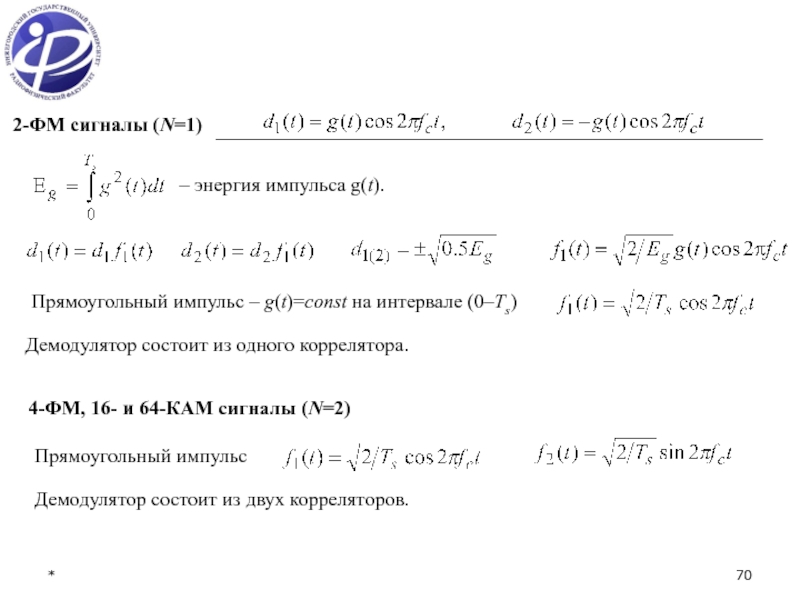

Слайд 70*

2-ФМ сигналы (N=1)

– энергия импульса g(t).

Прямоугольный импульс – g(t)=const

4-ФМ-сигналы (N=2)

Демодулятор состоит из одного коррелятора.

Демодулятор состоит из двух корреляторов.

Прямоугольный импульс

4-ФМ, 16- и 64-КАМ сигналы (N=2)

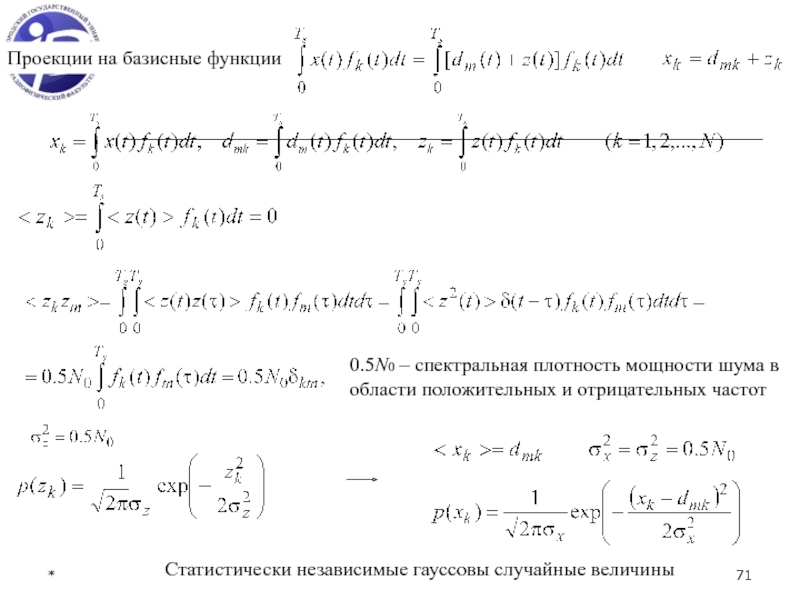

Слайд 71*

Проекции на базисные функции

0.5N0 – спектральная плотность мощности шума в

Статистически независимые гауссовы случайные величины

Слайд 72*

m=1,2, …, M

2. Согласованный фильтр (СФ) как демодулятор.

ИХ k-го согласованного

Слайд 73*

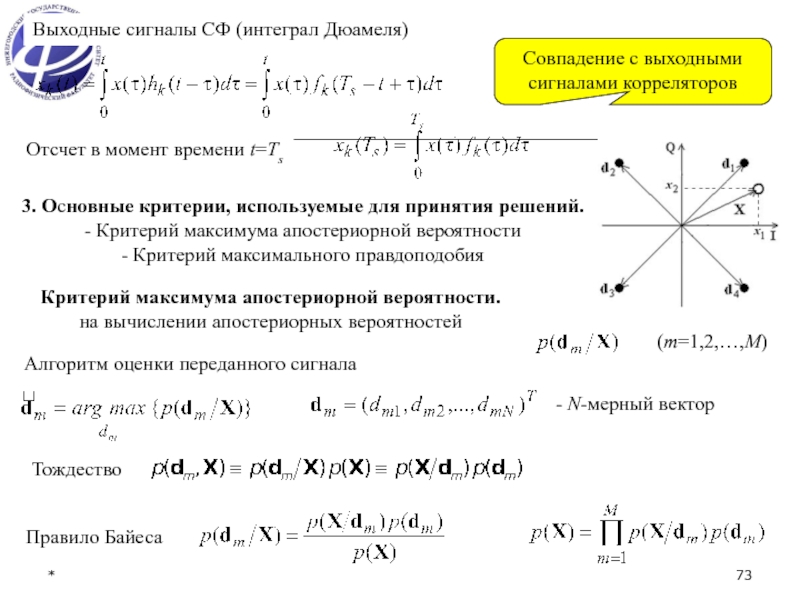

Отсчет в момент времени t=Ts

Выходные сигналы СФ (интеграл Дюамеля)

Совпадение с

3. Основные критерии, используемые для принятия решений.

- Критерий максимума апостериорной вероятности

- Критерий максимального правдоподобия

Критерий максимума апостериорной вероятности.

на вычислении апостериорных вероятностей

(m=1,2,…,M)

Алгоритм оценки переданного сигнала

- N-мерный вектор

Правило Байеса

Тождество

Слайд 74*

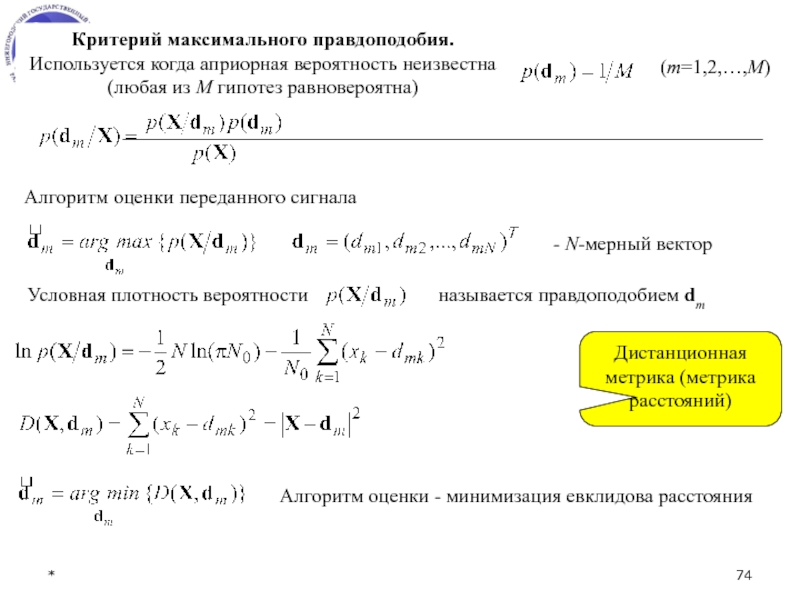

Критерий максимального правдоподобия.

Используется когда априорная вероятность неизвестна (любая из M гипотез

(m=1,2,…,M)

Алгоритм оценки переданного сигнала

- N-мерный вектор

Условная плотность вероятности

называется правдоподобием dm

Алгоритм оценки - минимизация евклидова расстояния

Дистанционная метрика (метрика расстояний)

Слайд 75*

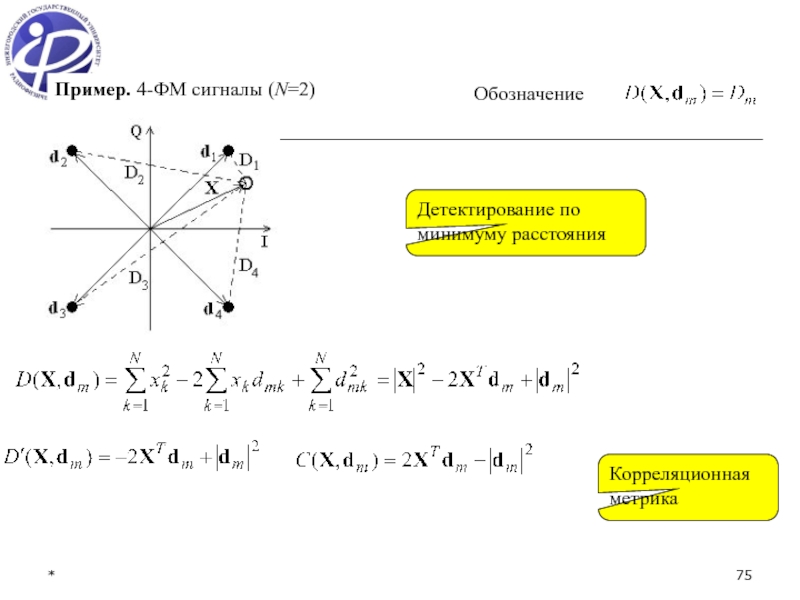

Пример. 4-ФМ сигналы (N=2)

Обозначение

Детектирование по минимуму расстояния

Корреляционная метрика

Слайд 77*

2. Вероятность битовой и символьной ошибки

1. 2-ФМ сигналы.

Функции правдоподобия

Критерий

Правило принятия решения:

x>0 – передан сигнал d1(t),

x<0 – передан сигнал d2(t)

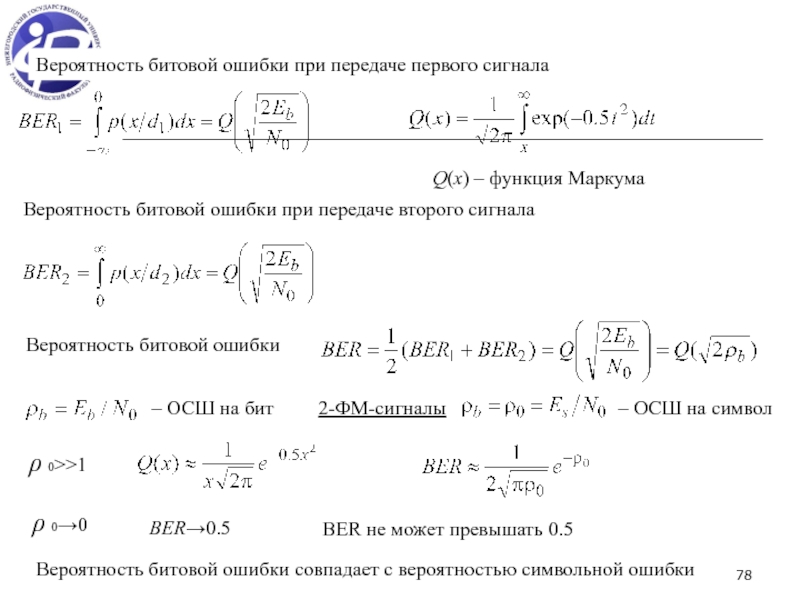

Слайд 78*

Вероятность битовой ошибки при передаче первого сигнала

Q(x) – функция Маркума

Вероятность битовой ошибки при передаче второго сигнала

Вероятность битовой ошибки

– ОСШ на бит

2-ФМ-сигналы

– ОСШ на символ

ρ 0>>1

ρ 0→0

BER→0.5

BER не может превышать 0.5

Вероятность битовой ошибки совпадает с вероятностью символьной ошибки

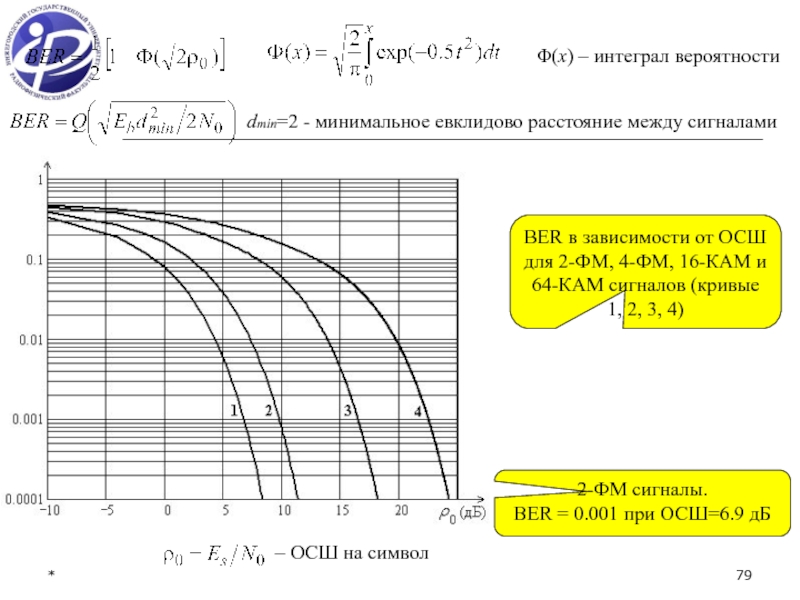

Слайд 79*

Φ(x) – интеграл вероятности

dmin=2 - минимальное евклидово расстояние между сигналами

BER

2-ФМ сигналы.

BER = 0.001 при ОСШ=6.9 дБ

– ОСШ на символ

Слайд 80*

2. 4-ФМ сигналы.

4-ФМ (kb=2) реализуется с помощью одновременной передачи

В каждой квадратуре - половина мощности (0.5P0).

Скорость передачи исходного потока – Rb.

Скорость передачи в каждой квадратуре - 0.5Rb.

ОСШ на бит в каждом квадратурном канале такое же, как для 2-ФМ сигналов.

BER в зависимости от отношения Eb/N0 одинаково для 2-ФМ и 4-ФМ сигналов.

- минимальное евклидово расстояние между 4-ФМ сигналами

4-ФМ модулятор

ОСШ на бит

Связь ОСШ с ОСШ на бит

Слайд 81*

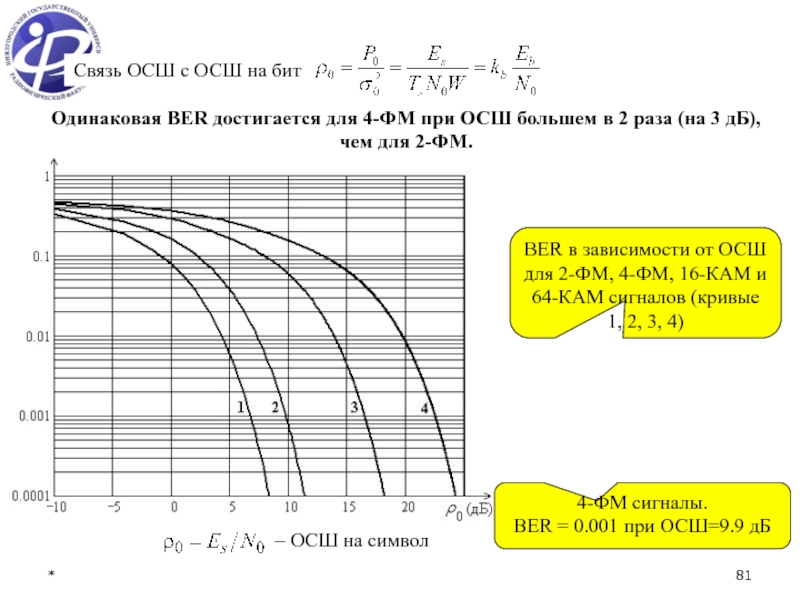

BER в зависимости от ОСШ для 2-ФМ, 4-ФМ, 16-КАМ и 64-КАМ

4-ФМ сигналы.

BER = 0.001 при ОСШ=9.9 дБ

Связь ОСШ с ОСШ на бит

Одинаковая BER достигается для 4-ФМ при ОСШ большем в 2 раза (на 3 дБ), чем для 2-ФМ.

– ОСШ на символ

Слайд 82*

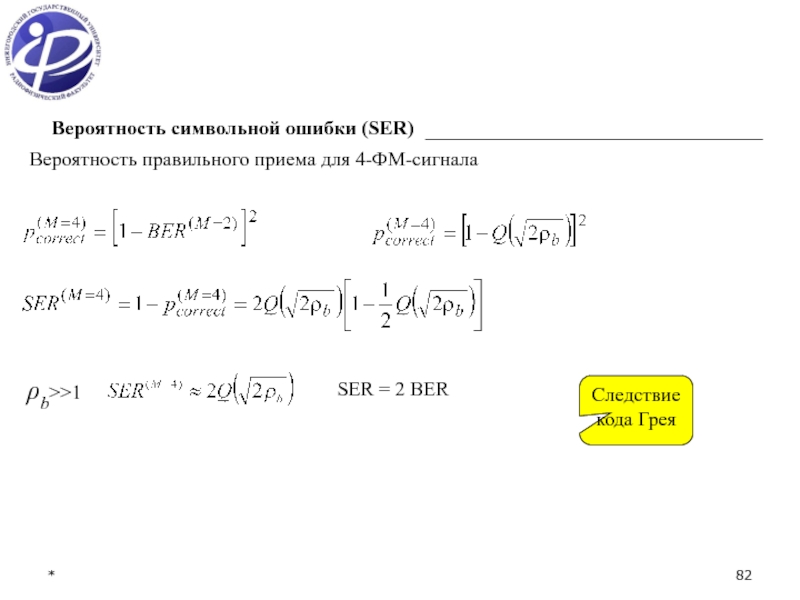

Вероятность символьной ошибки (SER)

Вероятность правильного приема для 4-ФМ-сигнала

ρb>>1

SER =

Следствие кода Грея

Слайд 83*

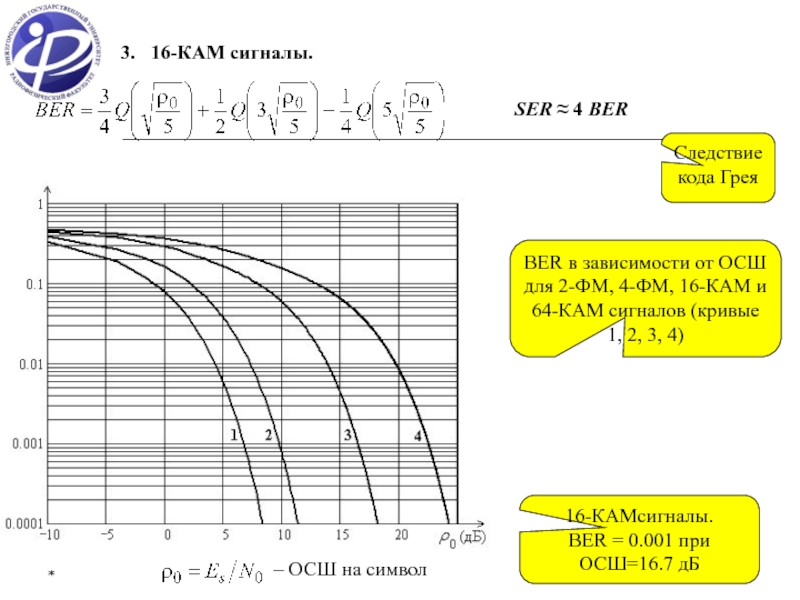

BER в зависимости от ОСШ для 2-ФМ, 4-ФМ, 16-КАМ и 64-КАМ

16-КАМсигналы.

BER = 0.001 при ОСШ=16.7 дБ

3. 16-КАМ сигналы.

SER ≈ 4 BER

Следствие кода Грея

– ОСШ на символ

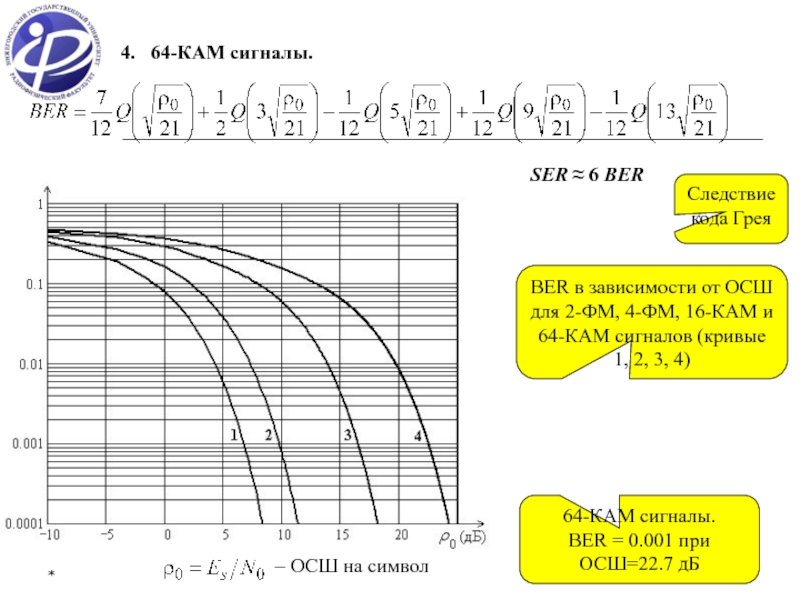

Слайд 84*

BER в зависимости от ОСШ для 2-ФМ, 4-ФМ, 16-КАМ и 64-КАМ

64-КАМ сигналы.

BER = 0.001 при ОСШ=22.7 дБ

4. 64-КАМ сигналы.

SER ≈ 6 BER

Следствие кода Грея

– ОСШ на символ

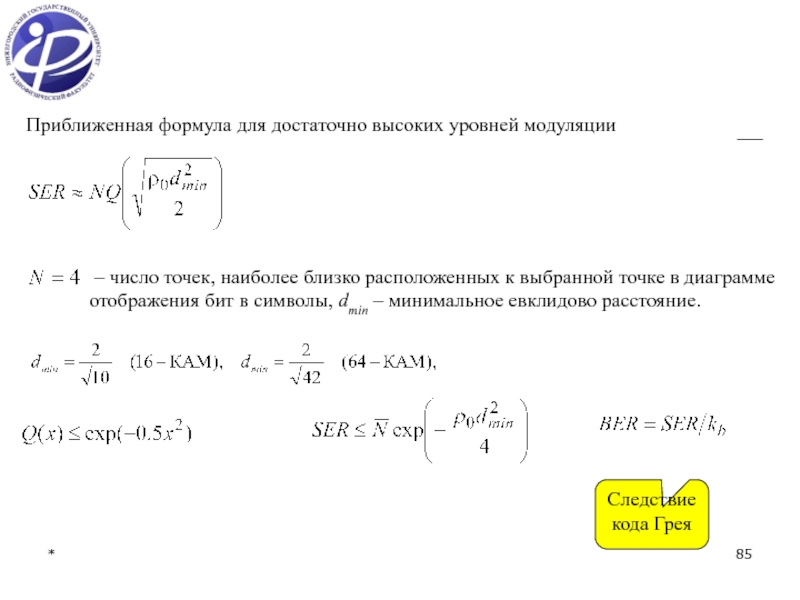

Слайд 85*

Приближенная формула для достаточно высоких уровней модуляции

– число точек,

Следствие кода Грея

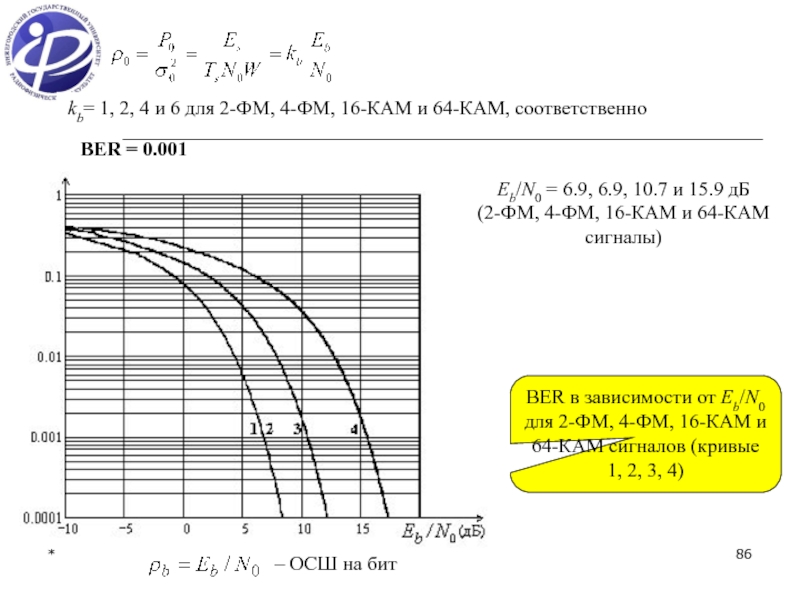

Слайд 86BER в зависимости от Eb/N0 для 2-ФМ, 4-ФМ, 16-КАМ и 64-КАМ

kb= 1, 2, 4 и 6 для 2-ФМ, 4-ФМ, 16-КАМ и 64-КАМ, соответственно

BER = 0.001

Eb/N0 = 6.9, 6.9, 10.7 и 15.9 дБ

(2-ФМ, 4-ФМ, 16-КАМ и 64-КАМ сигналы)

– ОСШ на бит

*

![*2. Теорема КотельниковаНепрерывный сигнал с ограниченной полосой [−fM÷fM] может быть восстановлен по его отсчетам (выборкам),](/img/tmb/5/482343/917cf5927b6fef796b7cbdca2a2a355b-800x.jpg)

![*Примеры.1. Гармоническое колебание со случайной фазой ϕ, равномерно распределенной на интервале [0÷2π], и с амплитудой](/img/tmb/5/482343/b4ab6e8911576337ce9a8a1ce1d0e2fe-800x.jpg)